Привет! В этой статье речь пойдет о таком не очень приятном аспекте машинного обучения, как оптимизация гиперпараметров. Две недели назад в очень известный и полезный проект Vowpal Wabbit был влит модуль vw-hyperopt.py, умеющий находить хорошие конфигурации гиперпараметров моделей Vowpal Wabbit в пространствах большой размерности. Модуль был разработан внутри DCA (Data-Centric Alliance).

Для поиска хороших конфигураций vw-hyperopt использует алгоритмы из питоновской библиотеки Hyperopt и может оптимизировать гиперпараметры адаптивно с помощью метода Tree-Structured Parzen Estimators (TPE). Это позволяет находить лучшие оптимумы, чем простой grid search, при равном количестве итераций.

Эта статья будет интересна всем, кто имеет дело с Vowpal Wabbit, и особенно тем, кто досадовал на отсутствие в исходном коде способов тюнинга многочисленных ручек моделей, и либо тюнил их вручную, либо кодил оптимизацию самостоятельно.

Гиперпараметры

Что такое гиперпараметры? Это все «степени свободы» алгоритма, которые он напрямую не оптимизирует, но от которых зависит результат. Иногда результат зависит совсем чуть-чуть, и тогда, если это не kaggle, можно обойтись дефолтными значениями или подобрать вручную. Но иногда неудачная конфигурация может все испортить: алгоритм либо сильно переобучится, либо, наоборот, не сможет использовать большую часть информации.

В узком смысле, под гиперпараметрами часто понимают лишь регуляризацию и другие «очевидные» настройки методов машинного обучения. Однако в широком смысле, гиперпараметры — это вообще любые манипуляции с данными, которые могут повлиять на результат: инжиниринг фич, взвешивание наблюдений, undersampling и т.д.

Grid Search

Конечно, было бы неплохо иметь алгоритм, который помимо оптимизации параметров, оптимизировал бы и гиперпараметры. Еще лучше, если бы мы могли доверять этому алгоритму больше, чем интуиции. Какие-то шаги в этом направлении, конечно, давно сделаны. В многие библиотеки машинного обучения встроены наивные методы: grid search — проход по сетке, либо random search — семплирование точек из фиксированного распределения (самые известные экземпляры — это GridSearchCV и RandomizedGridSearchCV в sklearn). Преимущество прохода по сетке в том, что его легко закодить самому и легко распараллелить. Однако у него есть и серьезные недостатки:

- Он перебирает много заведомо неудачных точек. Допустим, уже имеется набор каких-то конфигураций с результатами или другая какая-то информация. Человек может понять, какие конфигурации точно дадут отстойный результат, и догадается не проверять лишний раз эти регионы. Grid search так делать не умеет.

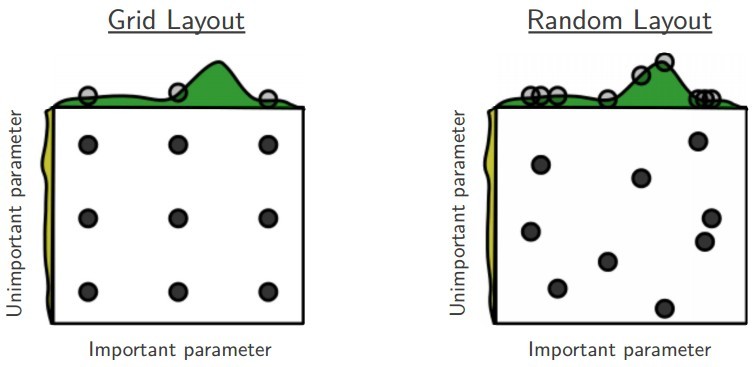

- Если гиперпараметров много, то размер «ячейки» приходится делать слишком крупным, и можно упустить хороший оптимум. Таким образом, если включить в пространство поиска много лишних гиперпараметров, никак не влияющих на результат, то grid search будет работать намного хуже при том же числе итераций. Впрочем, для random search это справедливо в меньшей степени:

Байесовские методы

Для того, чтобы уменьшить число итераций до нахождения хорошей конфигурации, придуманы адаптивные байесовские методы. Они выбирают следующую точку для проверки, учитывая результаты на уже проверенных точках. Идея состоит в том, чтобы на каждом шаге найти компромисс между (а) исследованием регионов рядом с самыми удачными точками среди найденных и (б) исследованием регионов с большой неопределенностью, где могут находиться еще более удачные точки. Это часто называют дилеммой explore-exploit или «learning vs earning». Таким образом, в ситуациях, когда проверка каждой новой точки стоит дорого (в машинном обучении проверка = обучение + валидация), можно приблизиться к глобальному оптимуму за гораздо меньшее число шагов.

Подобные алгоритмы в разных вариациях реализованы в инструментах MOE, Spearmint, SMAC, BayesOpt и Hyperopt. На последнем мы остановимся подробнее, так как vw-hyperopt — это обертка над Hyperopt, но сначала надо немного написать про Vowpal Wabbit.

Vowpal Wabbit

Многие из вас наверняка использовали этот инструмент или хотя бы слышали о нем. Вкратце, это одна из наиболее быстрых (если не самая быстрая) в мире библиотека машинного обучения. Натренировать модель для нашего CTR-предиктора (бинарная классификация) на 30 миллионах наблюдений и десятках миллионах фичей занимает всего несколько гигабайт оперативной памяти и 6 минут на одном ядре. В Vowpal Wabbit реализованы несколько онлайновых алгоритмов:

- Стохастический градиентный спуск с разными наворотами;

- FTRL-Proximal, о котором можно почитать здесь;

- Онлайновое подобие SVM;

- Онлайновый бустинг;

- Факторизационные машины.

Помимо этого, в нем реализованы feed-forward нейронные сети, батч-оптимизация (BFGS) и LDA. Можно запускать Vowpal Wabbit в фоновом режиме и принимать на вход поток данных, либо дообучаясь на них, либо просто выдавая предсказания.

FTRL и SGD могут решать задачи как регрессии, так и классификации, это регулируется только функцией потерь. Эти алгоритмы линейны относительно фичей, но нелинейность может легко быть достигнута с помощью полиномиальных фичей. Имеется очень полезный механизм ранней остановки, чтобы уберечься от переобучения, если указал слишком большое количество эпох.

Также Vowpal Wabbit знаменит своим хешированием фичей, которое выполняет роль дополнительной регуляризации, если фичей очень много. Благодаря этому удается обучаться на категориальных фичах с миллиардами редко встречающихся категорий, вмещая модель в оперативную память без ущерба для качества.

Vowpal Wabbit требует специальный входной формат данных, но в нем легко разобраться. Он естественным образом разреженный и занимает мало места. В оперативную память в любой момент времени загружена всего одно наблюдение (или несколько, для LDA). Обучение проще всего запускать через консоль.

Интересующиеся могут прочитать туториал и другие примеры и статьи в их репозитории, а также презентацию. Про внутренности Vowpal Wabbit можно подробно прочитать в публикациях Джона Лэнгфорда и в его блоге. На Хабре тоже есть подходящий пост. Список аргументов можно получить через vw --help или почитать подробное описание. Как видно из описания, аргументов десятки, и многие из них могут считаться гиперпараметрами, которые можно оптимизировать.

В Vowpal Wabbit имеется модуль vw-hypersearch, который умеет подбирать один какой-нибудь гиперпараметр методом золотого сечения. Однако при наличии нескольких локальных минимумов этот метод, скорее всего, обнаружит далеко не лучший вариант. К тому же, зачастую нужно оптимизировать сразу много гиперпараметров, и этого нет в vw-hypersearch. Пару месяцев назад я попробовал написать многомерный метод золотого сечения, но количество шагов, которые требовались ему для сходимости, превзошло любой grid search, так что этот вариант отпал. Было решено использовать Hyperopt.

Hyperopt

В этой библиотеке, написанной на питоне, реализован алгоритм оптимизации Tree-Structured Parzen Estimators (TPE). Преимущество его в том, что он может работать с очень «неуклюжими» пространствами: когда один гиперпараметр непрерывный, другой категориальный; третий дискретный, но соседние значения его коррелированы друг с другом; наконец, некоторые комбинации значений параметров могут просто не иметь смысла. TPE принимает на вход иерархическое пространство поиска с априорными вероятностями, и на каждом шаге смешивает их с Гауссовским распределением с центром в новой точке. Его автор Джеймс Бергстра утверждает, что этот алгоритм достаточно хорошо решает проблему explore-exploit и работает лучше как grid search-а, так и экспертного перебора, по крайней мере, для задач глубокого обучения, где гиперпараметров особенно много. Подробнее об этом можно почитать здесь и здесь. Про сам алгоритм TPE можно почитать здесь. Возможно, в будущем удастся написать про него подробный пост.

Хотя Hyperopt не был встроен в исходный код известных библиотек машинного обучения, многие используют его. Например, вот замечательный туториал по hyperopt+sklearn. Вот применение hyperopt+xgboost. Весь мой вклад — эта похожая обертка для Vowpal Wabbit, более-менее сносный синтаксис для задания пространства поиска и запуска всего этого из командной строки. Так как в Vowpal Wabbit еще не было подобного функционала, мой модуль понравился Лэнгфорду, и он его влил. В действительности, каждый может попробовать Hyperopt для своего любимого инструмента машинного обучения: это несложно сделать, и все необходимое есть в этом туториале.

vw-hyperopt

Перейдем к использованию модуля vw-hyperopt. Сначала нужно установить последнюю версию Vowpal Wabbit с гитхаба. Модуль находится в папке utl.

Внимание! Последние изменения (в частности, новый синтаксис команды) пока что (на 15 декабря) не влиты в основной репозиторий. В ближайшие дни, надеюсь, проблема решится, а пока что можете пользоваться последней версией кода из моей ветки.

Пример использования:

./vw-hyperopt.py --train ./train_set.vw --holdout ./holdout_set.vw --max_evals 200 --outer_loss_function logistic --vw_space '--algorithms=ftrl,sgd --l2=1e-8..1e-1~LO --l1=1e-8..1e-1~LO -l=0.01..10~L --power_t=0.01..1 --ftrl_alpha=5e-5..8e-1~L --ftrl_beta=0.01..1 --passes=1..10~I --loss_function=logistic -q=SE+SZ+DR,SE~O --ignore=T~O' --plot

На вход модулю требуется обучающая и валидационная выборки, а также априорные распределения гиперпараметров (закавыченные внутри --vw_space). Можно задавать целочисленные, непрерывные или категориальные гиперпараметры. Для всех, кроме категориальных, можно задавать равномерное или лог-равномерное распределения. Пространство поиска из примера преобразуется внутри vw-hyperopt приблизительно в такой объект для Hyperopt (если вы прошли туториал по Hyperopt, вы поймете это):

from hyperopt import hp

prior_search_space = hp.choice('algorithm', [

{'type': 'sgd',

'--l1': hp.choice('sgd_l1_outer', ['empty', hp.loguniform('sgd_l1', log(1e-8), log(1e-1))]),

'--l2': hp.choice('sgd_l2_outer', ['empty', hp.loguniform('sgd_l2', log(1e-8), log(1e-1))]),

'-l': hp.loguniform('sgd_l', log(0.01), log(10)),

'--power_t': hp.uniform('sgd_power_t', 0.01, 1),

'-q': hp.choice('sgd_q_outer', ['emtpy', hp.choice('sgd_q', ['-q SE -q SZ -q DR', '-q SE'])]),

'--loss_function': hp.choice('sgd_loss', ['logistic']),

'--passes': hp.quniform('sgd_passes', 1, 10, 1),

},

{'type': 'ftrl',

'--l1': hp.choice('ftrl_l1_outer', ['emtpy', hp.loguniform('ftrl_l1', log(1e-8), log(1e-1))]),

'--l2': hp.choice('ftrl_l2_outer', ['emtpy', hp.loguniform('ftrl_l2', log(1e-8), log(1e-1))]),

'-l': hp.loguniform('ftrl_l', log(0.01), log(10)),

'--power_t': hp.uniform('ftrl_power_t', 0.01, 1),

'-q': hp.choice('ftrl_q_outer', ['emtpy', hp.choice('ftrl_q', ['-q SE -q SZ -q DR', '-q SE'])]),

'--loss_function': hp.choice('ftrl_loss', ['logistic']),

'--passes': hp.quniform('ftrl_passes', 1, 10, 1),

'--ftrl_alpha': hp.loguniform('ftrl_alpha', 5e-5, 8e-1),

'--ftrl_beta': hp.uniform('ftrl_beta', 0.01, 1.)

}

])

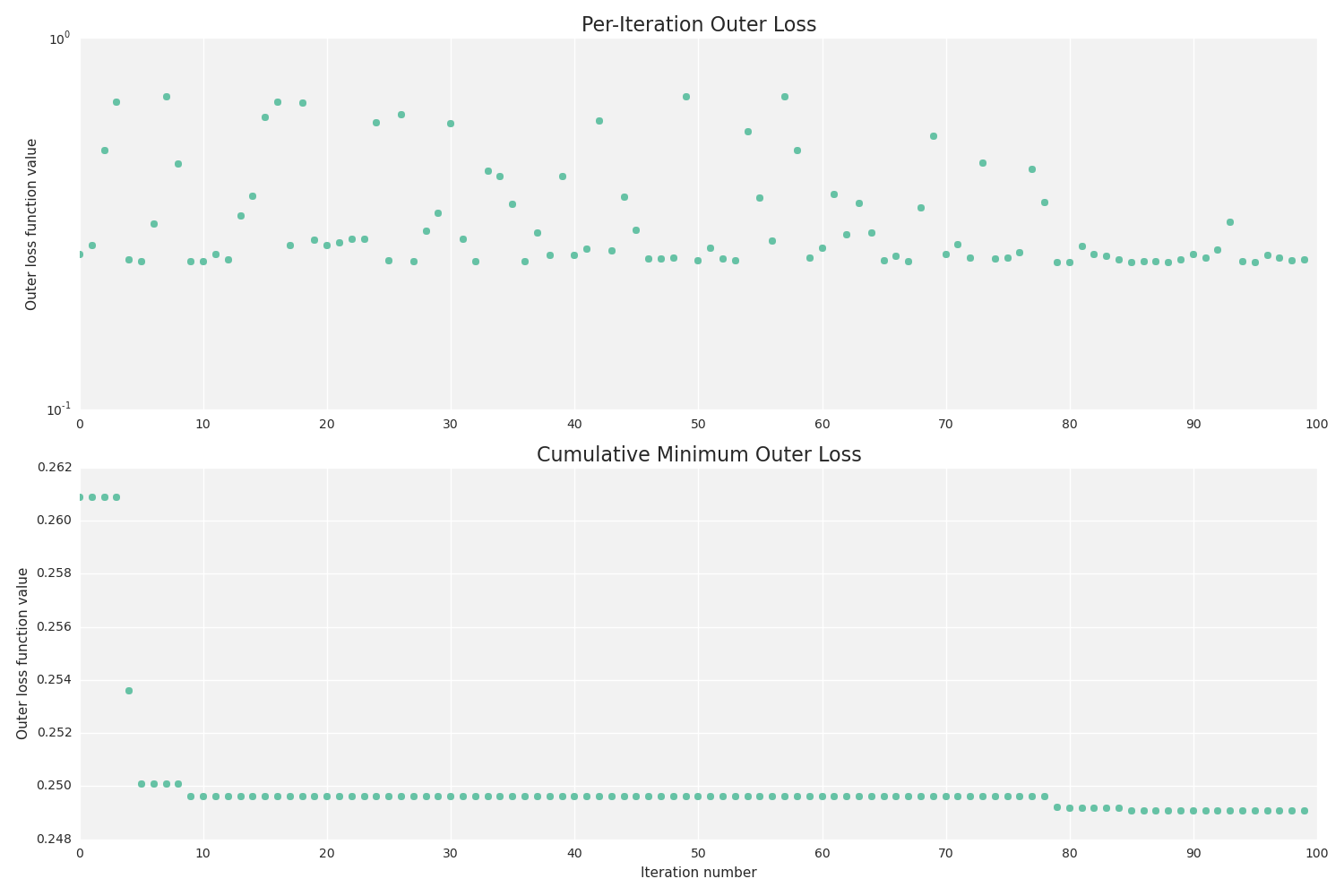

Опционально можно изменить функцию потерь на валидационной выборке и максимальное количество итераций (--outer_loss_function, по умолчанию logistic, и --max_evals, по умолчанию 100). Также можно сохранять результаты каждой итерации и строить графики с помощью --plot, если установлен matplotlib и, желательно, seaborn:

Документация

Так как на хабрахабр не принято выкладывать подробную документацию, ограничусь ссылкой на нее. Про всю семантику вы можете почитать в русскоязычной вики в моем форке или дождаться англоязычной версии в главном репозитории Vowpal Wabbit.

Планы

В будущем в модуль планируется добавить:

- Поддержку задач регрессии и мультиклассовой классификации.

- Поддержку «теплого старта»: выдать Hyperopt заранее оцененные точки, и начать оптимизацию уже с учетом результатов на них.

- Опцию оценки ошибки на каждом шаге на еще одной тестовой выборке (но без оптимизации гиперпараметров на ней). Это нужно, чтобы лучше оценить обобщающую способность — не переобучились ли мы.

- Поддержку бинарных параметров, которые не принимают никаких значений, таких как

--lrqdropout, --normalized, --adaptiveи т.д. Сейчас можно, в принципе, писать--adaptive= ~O, но это неинтуитивно совсем. Можно сделать что-то вроде--adaptive=~Bили--adaptive=~BO.

Буду очень рад, если кто-нибудь воспользуется модулем, и кому-нибудь он поможет. Буду рад любым предложениям, идеям или обнаруженным багам. Можете писать их сюда или создавать issue на гитхабе.

Автор: DCA (Data-Centric Alliance)