Google ищет идеи построения понятных человеку приложений искусственного интеллекта

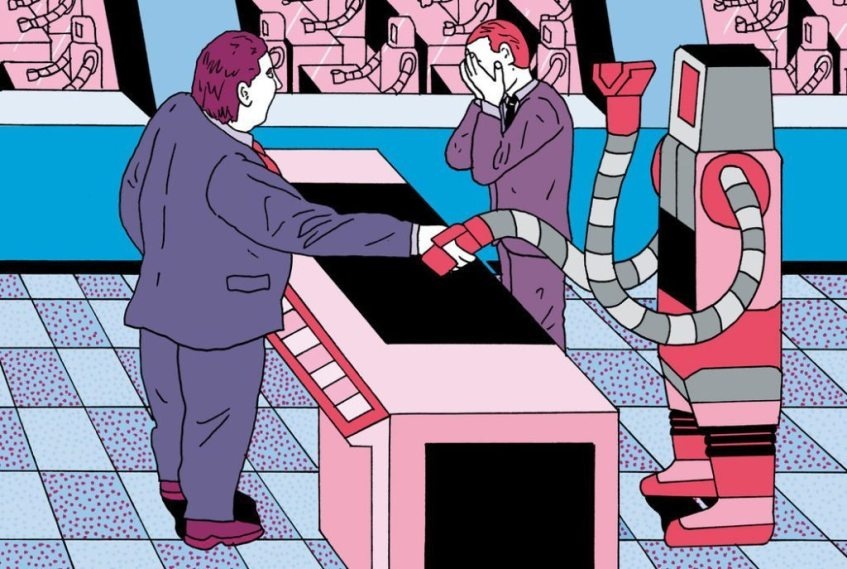

Google последовательно продвигает идею, что самым перспективным способом развития ИИ для людей будет включение по умолчанию в машинные алгоритмы места для человека. Так будет безопаснее и эффективнее. Безопаснее, поскольку люди смогут сохранить контроль над процессами внутри ИИ, эффективнее, потому что ряд задач алгоритмы решают пока чисто механически, а человек — творчески.

Помимо этих двух причин, с реалистичностью которых можно поспорить, взаимодействие машины и человека позволит нам сохранить рабочие места. Первые два инструмента контроля в рамках инициативы PAIR [1] (People + AI Research) как раз и были недавно анонсированы и предложены для широкого использования. Цель инициативы — подружить человека с ИИ в максимальном числе отраслей и сфер применения через совместную работу.

Инициатива Google представляет интерес для самой корпорации. Публично обсуждая инструменты взаимодействия с человека с машинами, компания получает в союзники и будущие пользователи своих решений представителей всех уровней, которые определяют будущее применение ИИ — ученых, отраслевых специалистов и пользователям. Особо интересует Google медицина, сельское хозяйство, развлечение и производственные решения. Эксперименты широкой общественности в этих сферах дадут корпорации новые удобные кейсы применения ИИ и подготовят потребителей к использованию новых приложений.

Во главе PAIR стоят Фернанда Вьегаш и Мартин Ваттенберг, которые специализируются на распознавании процессов, проходящих при обработке больших массивов данных. А это суть машинного обучения. Именно в неконтролируемом самообучении машин видят угрозу большинство футурологов. Надо вовремя увидеть направление мыслей машины. Для этого Фернанда и Мартин разработали два инструмента визуализации больших данных и планируют визуализировать процессы машинного обучения — Facets Overview и Facets Dive. Один предназначен для мониторинга функции, другой — для детальных исследований преобразования каждой части набора данных.

Разработанные инструменты [2] способны улавливать аномальные значения функций, отсутствия типичных признаков и нормальных результатов, сбои тестирования и настройки. А главное — путем гибких настроек софт позволяет видеть шаблоны и структуры, неочевидные или не существовавшие изначально. Что для людей статистические обобщения, то для машин — основания для выводов, оценить обоснованность и приемлемость для человека которые они не в состоянии. Мы должны видеть какие шаблоны и «умозаключения» данных построила для себя машина, чтобы вовремя поправить ошибки — опасные или безопасные для нас.

Предыстория инициативы PAIR

Ранее в направлении формирования полезных людям кейсов Google уже соучредила с коллегами «Партнерство по искусственному интеллекту» [3], внесла номинацию «человеко-ориентированного взаимодействия» в свою премию для исследователей, а также опубликовала рекомендации для разработчиков программ с машинным обучением.

Google выделила 7 типичных ошибок, которые полезно избегать при создании приложений, востребованных у конечных пользователей:

- Не ожидайте, что машинное обучение определит, какие проблемы решить. Ищите проблемы самостоятельно. Занимайтесь маркетингом раньше, чем сядете кодить.

- Подумайте, насколько оправдано решение задачи с помощью машинного обучения. Есть много математических и программных инструментов, которые работают проще, быстрее или точнее на узких задачах. Эвристический анализ может уступать машинному обучению по точности, но требует меньше времени и расчетов. Предположите, как задачу мог бы решить человек, каким путем вы могли бы улучшить его результаты для показателей каждого из 4 секторов матрицы ошибок [4], какие ожидания и стереотипы есть сейчас у пользователей сходных задач.

- Попробуйте изменить входные условия задачи и смоделируйте, как задачу мог бы решить человек, имитирующий машины.

- Оцените возможные ошибки в алгоритмах, насколько они критичны для лояльности будущих пользователей. Ошибки могут приводить к одновременному росту частоты появлений ложных и истинных решений, так и наоборот — к сокращению всех решений вообще. Надо понять что важнее: полнота или точность, и найти баланс.

- Учитывайте что пользователи будут «умнеть» по мере привыкания к новым технологиям. Часть «глупых» алгоритмов надо вовремя отключить, иначе пользователи начнут раздражаться на их наличие.

- Используйте обучение с подкреплением, мотивируя пользователей ставить правильные метки и теги.

- Поощряйте воображение разработчиков на тему того, как пользователи могут применить и тестировать будущее приложение.

Автор: Anrewer

Источник [6]

Сайт-источник PVSM.RU: https://www.pvsm.ru

Путь до страницы источника: https://www.pvsm.ru/ii/260602

Ссылки в тексте:

[1] инициативы PAIR: https://www.blog.google/topics/machine-learning/pair-people-ai-research-initiative/

[2] инструменты: https://pair-code.github.io/facets/

[3] «Партнерство по искусственному интеллекту»: https://geektimes.ru/post/280940/

[4] матрицы ошибок: https://habrahabr.ru/company/ods/blog/328372/

[5] мышление: http://www.braintools.ru

[6] Источник: https://geektimes.ru/post/291141/

Нажмите здесь для печати.