Что должен сделать робот-медсестра, если больной раком просит увеличить дозу морфия, а связаться с врачом не получается? Должен ли робот-водитель запрещать пьяному человеку самому управлять автомобилем, когда он спешит в больницу к своему ребёнку? На чей голос должен спешить робот-спасатель в развалинах после землетрясения — на детский или взрослый? А если так получилось, что взрослый — это вы, но ребёнок не ваш?

Люди много лет мечтают о наступлении эры доступной робототехники, когда умные машины избавят нас от многих трудов. «До чего дошёл прогресс, до невиданных чудес». Но в то же время развитие роботов будет поднимать серьёзнейшие вопросы о том, как они должны вести себя в сложных ситуациях, связанных с острыми морально-этическими проблемами.

Научные исследования могут прояснить, что означает для людей понятие «разбираться в морали». На основе этих знаний мы сможем проектировать роботов хотя бы с элементарным уровнем познаний о морали, и выяснить, способны ли они успешно взаимодействовать с людьми. Первым делом мы должны понять, как люди делают моральный выбор благодаря своей уникальной способности воспринимать социальные и морально-этические нормы. Далее мы сможем изучить, в состоянии ли роботы распознавать, понимать и соблюдать эти нормы.

Технологии, с помощью которых может быть создан искусственный интеллект, устойчиво развиваются вот уже 50 лет. Но этические стороны прогресса и его возможные последствия только недавно стали привлекать всеобщее внимание. До 2004 года на Западе была издана 41 академическая статья, посвященная «робоэтике». Между 2005 и 2009 годами это число удвоилось — до 88. С 2010 по 2014 года число статей удвоилось снова — до 170 (поиска по запросам «robot*» и «ethic*» в научных базах данных EBSCOhost). Появляются конференции, на которых поднимаются вопросы роста числа этических проблем в быстро прогрессирующем роботостроении.

Необходимость норм

Социальные нормы облегчают взаимодействие с другими людьми, подсказывая модель поведения (Что я должен делать?), давая возможность предсказывать (Что должно произойти?) и обеспечивать координацию (Кто должен это делать?). Это было необходимо для родового строя кочевников, которые бродили по территориям от жгучей Африки до холодной Северной Европы. Нормы регулировали жизнь на стоянках, при совместной охоте, дележе пищи, а также во время сезонной миграции.

Качественный скачок в нравственной жизни произошел с переходом к сельскому хозяйству и общинному строю. Нормы должны были регулировать имущественные отношения (например, распределение земли), новые формы производства (инструменты для сбора урожая) и огромное число социальных ролей (от слуги до короля). Сегодня социальные нормы регулируют бесчисленное множество культурных форм поведения. Мы можем предположить, что люди знают больше социальных и морально-нравственных норм, чем они знают слов на родном языке.

Чтобы оценить необъятность нашей системы норм, можете провести небольшой эксперимент: возьмите десять случайных слов из словаря и считайте, сколько на каждое слово вы можете придумать норм. Потом обдумайте, сколько вариаций имеет каждая из этих норм множество в зависимости от ситуаций и людей, в них вовлеченных.

Люди не только знают огромное количество норм и корректируют свои действия в соответствии с ними; они также знают, когда допустимо отказаться от использования каких-либо правил. Человек легко имеет дело с контекстом изменчивости норм. Мы понимаем, что разговор может быть хорошим вариантом в одних случаях, но не в других, или что ударить другого человека допустимо только в определенных ситуациях. Кроме того, люди понимают (не обязательно осознанно), что определенные нормы применяются к данному пространству, объекту, человеку, ситуации или процессу. Правильный набор норм поведения активируется множеством сигналов, полученных от повторения аналогичных ситуаций.

Учитывая сложность человеческих норм (а еще даже не было речи о культурных вариациях), можно ли считать, что роботы в принципе способны выучить негласные правила? Прежде чем решить эту задачу, сначала ответим на вопрос: почему мы хотим учить робота разбираться в морали и этике?

Почему машины должны быть этичными?

Если (когда) роботы станут частью нашей повседневной жизни, то эти новые члены общества должны будут надлежащим образом адаптироваться, чтобы взаимодействовать с нами в сложной человеческой культуре. И если мы сами следуем нормам, не должны ли мы дать роботам такую же систему норм, то есть создать машины, разбирающиеся в морали?

Мы уже некоторое время используем машины с зачатками морали, в основном в виде защитных функций (например, когда горячий утюг автоматически выключается через определенный промежуток времени). Такие характеристики прибора нужны для предотвращения возможного вреда — а ведь это одна из главных функций морали. Конечно, роботы должны быть безопасными и определенную степень защиты. Но этого будет недостаточно, если мы хотим, чтобы роботы самостоятельно принимали решения, которые выходят за рамки запрограммированных ситуаций.

Почему роботы должны обладать возможностью решать самостоятельно? Потому что это единственный для них способ преодолеть проблему взаимодействия с людьми. В рамках сотрудничества или обучения люди не могут просто полагаться на результаты предварительного программирования, потому что поведение человека имеет слишком сложный и изменчивый характер. Люди тысячелетиями развивали способности к адаптации и творчеству, из-за чего предсказать их поведение становится намного труднее. Ответы робота на переменчивое и непредсказуемое человеческое поведение не могут быть заранее запрограммированы. Робот должен будет отслеживать реакцию человека на небольшие изменения в обстановке и гибко реагировать в ответ — такая способность требует самостоятельности в принятии решений.

Хотя поведение человека носит сложный и многообразный характер, и может показаться весьма непредсказуемым для робота, оно весьма очевидно считывается другими людьми. Почему так?

- Во-первых, мы делаем ряд основополагающих предположений об индивидах, с которыми взаимодействуем. Мы исходим из того, что другие люди имеют какие-то ментальные установки (чувства, эмоции, желания и убеждения) и ведут себя в соответствии с ними. Так как человек быстро определяет ментальные установки других, то способность прогнозировать и осмысливать поведение друг друга значительно повышается.

- Во-вторых, как уже говорилось выше, человеческое поведение чаще всего определяется социальными и моральными нормами данного общества, и знание этих норм делает людей гораздо более предсказуемыми в общении друг с другом.

Способность мысленно ставить себя на место другого, приписывать другим индивидам определенные умственные состояния и представления, понимая при этом, что они могут быть ложными и могут отличаться от наших собственных, часто называют «теорией ума».

Теперь соединим эти два элемента вместе: если бы робот разделял человеческие предположения об разуме и поведении, и мог делать верные догадки о ментальном состоянии людей, и если бы робот следовал социальным и моральным нормам, то способности ИИ предсказывать и понимать поведение человека значительно улучшились бы.

Конечно, не достаточно просто научиться предсказывать поведение человека. Но это средство достижения более важной цели: обеспечить безопасное, эффективное и удобное общение между людьми и роботами. Только когда роботы смогут понимать homo sapiens и адекватно реагировать на их поведение, люди смогут доверить машинам нянчить малышей или ухаживать за престарелыми родителями.

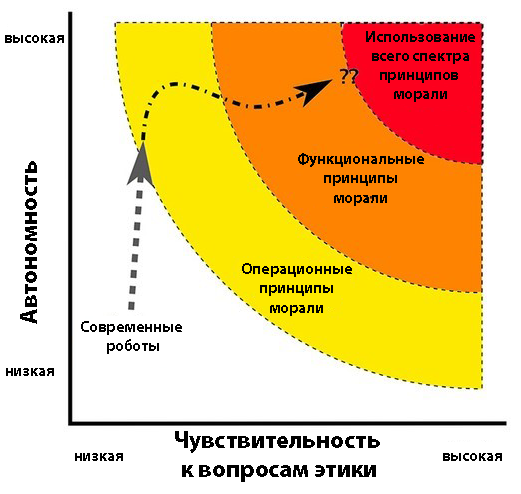

Требования социального взаимодействия вынуждают роботов быть когнитивно гибкими и адаптивными, а, следовательно, и более самостоятельными. Чтобы достигнуть такой автономии, они должны иметь систему норм и удовлетворять положениям теории ума. Не так давно компьютерная реализация теории ума оказалась в центре внимания исследователей в сфере робототехники. В последнее время возник новый вопрос: как роботы могут освоить систему норм? Чтобы ответить на него, нужно внимательнее рассмотреть людей.

Нравственное воспитание людей и роботов

Как и роботы, люди начинают жизнь с полного непонимания сложных требований общества. Младенцы и малыши постепенно изучают правила социального взаимодействия в семье, затем расширяют эти правила до ситуаций и отношений вне дома. В школьном возрасте дети осваивают большой перечень норм, но все ещё не готовы ко многим ситуациям из мира взрослых. Даже взрослые постоянно сталкиваются с новыми нормами для незнакомых задач, контекстов, ролей и отношений.

Как мы усваиваем все эти нормы? Это сложный и плохо изученный процесс, но в нём можно выделить два главных механизма. Первый проявляется на самых ранних стадиях жизни, когда младенцы обнаруживают статистические закономерности в физическом и социальном мире. Они начинают осмысливать шаблоны событий, происходящих в поведении людей, реагирующих на различные ситуации, особенно если эти шаблоны повторяются в виде ежедневных ритуалов. Получая представления о норме, дети могут затем находить нарушения в стандартных шаблонах и наблюдать реакцию людей в ответ на нарушения. Отмечая степень реагирования, они учатся отличать строгие правила (сильная реакция) от стремлений, порождающих выгоду (умеренная или отсутствующая реакция).

Но многие социальные и моральные нормы нельзя просто приобрести, отслеживая закономерности. Например, если закономерность — это отсутствие определенного поведения, или если вы никогда не попадали в ситуации, в которой применяются соответствующие нормы. Второй механизм регулирует такие случаи: обучает правилам и нормам другими способами, которые варьируются в диапазоне от демонстрации намерений до явных требований. Дети (и взрослые) усваивают правила и готовы поступать «как им говорят» из-за сильной зависимости от мнения окружающих и чувствительности к неодобрению.

Можем ли мы реализовать эти два механизма в роботах, чтобы они осваивали нормы таким же образом, как и люди? С точки зрения вычислений, поведенческие закономерности легко поддаются обработке; а вот оценка сильных реакций на нарушения нормы является более сложной проблемой. «Ум» робота должен обрабатывать не только, картинки, но и видео, содержащее реакцию на нарушение нормы. Роботы не могут годами воспитываться в семьях, как дети, так что единственным доступным вариантом остается тот, в котором мы скармливаем машинам фильмы и телепрограммы всего человечества. Робот, просматривающий видеозапись, смог бы получить большой список поведенческих шаблонов, отклонений и реакций на отклонения. Хотя в этом случае очень большую роль играет выбор правильных материалов для обучения. Очевидно, что боевики и поделки вроде «Дом 2» нельзя использовать для обучения роботов.

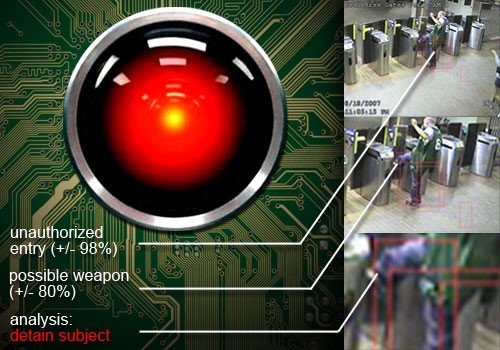

В DARPA была запущена программа «Mind’s Eye», предназначенная для развития компьютеров с «визуальным интеллектом». Агентство планирует сделать «умную» камеру наблюдения, которая не только видит то, что находится перед ней, но и в состоянии понять, что происходит в настоящий момент и даже спрогнозировать, что может произойти дальше.

Второй механизм обучения нормам, в принципе, также легко осваивается: учить робота через демонстрацию и объяснение, что можно делать, а что делать нельзя. Этот метод требует гибкости подхода при запоминании данных, ведь робот должен понимать, что наиболее явные правила относятся к ситуациям, в которых они были заявлены напрямую, и не обязательно могут проявляться в других контекстах.

Если комбинация этих подходов позволит роботу обрести представления о нормах, и в результате система норм будет связана с действиями робота, то машина будет в состоянии распознать нормативное и ненормативное поведение, а также «соблюдать» правила. Искусственный интеллект, как и человек, узнает, как вести себя в любой распознанной ситуации.

Могут ли однажды роботы стать более нравственными, чем люди?

У роботов есть огромный потенциал стать более развитыми морально, чем сами люди.

- Во-первых, роботы, в отличие от людей, не будут эгоистичны. Если мы сделаем всё правильно, то приоритетом робота станет главенство интересов человека без извлечения путно собственной выгоды. Робот может следовать собственным целям и одновременно действовать в соответствии с общественными нормами, а не устраивать конкуренцию между этими направлениями деятельности.

- Во-вторых, роботы не будут подвергаться влиянию эмоций, таких как гнев, зависть, или страх, которые систематически могут приводить к предвзятости моральных суждений и решений. Некоторые даже считают, что выверенность и логичность поступков роботов делают их превосходными солдатами, которые, в отличие от людей, не преступают нормы международного гуманитарного права.

- Наконец, роботы ближайшего будущего будут иметь конкретные роли и использоваться для решения ограниченного круга задач. Это значительно уменьшает количество норм, которые должен выучить каждый робот, и уменьшает проблему ситуационной изменчивости, с которой постоянно сталкиваются люди. Дайте роботу некоторое время поработать с пожилыми людьми, и он будет знать, как вести себя в домах для престарелых; при этом робот может иметь смутные представления о том, как действовать в детском саду, но это от него и не потребуется.

Вероятность того, что роботы будут выполнять ограниченные обязанности, помогает решить ещё один вопрос: какие нормы поведения должен знать робот? Ответ — те, которые должен изучить ребенок: правила данного сообщества. Если роботы должны быть активными участниками конкретных социальных сообществ, то они будут спроектированы и обучены в рамках норм своего же сообщества.

Например, робототехник AJung Moon, кандидат наук в области машиностроения из Университета Британской Колумбии, разрабатывает методы для определения норм в различных группах с разной системой ценностей. Её исследования демонстрируют уровень сложности решения даже таких простых вещей, как реакция робота, несущего посылку, на людей при входе в лифт. В конечном счете, было обнаружено, что нет никаких жестких правил. Робот должен, как и люди, оценить контекст ситуации и использовать любой доступный ему способ взаимодействия. С точки зрения человека оказывается недопустимо, чтобы робот просто ничего не делал и стоял у лифта.

Задача проектирования роботов, которые могут понять ситуацию и действовать в соответствии с нравственными нормами человека, является сложной, но не невозможной. Хорошо, что ограниченные возможности современных роботов дают нам время научить их разбираться в вопросах морали и этики. Да, роботы не будут безупречны, и сотрудничество робота и человек будет основано на симбиозе, который позволит каждому из партнеров заниматься тем, что получается у него лучше всего.

Автор: ASUS Russia