Конспект админа: блеск и нищета блейд-систем

В Конспекте мы часто обходим стороной enterprise-технологии из-за их малой применимости в не столь масштабных проектах. Но сегодняшняя статья – исключение, потому что речь пойдет о модульных системах, "блейдах".

Не так много архитектурных изысков в IT-мире, которые были бы окутаны большим ореолом "невероятной крутости" и сравнимым набором мифов. Поэтому не буду усложнять еще больше, и просто расскажу об особенностях и применимости такого рода систем на практике.

LEGO для инженера

Блейд-сервер почти обычный сервер, в котором есть привычная материнская плата, оперативная память, процессоры и множество вспомогательных систем и адаптеров. Но "почти" заключается в том, что такой сервер не предназначен для автономной работы и поставляется в специальном компактном корпусе для установки в специальное шасси.

Шасси – или "корзина" – ни что иное, как большой короб с посадочными местами для серверов и дополнительных модулей. Все серверы и компоненты соединены при помощи большой коммутационной платы (Backplane) и образуют блейд-систему.

Если разобрать всю систему на составляющие, то на столе окажется следующая горка:

-

Блейд-серверы (лезвия) – серверы без блоков питания, вентиляторов, сетевых разъемов и модулей управления;

-

Шасси – корпус и бэкплейн;

-

Системы питания и охлаждения для всех компонентов системы;

-

Коммутационные устройства для связи с внешним миром;

- Модули управления (различные вариации на тему IPMI).

От обычного серверного шкафа все это добро отличается компактными размерами (обычно 6-10U) и высоким уровнем надежности, так как все компоненты могут быть зарезервированы. Здесь, кстати, кроется один из мифов: десяток лезвий не собирается в один большой сервер. Это будет просто десяток серверов с общей инфраструктурой.

К слову, у HPE есть решения, напоминающие традиционные blade-серверы – HPE Superdome [1]. В качестве лезвий там используются процессорные модули с оперативной памятью. В таких решениях вся система действительно представляет собой один высокопроизводительный сервер.

Нюансы архитектурных решений разных производителей блейд-систем уже обсуждались [2] на Хабре (статья хоть и старая, но в своих основах актуальная), поэтому я для иллюстрации использую блейд-систему от HPE – BladeSystem c7000 [3].

В роли лезвий могут выступать:

-

Обычные серверы, вроде HPE ProLiant BL460c Gen9 [4] (аналог стоечного HPE ProLiant DL360 Gen9 [5]);

-

Дисковые массивы – например, HPЕ StorageWorks D2200sb [6], в который можно установить до 12 дисков 2,5’’. Так легко и непринужденно нескольким серверам можно выдать общее DAS-хранилище;

-

Коммутаторы SAN для доступа к внешним системам хранения и полноценные NAS-серверы – например, HPE StorageWorks X1800sb [7];

- Ленточные устройства.

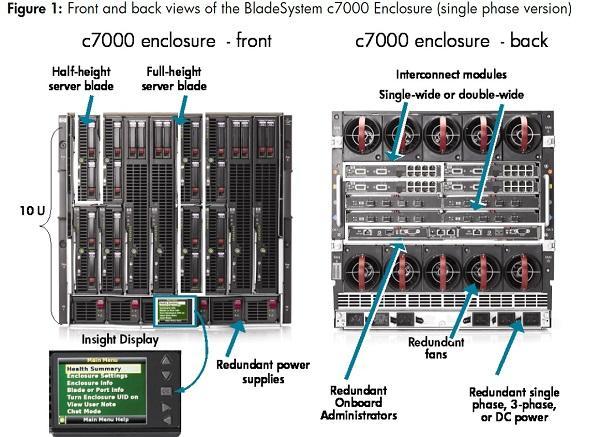

На картинке ниже изображена полностью укомплектованная система HPE BladeSystem c7000. Расположение компонентов понятно и так – обратите только внимание на секцию Interconnect modules. В каждый ряд устанавливается отказоустойчивая пара сетевых устройств или pass-thru модулей для простого проброса серверных сетевых интерфейсов наружу.

В компактное лезвие HPE ProLiant BL460c Gen8 помещается только два диска 2,5’’. Для большей красоты вместо дисков можно использовать сетевую загрузку с дисковой системы SAN или PXE.

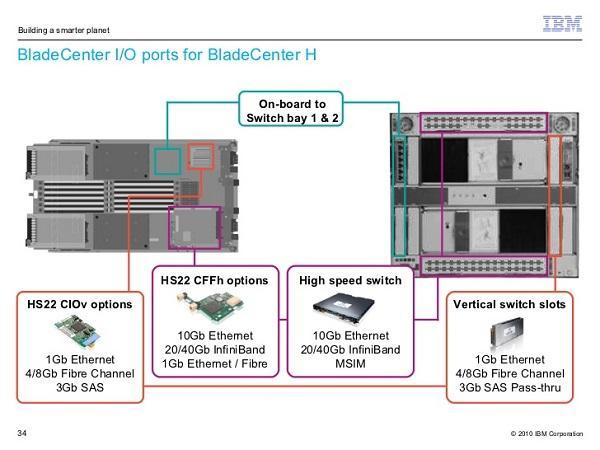

Ниже изображена более компактная блейд-система от IBM. Общие принципы те же, хоты расположение узлов тут отличается:

Интереснее всего в блейдах, на мой взгляд, сетевая составляющая. С использованием модных конвергентных коммутаторов можно творить настоящие чудеса с внутренней сетью блейд-системы.

Немного сетевой и Enterprise магии

В качестве сетевых модулей могут выступать специальные коммутаторы Ethernet или SAS, либо умеющие и то и другое. Разумеется, в блейд-систему нельзя установить обыкновенный коммутатор, но совместимые модели производятся привычными брендами. Например "великолепной тройкой" HPE, Cisco, Brocade. В самом простом случае это будут просто модули доступа к сети, выводящие все 16 лезвий наружу через 16 портов Ethernet – HPE Pass-Thru [8].

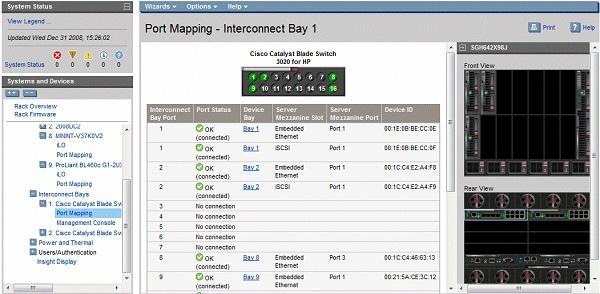

Такой модуль не уменьшит количество сетевых проводов, но позволит подключиться к корпоративной LAN с минимальными вложениями. Если же вместо него использовать недорогой Cisco Catalyst 3020 [9] с 8 портами 1GbE Ethernet и 4 портами 1GbE SFP, то к общей сети нужно будет подключить лишь несколько общих портов шасси.

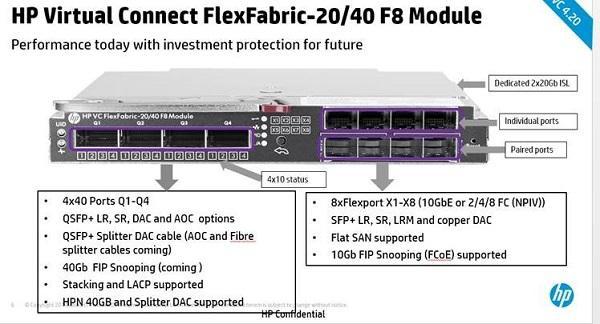

Такие сетевые устройства своими возможностями не отличаются от обычных. Значительно интереснее выглядят модули HPE Virtual Connect [10] (VC). Главная их особенность – возможность создавать несколько отдельных сетей с гибким распределением полосы пропускания LAN и SAN. Например, можно подвести к шасси 10GbE и "нарезать" из него 6 гигабитных LAN и один 4Gb SAN.

При этом VC поддерживает до четырех подключений к каждому серверу, что открывает определенные просторы для творчества и сборки кластеров. Подобные решения есть и у других производителей – нечто подобное от Lenovo называется IBM BladeCenter Virtual Fabric [11].

Вопреки расхожему мнению, сами по себе блейды не отличаются от обычных серверов, и никаких особых превосходств в плане виртуализации не предоставляют. Интересные возможности появляются только с использованием специальных, vendor-locked технологий, вроде VC от HPE или LPAR от Hitachi.

Несколько IPMI из одной консоли

Для настройки блейд-серверов можно использовать встроенные модули аппаратного управления BMC (iLO в случае HPE). Механизм администрирования и удаленного подключения мало отличается от обычного сервера, но сами управляющие модули Onboard Administrator (OA) могут резервировать друг друга и предоставляют единую точку входа для управления всеми устройствами в шасси.

OA могут быть со встроенной консолью KVM для подключения внешнего монитора, либо с одним лишь сетевым интерфейсом.

В общем и целом, администрирование через OA выглядит следующим образом:

-

Вы подключаетесь к веб-интерфейсу консоли Onboard Administrator. Здесь можно посмотреть состояние всех подсистем, отключить или извлечь лезвие, обновить прошивку и т.п.

-

Если нужно добраться до консоли конкретного сервера – выбираете его в списке оборудования и подключаетесь к его собственному iLO. Тут уже весь привычный набор IPMI, включая доступ к образам и перезагрузку.

Еще лучше – подключить блейд-систему к внешнему управляющему ПО вроде HPE Insight Control или сменившей ее OneView [12]. Тогда можно настроить автоматическую установку операционной системы на новое лезвие и распределение нагрузки кластера.

К слову о надежности – блейды ломаются точно так же, как обычные серверы. Поэтому при заказе конфигурации не пренебрегайте резервированием компонентов и внимательным изучением инструкций по прошивке. Если подвисший Onboard Administrator доставит лишь неудобства администратору, то неправильное обновление прошивок всех элементов блейд-системы чревато ее неработоспособностью.

Но за всей этой магией мы совсем забыли о приземленных материях.

Нужен ли блейд в вашей компании

Высокая плотность, небольшое количество проводов, управление из одной точки – это все хорошо, но оценим и стоимость решения. Предположим, в абстрактной организации нужно запустить разом 10 одинаковых серверов. Сравним стоимость блейдов и традиционных стоечных моделей HPE ProLiant DL. Для простоты оценки не беру в расчет стоимость жестких дисков и сетевого оборудования.

Блейды:

| Наименование | Модель | Количество | Стоимость |

| Шасси | HPE BladeSystem c7000 | 1 | 603 125 ₽ |

| Блок питания | 2400W | 4 | - |

| Модуль управления | HPE Onboard Administrator | 1 | - |

| Модуль сети | HPE Pass-Thru | 2 | 211 250 ₽ |

| Лезвие | HPE ProLiant BL460c Gen8 | 10 | 4 491 900 ₽ |

| Процессор | Intel Xeon E5-2620 | 20 | - |

| Оперативная память | 8 Гб ECC Reg | 40 | - |

| Итого: | 5 306 275 ₽ |

Цены актуальны на 06.02.2017, источник – STSS [13]

Аналоги – HP ProLiant DL360p Gen8 [14]:

| Наименование | Модель | Количество | Стоимость |

| Платформа | HP ProLiant DL360p Gen8 | 10 | 3 469 410 ₽ |

| Процессор | Intel Xeon E5-2620 | 20 | - |

| Блок питания | 460W | 20 | - |

| Оперативная память | 8 Гб ECC Reg | 40 | - |

| Итого | 3 469 410 ₽ |

Цены актуальны на 06.02.2017, источник – STSS [13]

Разница почти в два миллиона рублей, при этом я не закладывал полную отказоустойчивость: дополнительный модуль управления и, в идеале, еще одно шасси. Плюс, лишаемся удобной сетевой коммутации из-за использования самых дешевых pass-thru модулей для простого вывода сетевых интерфейсов серверов наружу. VIrtual Connect был бы здесь более уместен, но цена…

Получается, что "в лоб" экономии не выйдет, поэтому перейдем к остальным плюсам и минусам блейдов.

Еще немного аргументов

К очевидным плюсам блейд-систем можно отнести:

-

Плотность установки. Если нужно много-много серверов в одном ДЦ, блейды похожи на спасение;

-

Аккуратная и компактная кабельная инфраструктура за счет гибкой внутренней коммутации блейдов;

-

Удобство управления – всей корзиной можно управлять из одной консоли и без установки дополнительного ПО;

-

Легкая установка новых лезвий, пока есть место в шасси – прямо как с дисками в корзинах с горячей заменой. В теории, можно сразу при установке лезвия загружать настроенную систему по PXE и распределять ресурсы в кластере;

- Надежность. Практически все узлы могут быть зарезервированы.

Но как же без минусов:

-

Ограниченность лезвия. Если нужен сервер с четырьмя процессорами и большим количеством локальных жестких дисков (например, NMVE SSD), то установка столь крупного лезвия в четверть всей емкости шасси делает бессмысленным использование корзины высокой плотности;

-

Надежность. Несмотря на дублирование компонентов присутствует единая точка отказа – коммуникационная плата (бэкплейн) шасси. При сбое могут отказать все лезвия;

-

Невозможность разделения. Если нужно создать территориально распределенный кластер, нельзя просто вытащить и перевезти половину серверов – потребуется еще одно шасси;

- Стоимость. Само по себе шасси стоит как три лезвия, а лезвие стоит как полноценный сервер.

Так что же выбрать

Блейды очень органично смотрятся в действительно крупных ЦОД, вроде хостинговых компаний. В таких сценариях на первое место выходит скорость масштабирования и максимальная плотность размещения оборудования – экономия на пространстве и администрировании вполне может окупить и корзину, и всякие Virtual Connect.

В остальных случаях более разумным и универсальным видится применение обычных стоечных серверов. Кроме того, широкое распространение быстрых систем виртуализации еще больше снизило популярность блейдов, так как большинство приложений можно "уплотнить" и с помощью виртуальных серверов. Что уж говорить, управлять виртуальными машинами еще удобнее, чем блейдами.

Если вам доводилось использовать блейд-системы в не самых крупных компаниях – поделитесь впечатлениями от администрирования.

Автор: Сервер Молл

Источник [15]

Сайт-источник PVSM.RU: https://www.pvsm.ru

Путь до страницы источника: https://www.pvsm.ru/sistemnoe-administrirovanie/248331

Ссылки в тексте:

[1] HPE Superdome: https://www.hpe.com/ru/ru/servers/superdome.html

[2] уже обсуждались: https://habrahabr.ru/post/143999/

[3] BladeSystem c7000: https://www.hpe.com/ru/ru/product-catalog/storage/disk-enclosures/pip.hpe-bladesystem-c7000-enclosures.1844065.html

[4] HPE ProLiant BL460c Gen9: https://www.hpe.com/ru/ru/product-catalog/servers/proliant-servers/pip.hpe-proliant-bl460c-gen9-server-blade.7271227.html

[5] HPE ProLiant DL360 Gen9: https://servermall.ru/catalog/model-hp-dl360-gen9/461-1/

[6] HPЕ StorageWorks D2200sb: https://habrahabr.ru/company/hpe/blog/112484/

[7] HPE StorageWorks X1800sb: http://h20564.www2.hpe.com/hpsc/doc/public/display?docId=emr_na-c01794572

[8] HPE Pass-Thru: https://www.hpe.com/us/en/product-catalog/options/pip.bladesystem-modules.3176854.html

[9] Cisco Catalyst 3020: http://www.cisco.com/c/en/us/products/switches/catalyst-blade-switch-3020-hp/index.html

[10] HPE Virtual Connect: https://www.hpe.com/ru/ru/integrated-systems/virtual-connect.html

[11] IBM BladeCenter Virtual Fabric: http://bladecenter.lenovofiles.com/help/index.jsp?topic=%2Fcom.lenovo.bladecenter.io_39Y9267.doc%2Fio_c_esm_snet_vf10g_product_page.html

[12] OneView: https://habrahabr.ru/company/pc-administrator/blog/311644/

[13] STSS: http://www.stss.ru

[14] HP ProLiant DL360p Gen8: https://servermall.ru/catalog/model-hp-dl360p-gen8/441-2/

[15] Источник: https://habrahabr.ru/post/323386/?utm_source=habrahabr&utm_medium=rss&utm_campaign=best

Нажмите здесь для печати.