Сегодня попробуем на себе популярный в блогосфере жанр Кассандры — негативных пророчеств. Итак, “общеизвестно”, что зима близко, человечество во всём достигло пределов роста и мы доживаем последние спокойные деньки перед неминуемым скатыванием в новые темные века. Последним источником техно оптимизма и самым ярким символом прогресса, который противостоял последние 20 лет многим стагнирующим процессам на планете стало бурное развитие микроэлектроники. Пришло время сорвать покровы и с этой области.

Казалось бы, прогресс сейчас быстр как никогда и любой пользователь смартфона расскажет вам о всё более и более быстрых процессорах, которые появляются в новых моделях. Но на крайнем севере уже потянуло холодком от стены, защищавшей нас от регресса. Там, где максимальная производительность микроэлектроники действительно нужна — в области суперкомпьютеров на самых передовых границах — прогресс остановился.

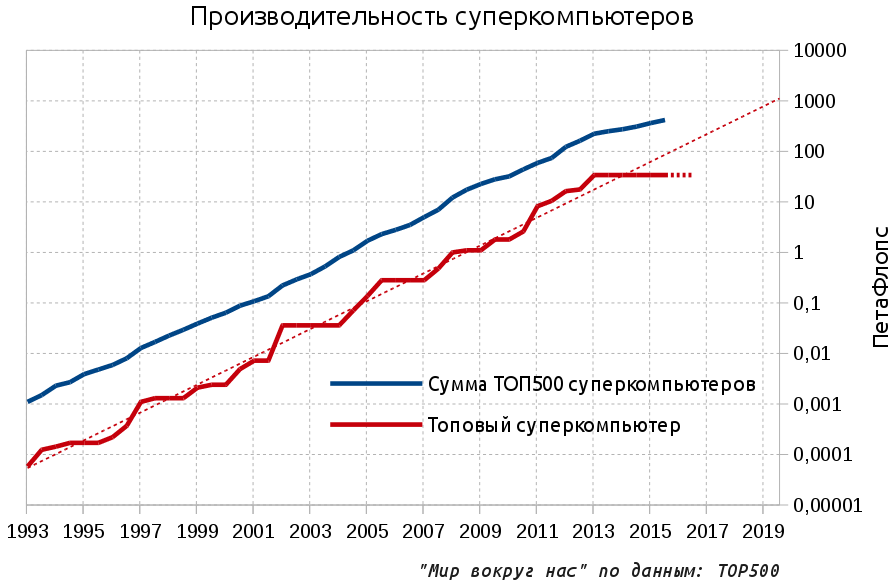

Как видно из графика, уже три года производительность топового суперкомпьютера (выраженная в операциях с плавающей точкой в секунду — FLOPS) не растёт. Более того, если заглянуть в анонсированные планы, то можно с уверенностью сказать, что ситуация не изменится как минимум в ближайший год. А значит стагнация производительности топового суперкомпьютера распространится и на 2016 год:

Пунктирами обозначены экспоненциальный тренд развития и прогноз для топового суперкомпьютера на 2016 год (стагнация). Коротко о матчасти: в статье используются приставки Пета и Экса. ПетаФлопс — 10^15 операций в секунду, а необходимое и обсуждаемое тысячекратное будущее — ЭксаФлопс, 10^18.

Для продолжения экпоненциального тренда суперкомпьютеры должны выйти на масштаб ЭксаФлопса в 2019 году, а сейчас в планах лишь около 100 ПетаФлопс для 2018 года — Aurora. Но в чём собственно проблема?

По моему опыту даже многие профессиональные разработчики софта и железа не смогут вам сказать в чём важность суперкомпьютеров. В современном мире, в веке всепроникающего интернета, огромные залы, набитые стойками железа и посвящённые обработке одной сложной вычислительной задачи кажутся уделом романтического прошлого начала компьютерной эпохи 1960х-70х. Ведь сегодня ресурсов даже одного личного компьютера хватает для решения многих сложных задач, а коммерчески доступные сервера позволяют обслуживать нужды огромных компаний. А ведь есть и популярные облачные вычислительные сервисы, обещающие вам бесконечные вычислительные ресурсы за скромное вознаграждение.

Но на самом деле суперкомпьютеры это то единственное, что даёт сегодняшнему семимиллиарному человечеству возможность продолжать развиваться и жить, не опасаясь мальтузианского проклятья.

Все передовые задачи можно решить только с помощью очень больших вычислительных мощностей и суперкомпьютер, где максимально оптимизируются все компоненты вычислительной техники, это самое подходящее средство для решения этих задач. Более того, прямое компьютерное моделирование можно интерпретировать как третий научный метод познания в довесок к теоретическим и экспериментальным изысканиям. Чтобы не быть голословным приведём несколько примеров.

О нефти матушке, которую уже давно почти невозможно найти без мощных компьютеров, мы уже писали и вывод был категоричен: утром суперкомпьютер — вечером нефть, вечером суперкомпьютер — утром нефть. Посмотрим и другие темы.

Авиация

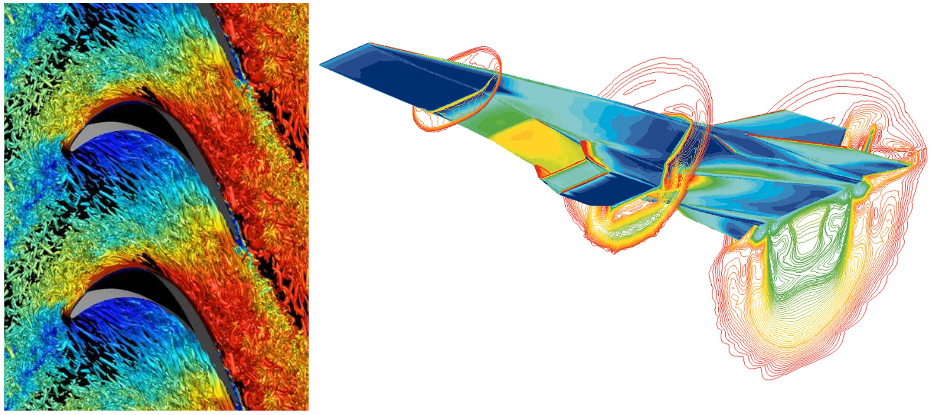

В проектировании новых самолётов компьютерная симуляция позволила снизить количество физических тестов в аэродинамической трубе с 77 штук в 1979 до 11 в 1995 году и с тех пор значение остаётся на том же уровне. В чём-то из-за этого наши самолёты и остались примерно там же, где были. Переход на принципиально более точную физическую симуляцию на основе прямого применения уравнений навье-стокса требует вычислительных возможностей порядка 50 эксафлопс, то есть в 1000 раз больше чем у современного лидера — китайского Тянхэ-2 на 33 ПетаФлопс. При этом расчёт внешней аэродинамики ещё относительно прост — но, например, типичный двигатель состоит из тысяч движущихся частей и моделирование внутренних потоков потребует ещё более высокой вычислительной мощности.

Вычислительная гидродинамика применительно к лопаткам турбины (слева) и летательному аппарату X-43 при числе маха = 7

Термоядерная энергетика

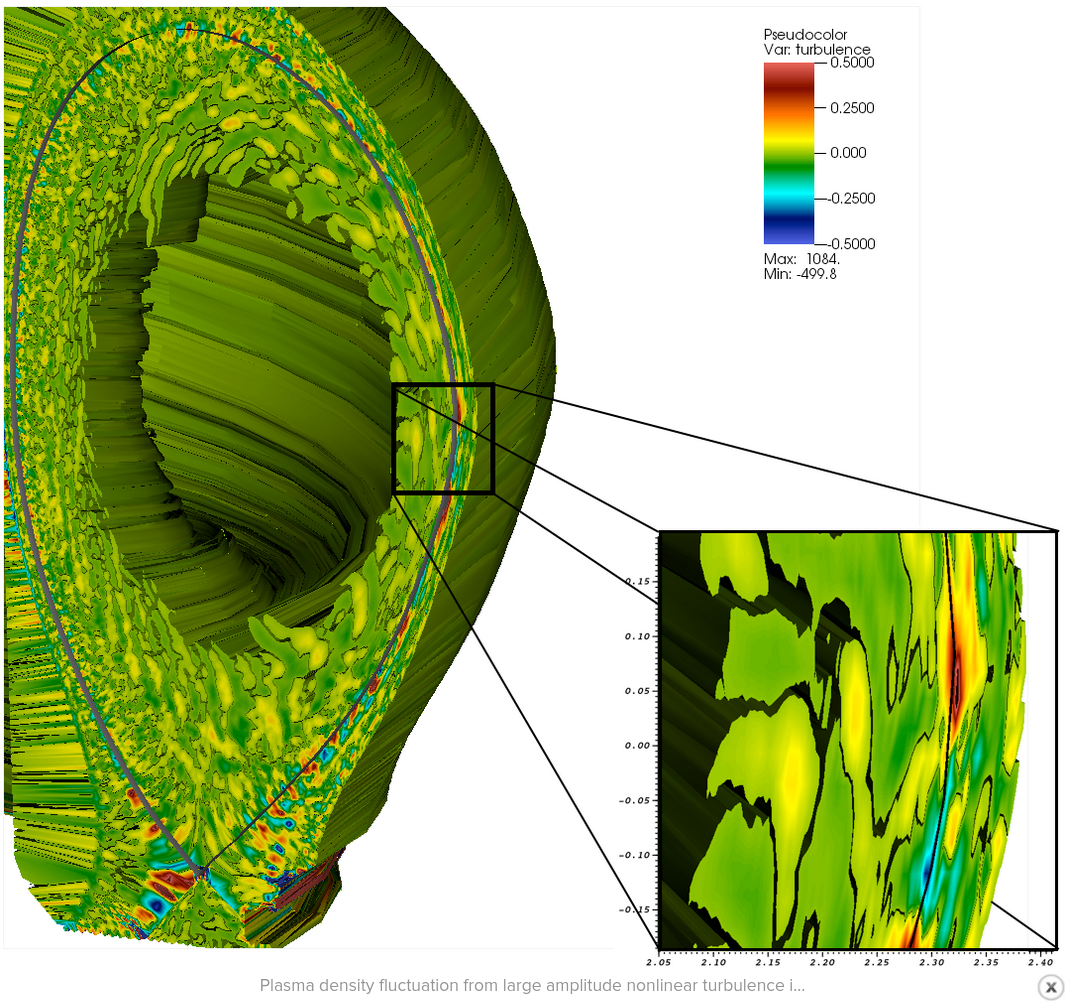

В области термоядерной физики, о которой увлекательно пишет коллега tnenergy, проектирование следующего поколения токамаков невозможно без прогресса в моделировании высокотемпературной плазмы в условиях магнитной ловушки. Уже сейчас в моделях участвуют несколько миллиардов частиц в пространстве с разрешением 131 млн точек. Для таких масштабов используются самые мощные системы порядка ПетаФлопса и получены неплохие результаты, но ясно, что достаточной точности полной симуляции на базовых принципах понадобится увеличить масштаб в скромные 13 миллионов раз.

Моделирование поведения плазмы в токамаке

Климат и погода

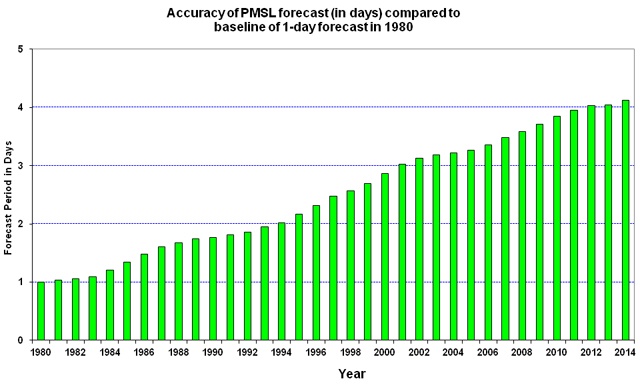

Моделирование климата и точное предсказания погоды позволяют оптимально планировать наши действия — точность прогнозов растёт вместе с ростом производительности суперкомпьютеров. В перспективе можно будет предсказывать ливневые осадки и соответственно, наводнения и сели. Засухи и неурожаи.

Сегодня метеопрогноз на 4 дня столь же точен, как в 1980 году на один день

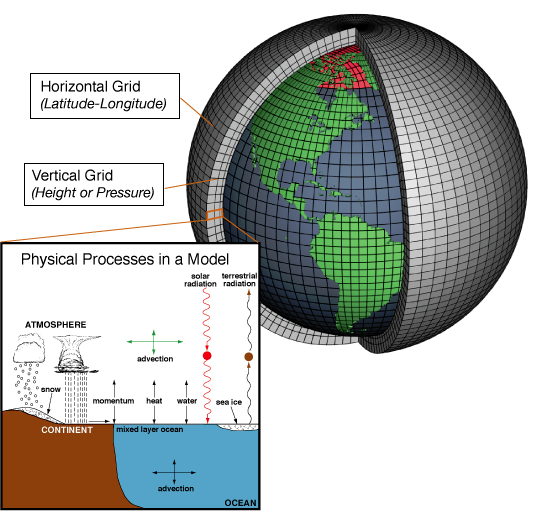

Всё более точные предсказания требуют более детальной модели планетарного масштаба и необходимо постоянное уменьшение ячейки симуляции. На данный момент ячейки моделей для краткосрочных региональных прогнозов имеют размеры 10х10 км, а долгосрочные климатические модели используют сетку с ячейками в сотни км, в то время как необходим масштаб 1х1 км по поверхности (в 10000 раз крупнее чем сейчас) и 100 метров по вертикали. Да с периодизацией в 1 секунду, что для двух месяцев означает 5 млн. секунд.

Пример современной модели с ячейкой 300х300 км.

Медицина и биология.

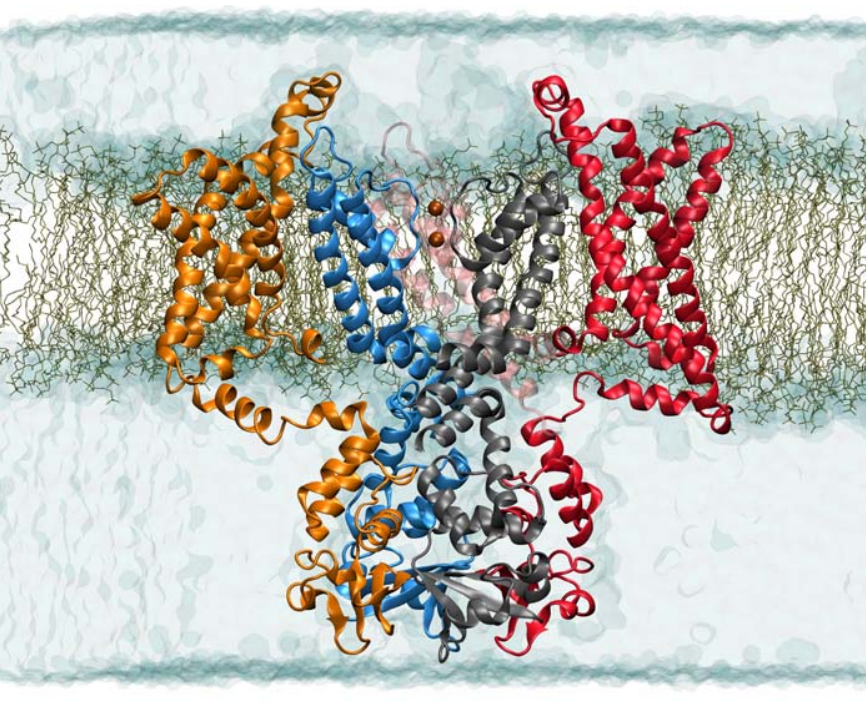

Не является исключением и медицина. На сегодня топовые суперкомпьютеры способны моделировать лишь отдельные сверхмалые части клеток:

На рисунке результат моделирования работы ионных каналов в мембране клетки на топовых суперкомпьютерах — а задействовано всего-то около 100 тысяч молекул. При этом всего молекул в клетке человека миллиарды, а самих клеток — почти квадриллион (10^14). Процесс получения новых лекарств и вывод их на рынок занимает 5-15 лет и уже сейчас идут разговоры о новых концепциях в драг-дизайне. Только представьте, насколько можно ускорить процесс и повысить эффективность лекарств, если моделировать ситуацию комплексно — начиная от ДНК возбудителя, в которой, по сути, заключена вся информация о нём и заканчивая моделью человеческого тела с учётом индивидуальных генетических особенностей.

Реальный список гораздо, гораздо больше: поиск принципиально новых материалов с заданными свойствами, астрофизика, атомная энергетика и многое многое другое.

Бухгалтерия экспоненты

Встаёт вопрос: если выгоды так велики, то почему мы не вкладываем действительно крупные деньги в мощные суперкомпьютеры? Дело в том, что до сих пор на нашей стороне была экспонента, а именно экспонента Мура — каждые 18-24 месяца плотность транзисторов удваивается и до самого недавнего времени это означало, что и производительность удваивается тоже.

Поэтому студентов геймеров мучил постоянный вопрос: “Нужно ли покупать комп сегодня за $2000 баксов или брать что-то попроще за $1000?” Ведь на оставшуюся $1000 через 3-4 года можно будет купить комп в пару раз мощнее. Это не удивительно, ведь линейная функция всегда проигрывает экспоненциальной и умножение стоимости давало в лучшем случае такое же линейное умножение производительности вместо степенной зависимости в случае экспоненты. Как правило, бюджет у студентов был не резиновый и выбор падал на второй вариант, но иногда хотелось попонтоваться, брали разпальцованый вариант и уже через пару лет зло смотрели на эту старую рухлядь.

Аналогичный процесс, но в гораздо более серьёзной обстановке, происходил и во время обсуждений новых суперкомпьютеров. В большинстве случаев выбирали более умеренный, но продуктивный путь. Показательно, что за последние 20 лет только три компьютера стоили больше 300 миллионов долларов и все три были построены за пределами США: два в Японии и один сегодняшний лидер в Китае, в странах с претензией на мировое лидерство. Ведь кроме реальной выгоды, иметь свой суперкомпьютер на первой строчки рейтинга стало предметом национальной гордости в доказательство факта существования национальной передовой науки.

Конец экспоненты

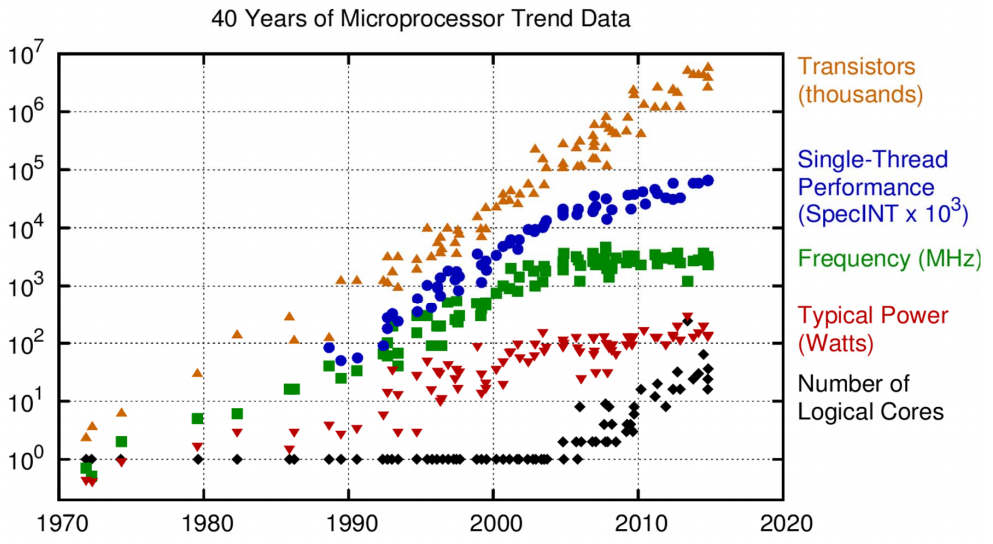

Из года в год раздаются возгласы, что закон мура близок к концу и пока вроде бы это всё страшилки. Но при желании уже можно разглядеть отдельных всадников апокалипсиса:

Выше пять трендов для различных характеристик микропроцессоров. Закон Мура вроде как бы продолжается: оранжевым отмечено количество транзисторов на единицу площади с удвоением каждые 18-24 месяца. С 2005 года параметр вырос в 100 раз, но радости от этого уже не так много — синим отмечана производительность одного ядра и рост за тот же срок уже менее чем в 10 раз. Остальные транзисторы пошли на увеличение количества ядер, позволяющих обрабатывать задачи параллельно (чёрным).

В 2005 году можно было приобрести процессор с тактовой частотой 3,8 ГГЦ, а вот сейчас процессоров Интел с тактовой частотой выше 4 ГГц не купить. К графику это относится прямо: частота процессора, ответственная до этого за половину роста производительности, практически не менялась с 2004 года (зелёным), так же как и потребление энергии (красным), которое уперлось в возможности отвода тепла.

Эти тренды абсолютно симметрично проявляются и в архитектуре суперкомпьютеров. Если взять сегодняшнего китайского рекордсмена, то там мы видим и один из самых высоких показателей по энергопотреблению (18 МВт), и огромное количество вычислительных ядер и даже регресс по цене за ПетаФлопс. Всё это позволило построить суперкомпьютер всего лишь в два раза производительнее чем предыдущий конкурент.

Отвергнем буржуазную экспоненту ради коммунистической линейки !

Военнослужащие кибернетических войск Китая удаляют закладки из процессоров Intel Xeon.

Если компьютеры так важны, почему бы просто не продолжить китайский путь и сделать суперкомпьютер побольше, а потом и ещё побольше? Нужно понимать, что любое увеличение производительности за счёт линейного увеличения масштаба это не только увеличение долларовой цены, но и такое же линейное увеличение в потреблении энергии. Если взять китайского монстра с тремя миллионами ядер и попытаться масштабировать его с уровня 33 ПетаФлопс до уровня 30 ЭксаФлопс, то потребуется выделить в эксклюзивное пользование два десятка новеньких атомных реакторов, а это соответствует всем реакторам которые сейчас строятся в Китае. Если это ещё можно как-то затянув пояс потянуть, то уровень 30 ЗеттаФлопс с его 20’000 реакторами для нас закрыт навсегда.

Есть ли выход

Можно ли всё-таки продолжить экспоненту? На ближайшие годы — да, всё ещё можно. Через 2-3 года выйдут суперкомпьютеры примерно в три раза мощнее топового китайского и с лучшими параметрами потребления энергии и стоимости ПетаФлопс. А что будет дальше?

Лично я точно не знаю, но эксперты не очень оптимистичны. Например, директор Майкрософта посетил в конце октября официальный форум, посвящённый разработке будущей ЭксаФлопс-системы в США. На форуме были все ведущие производители железа, а также представители различных гос.агентств, разрабатывающие и использующие суперкомпьютеры.

Всем участникам форума очевидно:

Современная микроэлектроника на базе технологии CMOS подходит к концу своих возможностей.

Нет альтернативной технологии, которая будет доступна в течение ближайших десяти лет.

Проще говоря, в ближайшие 10 лет существующая парадигма закончится, а другой парадигмы у нас для вас нет.

Автор: 150Rus