Завершилось соревнование по дата-майнингу Heritage Health Prize

Крупнейшее со времен Netflix Prize соревнование в области анализа больших массивов данных подошло к концу. И хотя официальные результаты первой десятки и победитель будут объявлены через два месяца, итоги уже можно подводить.

Целью было спрогнозировать госпитализацию пациентов в течение будущего года на основании данных за предыдущие два года лечения. По замыслу спонсора это позволит больше внимания уделять именно тем пациентам, которые больше всего в нем нуждаются, за счет чего сэкономить часть из 30 млрд. $, ежегодно затрачиваемых в США на госпитализацию.

Заявленный организаторами приз в 3 000 000$ был недостижим из-за установленного предела точности в 0.4 RMSLE(меньше-лучше; лучший достигнутый результат 0.46; разница между первым и сотым местом 0.008; RMSLE — среднеквадратическое отклонение логарифма ошибки) и предоставленных данных — в них просто не содержалось достаточного для достижения такого уровня точности количества информации. Поэтому фактически борьба шла за 500 000$, достающиеся лучшей команде, фонд промежуточных финишей и бесценный опыт.

Несмотря на сложность задачи, желающих попробовать свои силы набралось более полутора тысяч. Говорят, что в конкурсе даже участвовали два нобелевских лауреата, но кто это был и каковы успехи не признаются. Учитывая, что в области математики и программирования их не бывает, остается медицина — в качестве консультанта или экономика.

Соревнование длилось два года и имело три промежуточных финиша, на каждом из которых было два призовых места. Победители, по условиям конкурса, выкладывали описание своих методов. Однако соперникам это не сильно помогало, дело в том, что основные алгоритмы хорошо известны — это деревья решений [1], Random Forest(случайный лес) [2], Gradient Boosting [3], Градиентный спуск [4], Ridge Regression(гребневая регрессия, регуляризация Тихонова) [5] их модификации и комбинации. Отличия заключались в тонкостях реализации, использования, комбинирования и небольших вариациях самих алгоритмов. Однако деталей получалось так много, что не было понятно — за счет чего собственно достигается результат. То есть, что победители делают — понятно, не понятно почему они делают именно это, и почему то, что они делают работает.

По промежуточным финишам победители распределились так:

- 1. Market Makers 2. Willem Mestrom

- 1. Market Makers 2. Edward & Willem

- 1. Edward & Willem 2. crescendo

Странности начались перед третьим промежуточным финишем — все три команды почти не использовали разрешенную раз в день проверку модели по 30% тестовых данных и лидер сменился без боя. Причиной оказалось объединение в одну команду, при этом нельзя было превысить лимит отправленных моделей за все время с начала конкурса — чудом уложились.

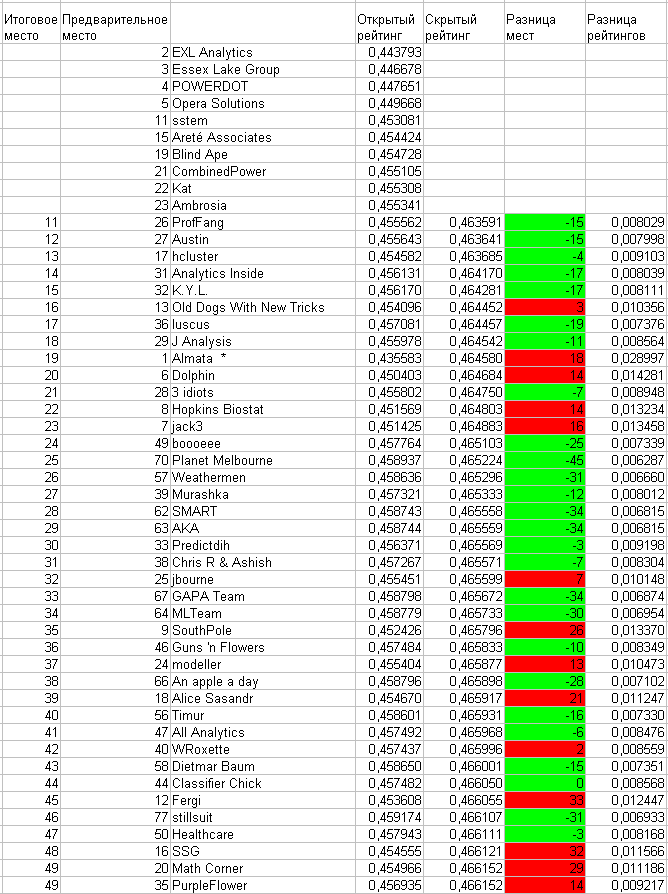

В день финиша предварительные результаты по 30% тестовых данных выглядели так [6].

Но самое интересное было в результатах по скрытой части [7], опубликованных через несколько дней, открывающих истинные оценки работы алгоритмов.

Сводная таблица для первых 50-ти мест:

Самым большим врагом в данном соревновании был эффект, который наиболее ярко можно наблюдать у команды, занимавшей первое место по открытому рейтингу Almata. Это overfitting — переподгонка. Они добыли всю полезную информацию из набора данных по которым считался рейтинг, основываясь на оценках рейтинга, и вместе с ней захватили вредную, специфическую для набора информацию, в результате чего ухудшили(или по крайней мере не улучшили) оценку для неизвестных данных. Итог — перемещение с 1-го на 19-е место.

Победитель и оценки первых 10-ти участников будут официально объявлены в начале июня на конференции Health Datapalooza IV. Однако почти нет сомнений в победе POWERDOT — команды образованой слиянием победителей промежуточных финишей. Имея в своем распоряжении 3 лучших результата они получили возможность неявно обучаться по скрытой части рейтинга, после чего бороться с ними стало невозможно. Зато поучиться было чему.

Для меня это отразилось в перемещении с 261-го места по итогам последнего промежуточного финиша на 27-е по финальным результатам.

Описание методов победителей промежуточных финишей (из их комбинации наверняка и будет составлен алгоритм победитель) можно почитать здесь [8] (много математики и маневров, которых я до сих пор не понимаю).

Автор: kuskus

Источник [9]

Сайт-источник PVSM.RU: https://www.pvsm.ru

Путь до страницы источника: https://www.pvsm.ru/data-mining/31782

Ссылки в тексте:

[1] деревья решений: http://ru.wikipedia.org/wiki/%D0%94%D0%B5%D1%80%D0%B5%D0%B2%D0%BE_%D0%BF%D1%80%D0%B8%D0%BD%D1%8F%D1%82%D0%B8%D1%8F_%D1%80%D0%B5%D1%88%D0%B5%D0%BD%D0%B8%D0%B9

[2] Random Forest(случайный лес): http://ru.wikipedia.org/wiki/Random_forest

[3] Gradient Boosting: http://en.wikipedia.org/wiki/Gradient_boosting

[4] Градиентный спуск: http://ru.wikipedia.org/wiki/%D0%93%D1%80%D0%B0%D0%B4%D0%B8%D0%B5%D0%BD%D1%82%D0%BD%D1%8B%D0%B9_%D1%81%D0%BF%D1%83%D1%81%D0%BA

[5] Ridge Regression(гребневая регрессия, регуляризация Тихонова): http://en.wikipedia.org/wiki/Tikhonov_regularization

[6] так: http://www.heritagehealthprize.com/c/hhp/leaderboard

[7] результатах по скрытой части: https://www.heritagehealthprize.com/PrivateLeaderboard

[8] здесь: https://www.heritagehealthprize.com/c/hhp/details/milestone-winners

[9] Источник: http://habrahabr.ru/post/176267/

Нажмите здесь для печати.