Какая часть веба заархивирована

Машина времени [1] Internet Archive — самый большой и известный архив, который сохраняет веб-страницы с 1995 года. Кроме него существует с десяток других сервисов, которые тоже архивируют веб: это индексы поисковых систем и узкоспециализированные архивы вроде Archive-It [2], UK Web Archive [3], Web Cite [4], ArchiefWeb [5], Diigo [6] и др. Интересно узнать, как много веб-страниц попадает в эти архивы, относительно общего числа документов в интернете?

Известно, что база Internet Archive за 2011 год содержит более 2,7 миллиарда URI [7], многие из них в нескольких копиях, сделанный в разные моменты времени. Например, главную страницу Хабра «сфотографировали» уже 518 раз, начиная с 3 июля 2006 года [8].

Известно также и то, что база ссылок Google пять лет назад перешагнула отметку в триллион уникальных URL [9], хотя многие документы там дублируются. Компания Google не в силах проанализировать все URL, так что компания решила считать количество документов в интернете бесконечным.

В качестве примера «бесконечности веб-страниц» Google приводит веб-приложение календарь. Нет смысла скачивать и индексировать все его страницы на миллионы лет вперёд, ведь каждая из страниц генерируется по запросу.

Тем не менее, учёным интересно хотя бы примерно узнать, какая часть веба заархивирована и сохранена для потомков. До настоящего момента никто не мог ответить на этот вопрос. Специалисты из Old Dominion University в Норфолке провели исследование [10] и получили приблизительную оценку.

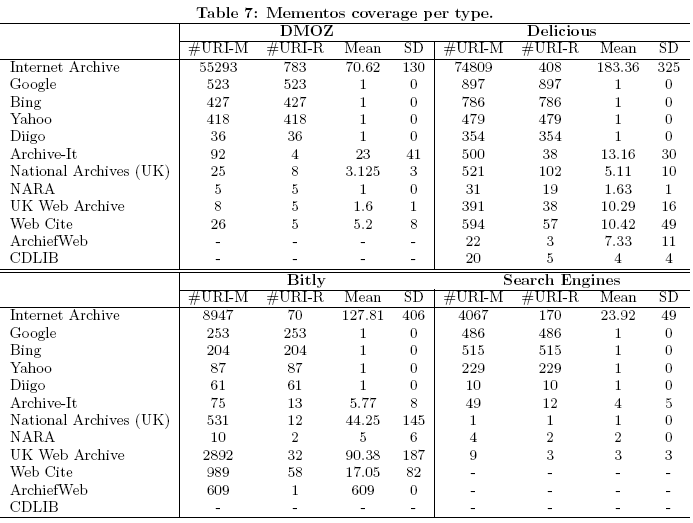

Для обработки данных они использовали HTTP-фреймворк Memento [11], который оперирует следующими понятиями:

- URI-R для идентификации адреса оригинального ресурса.

- URI-M для идентификации заархивированного состояния этого ресурса в момент t.

Соответственно, у каждого URI-R может быть ноль или больше состояний URI-M.

С ноября 2010 года по январь 2011 года продолжался эксперимент по определению доли публично доступных страниц, которые попадают в архивы. Поскольку количество URI в интернете бесконечно (см. выше), то нужно было найти приемлемую выборку, которая репрезентативна для всего веба. Здесь учёные использовали комбинацию из нескольких подходов:

- Выборка из каталога Open Directory Project (DMOZ).

- Случайная выборка URI из поисковых систем, как описано в работе Зива Бар-Йозефа и Максима Гуревича “Random sampling from a search engine's index” (Journal of the ACM (JACM), 55(5), 2008).

- Последние из добавленных URI на сайт социальных закладок Delicious, с помощью генератора Delicious Recent Random URI Generator.

- Сервис сокращения ссылок Bitly, ссылки выбирали с помощью генератора хэшей.

По практическим причинам, размер каждой выборки ограничили тысячей адресов. Результаты анализа показаны в сводной таблице для каждой из четырёх выборок.

Исследование показало, что от 35% до 90% всех URI в интернете имеют хотя бы одену копию в архиве. От 17% до 49% URI имеют от 2 до 5 копий. От 1% до 8% URI «сфотографированы» 6-10 раз, а от 8% до 63% URI — 10 и более раз.

С относительной уверенностью можно сказать, что не менее 31,3% всех URI архивируются раз в месяц или чаще. Как минимум для 35% всех страниц в архивах есть хотя бы одна копия.

Естественно, вышеуказанные цифры не относятся к так называемой Глубокой сети (Deep Web), к которой принято относить динамически генерируемые страницы от БД, запароленные справочники, социальные сети, платные архивы газет и журналов, флэш-сайты, цифровые книги и прочие ресурсы, которые спрятаны за файрволом, в закрытом доступе и/или недоступны для индексирования поисковыми системами. По некоторым оценкам [12], Глубокая сеть может быть на несколько порядков больше по размеру, чем поверхностный слой.

Автор: alizar

Источник [13]

Сайт-источник PVSM.RU: https://www.pvsm.ru

Путь до страницы источника: https://www.pvsm.ru/poiskovy-e-mashiny-i-tehnologii/24211

Ссылки в тексте:

[1] Машина времени: http://archive.org/web/web.php

[2] Archive-It: http://archive-it.org

[3] UK Web Archive: http://www.webarchive.org.uk

[4] Web Cite: http://www.webcitation.org

[5] ArchiefWeb: http://archiefweb.eu

[6] Diigo: http://www.diigo.com

[7] более 2,7 миллиарда URI: http://habrahabr.ru/post/156349/

[8] 3 июля 2006 года: http://web.archive.org/web/20060703164902/http://www.habrahabr.ru/

[9] триллион уникальных URL: http://googleblog.blogspot.com/2008/07/we-knew-web-was-big.html

[10] исследование: http://arxiv.org/abs/1212.6177

[11] Memento: https://datatracker.ietf.org/doc/draft-vandesompel-memento/

[12] некоторым оценкам: http://quod.lib.umich.edu/cgi/t/text/text-idx?c=jep;view=text;rgn=main;idno=3336451.0007.104

[13] Источник: http://habrahabr.ru/post/164975/

Нажмите здесь для печати.