В последнее время все чаще звучат идеи — что капча переоценена, и что развитие ИИ технологий медленно но верно убивает индустрию сервисов распознавания капчи.

«Нейросеть научилась решать капчу лучше человека», «сервисы распознавания капчи все», «ИИ решает капчу быстрее человека» и так далее в том же духе. А давайте разберемся в этом чуть глубже — есть ощущение, что не все так однозначно, как кажется на первый взгляд.

Введение

Идея полностью автоматического распознавания капчи выглядит идеально: отправляем задачу в модель и получаем ответ за считанные секунды — не жизнь, а мечта. Но если все настолько просто — почему рынок сервисов распознавания капчи продолжает жить и до сих пор не рухнул под натиском армии ИИ агентов, щелкающих капчи как орешки? Что‑то не возникает в информационном пространстве новостей о закате эпохи, скорее наоборот, сервисы распознавания капчи вроде 2captcha или SolveCaptcha продолжают работать и выполнять свое предназначение — решать капчи.

А объяснение достаточно тривиальное — на практике процесс обхода только лишь с использованием ИИ является большой проблемой. И вот почему…

Проблема: комплексный анализ трафика

Главная проблема в комплексном анализе — капча давно перестала быть простой задачей в формате «распознай текст на картинке» и система поверит тебе, что ты реальный человек. Из плоскости — реши задачу и докажи что ты не робот, мы переместились в плоскость — реши задачу и докажи все своим окружением что ты не робот (не хватает — «Мамой поклянись»).

Антибот‑системы уже давно не оценивают только ответ на капчу, они анализируют контекст вокруг:

-

браузер

-

устройство

-

историю взаимодействий

-

файлы cookie

-

доверие к сессии

-

фоновые проверки

-

поведение пользователя

-

сетевой трафик

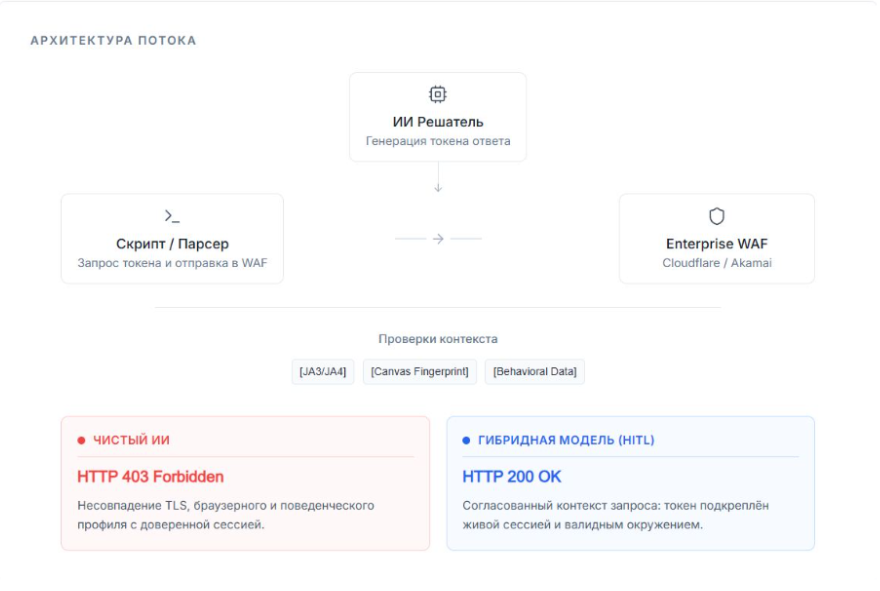

Если скрипт отправляет валидный токен, но имеет дефолтные TLS‑отпечатки (JA3/JA4), утечки WebDriver или нестандартные параметры Canvas/WebGL, WAF отклонит запрос.

Google reCAPTCHA v3 работает как система оценки риска: анализирует взаимодействия пользователя с сайтом и возвращает метрику, по которой сайт решает, пропускать действие, требовать дополнительную проверку или ограничивать доступ.

Cloudflare Turnstile тоже не сводится к одной галочке: сервис сначала запускает небольшие фоновые проверки в браузере и собирает сигналы о посетителе, браузерной среде и поведении.

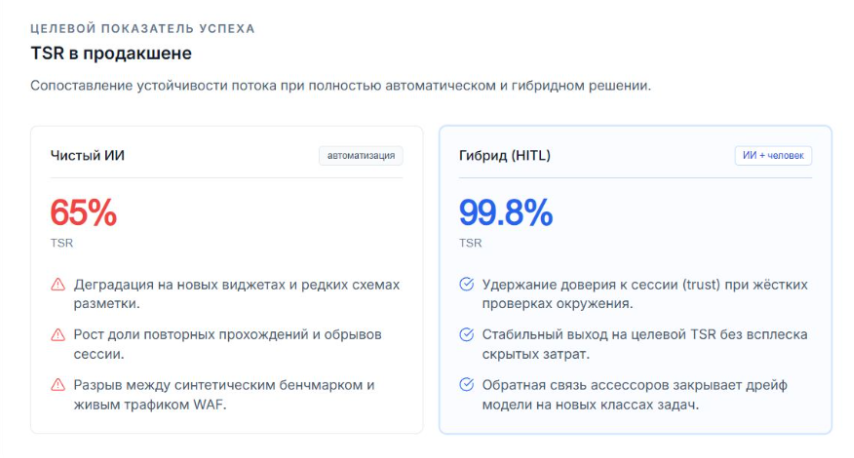

Поэтому чистый ИИ и не способен обойти сложные анти‑бот системы. Он может правильно понять визуальную часть задачи, решить ее но без дополнительных вводных сыпанется на проверке окружения.

Поэтому воспринимать сервисы, использующие только ИИ для решения капчи (SolveCaptcha, Capsolver, Anti‑Captcha, Capmonster) уже стоит только в контексте решения простых капч, а если речь идет про сложные антибот системы — то такие сервисы выступят лишь как один винтик, в механизме убеждения антифрода в том что ваш скрипт или парсер законопослушный пользователь, а не набор алгоритмов.

Данные сервисы проигрывают гибридной модели ИИ + работник (2captcha), которые уже могут решать более сложные типы капч и выступают не как винтик, а как полноценный механизм.

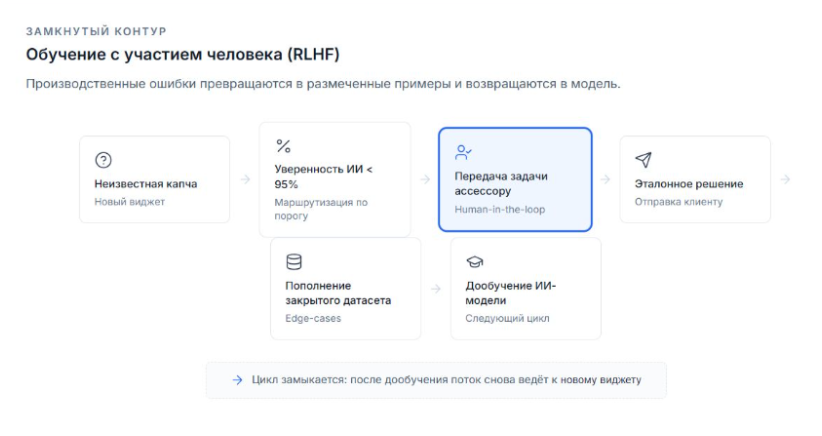

Гибридная модель — связка ИИ + работник. В гибридной модели ИИ решает только простые и массовые капчи. Сложные или редкие задачи уходят работнику. Так звучит теория, но практика несколько глубже. Действительно, растрачивать такой потенциал в виде реального пользовательского опыта было бы расточительством. Каждое решение капчи работником — это уже набор для обучения следующей версии ИИ модели, которая в перспективе сможет решать то, что ей не удалось решить в этот раз и что заставило систему переключиться на человека.

Гибридная модель ИИ + работник технически более выигрышная архитектура: у модели скорость от ИИ, а работник страхует сервис решения с качеством распознавания, и параллельно тренирует систему.

Главная проблемы ИИ подхода

Проблемы ИИ инструментов в решении капчи — не просто случайность, это уже закономерность.

Звучит очень складно — мы решаем капчу за 2 секунды и цена на такое решение в 3 раза ниже чем у конкурентов. Кажется что каждый новый сервис, появляющийся на рынке обхода капчи демпингует цены еще больше, и ставит ставку еще ниже. Но суровая реальность такова, что затраты на развертывание ИИ модели существенно выше маржи от распознавания капчи.

Никто не задается вопросом, а в чем же выгода у такого подхода — решать капчу за копейки и сколько нужно решить этой капчи по экстремально низкой цене, чтобы это окупило дорогущую видеокарту, требуемую для работоспособности средней нейросети (не говоря уже о супер умных моделях). Точную цифру не назову — но она длинная.

Многие такие проекты пока остаются ранними экспериментами или проверками идеи, которые часто двигаются хайпом, а не реальной пользой. А давайте натравим нейронку на капчу, будем собирать заказы и получать деньги, а всю работу будет делать нейросеть — тем более это сейчас в тренде. Ну чистый мед для ушей инвестора, правда?

Но это так просто не работает. Больше не работает и никогда не работало. Причина не в том, что ИИ тупой. Причина в том, что автономный ИИ без контекста, памяти, распределения задач, контроля и человеческой страховки слишком плох для внедрения в реальные процессы.

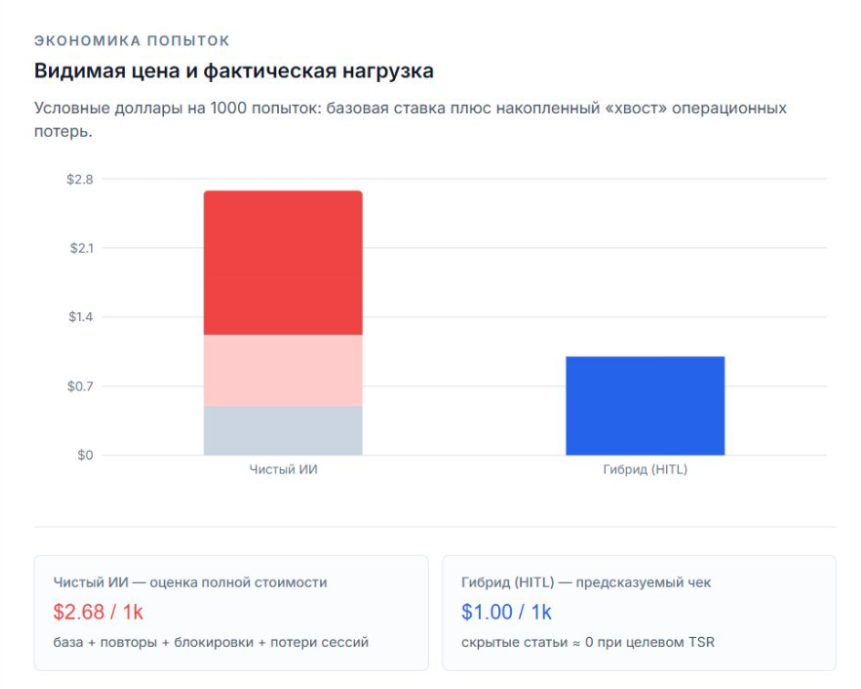

Развертывание автономной ИИ‑инфраструктуры для обработки больших объемов задач требует аренды мощных GPU‑инстансов или эквивалентных затрат на Vision API. При рыночной стоимости $0.5-$1 за 1000 решений маржинальность чистого ИИ‑сервиса критически снижается без учета затрат на разработку и поддержку. Экономика таких проектов часто сходится только при демпинге и игнорировании метрики успешности конечного действия.

На рынке распознавания капчи это заметно особенно жестко. В тестовой среде модель решает знакомую картинку, и выдает поразительные цифры по скорости и точности. В реальном же интернете она сталкивается с поведенческой оценкой, измененными заданиями, подозрительными сессиями, нестандартными инструкциями и задачами, которых не было в обучающей выборке.

Естественно ИИ сервисы в такой ситуации не справляются и провоцируют некачественные решения и задержки.

Почему сервис на базе только ИИ ломается на капче

Чистый ИИ хорошо работает там, где задача похожа на его обучающую выборку. Если модель видела тысячи похожих изображений, одинаковые форматы заданий и стабильные паттерны, она может решать быстро и дешево.

Но капча специально живет в нестабильной среде. Форматы меняются. Картинки шумят. Задания становятся логическими. Виджеты обновляются. Поведенческие проверки уходят в фон. То, что вчера решалось уверенно, завтра может стать пограничным случаем.

У ИИ сервиса есть несколько слабых мест. На примере сервисов вроде CapMonster и Capsolver.

Ложный ответ

Модель может быть уверена в неправильном ответе. Для клиента это хуже, чем честный отказ. Ей то что, она всегда может просто извиниться и сказать, да, ты прав, я ошиблась. А бизнес теряет время и деньги на такой вежливости.

Но такое поведение ИИ провоцирует и другие последствия — сессия получает негативный сигнал, а повторные попытки могут только ухудшить риск‑профиль.

Нет нормальной передачи работнику

Если ИИ не справился, задачу некому закрыть. Сервис либо возвращает ошибку, либо повторяет попытку, либо гоняет задачу между похожими моделями. Это уже не про гарантию качества, о которой пишут маркетинговые лендинги, скорее уж лотерея повторных попыток — повезет или нет.

Нет актуального источника новых данных

Капча постоянно эволюционирует. Если сервис не получает решения от работников, модель со временем устаревает. Чистый ИИ может быть хорош на старых тестах, но слаб на новых реальных заданиях. Не зря же продвинутые антифрод системы используют паттерны поведения реальных пользователей для тренировки своих защитных моделей, причем делают они это на постоянной основе, а ИИ сервисы решения капчи нет (не только лишь все).

Таким образом гонка вооружения идет в одностороннем формате, защитные механизмы эволюционируют, а системы обхода нет

Машинные паттерны выдают автоматизацию

Даже если ИИ правильно определил, куда нужно нажать, он может провалиться на уровне взаимодействия. Повторяемые задержки, слишком ровные последовательности действий, одинаковые сценарии поведения и отсутствие естественной вариативности могут выглядеть подозрительно.

Правда если воспринимать ИИ сервис распознавания капчи, как винтик в сложном механизме, взаимодействие ложится на другие винтики (как уже разработчик спроектировал свой скрипт). Речи про решение капчи «под ключ» в такой ситуации не идет.

Цена ошибки: чистый ИИ может испортить не только капчу

Но давайте отдалимся от внутрянки создания такого сервиса и посмотрим на него со стороны пользователя. Дешевый автоматический решатель выглядит выгодно, если считать только цену одной попытки. Но бизнес платит не за попытку. Бизнес платит за завершенный процесс.

Если модель дает неверный ответ, цикл решения не заканчивается. Появляются повторные попытки, лишние запросы, рост нагрузки, потерянное время и ухудшение риск‑профиля сессии. И кстати, не все ИИ сервисы возвращают деньги за неверно решенные капчи, по сравнению с гибридными, не задумывались почему? Ответ на поверхности. Когда капчу решает человек, он решает ее за деньги и тут все просто, решил — заработал, не решил — не заработал. Сервису есть с кого списать деньги. А если решает ИИ, то ему все равно, верно или нет — токены потрачены, извольте заплатить — правильно или нет, это уже не его проблема, он попытался.

В сценариях, где используются аккаунты, файлы cookie, прогретые браузерные профили и длинные рабочие цепочки, ошибка в распознавании капчи может стоить дороже самой задачи.

|

Метрика |

Чистый ИИ |

Гибридная система (ИИ + Человек) |

|

Ключевой фокус |

Цена одной попытки |

Цена успешно завершенного процесса |

|

Обработка edge‑cases |

Повторные циклы (ошибки, задержки) |

Передача задачи асессору (страховка) |

|

Риск для сессии |

Высокий (цикл ошибок снижает траст) |

Низкий (минимизация неверных ответов) |

|

Актуализация данных |

Деградация модели (обучение на синтетике) |

RLHF (непрерывное дообучение на живых данных) |

Гибридная система снижает этот риск. Простые задачи остаются на ИИ, а сомнительные уходят работнику до того, как серия ошибочных попыток испортит сессию.

Правильная метрика — не «дешевая попытка обойти систему». Правильная метрика — «сколько стоил один успешно завершенный процесс обхода».

Дешевый ИИ может оказаться дорогим

ИИ почти всегда выглядит дешевле на старте. Но если смотреть на боевые условия, появляется скрытая стоимость.

Это стоимость повторных попыток.

Каждая ошибка ИИ создает дополнительные расходы:

-

повторные запросы;

-

лишнюю нагрузку на инфраструктуру;

-

рост задержек;

-

падение общей пропускной способности;

-

ручную диагностику;

-

увеличение доли неудачных решений;

-

риск потери сессии;

-

риск блокировки ценных аккаунтов;

-

ухудшение стабильности автоматизации.

В итоге дешевый решатель может оказаться дорогим, если он требует слишком много повторов.

Гибридный решатель, в свою очередь, может быть дороже на уровне одной сложной задачи, но дешевле на уровне результата. Он не пытается бесконечно давить проблему одной моделью. Он передает сложный случай туда, где вероятность успешного решения выше.

Это и есть нормальная экономика: считать не стоимость попытки, а стоимость успешного решения.

Работник — это не просто мануальный решатель

Главная ошибка — считать работника временной заменой ИИ. В нормальной гибридной архитектуре работник выполняет сразу несколько функций.

Работник как страховка

Когда модель не уверена, задача не проваливается. Она передается человеку. Это особенно важно для сложных визуальных капч, нестандартных инструкций и ситуаций, где ошибка дороже задержки.

Работник как источник эталонного решения

Правильный ответ является эталоном. Его можно использовать для обучения, тестирования, калибровки уверенности модели и анализа ошибок!

Работник как метрика

Если доля задач, уходящих людям, резко выросла, это сигнал: появился новый тип капчи, изменилась проверка или модель стала хуже работать на определенном сегменте.

Работник как обучение для ИИ в узком контексте

ИИ не нужен «общий интеллект» для решения капчи. ИИ надо узкий, специализированный контекст: какие типы капчи сейчас встречаются, какие ответы считаются правильными, какие ошибки повторяются, какие задачи лучше сразу отправлять человеку.

Почему ИИ нельзя кормить только данными от ИИ

Есть еще одна причина, почему человеческая обратная связь критически важна.

Если модель постоянно учится на синтетических данных или на выводах других моделей, ошибки закрепляются!

Это коллапс модели, когда она теряет связь с реальным распределением данных и хуже понимает редкие случаи. Обучение на данных, многократно произведенных другими моделями, запускает деградацию: модель постепенно забывает истинное распределение, а редкие хвостовые случаи исчезают первыми.

Решение капчи как раз состоит из таких хвостовых случаев:

-

новые виджеты;

-

странные изображения;

-

измененные инструкции;

-

редкие форматы;

-

неожиданные ошибки;

-

нестандартные браузерные сценарии;

-

свежие антибот‑обновления;

-

сложные сочетания IP, страны, браузера и поведения.

Если обучать сервис обхода только на других моделей, система будет становиться более уверенной, но не обязательно более точной. Работник дает модели якорь реальности: не «как ИИ думает, что правильно», а что действительно сработало в реальной задаче.

Главное преимущество не в модели, а данных

Доступ к сильным ИИ‑моделям есть у многих. Поэтому сама модель быстро перестает быть уникальным преимуществом.

Успешный на практике сервис там, где есть собственные данные. Каждое решение работника, каждый неудачный случай, каждый новый тип капчи, каждый исправленный ответ модели формируют закрытый датасет. Его нельзя просто скачать из интернета или купить у конкурента. Он появляется только у сервиса, который каждый день обрабатывает реальные задачи.

В итоге возникло конкурентное преимущество.

Общие модели доступны многим.

Общие датасеты доступны многим.

Конкурентное преимущество смещается от архитектуры нейросетей к качеству датасетов. Сервисы с развитой инфраструктурой ручного распознавания, такие как 2Captcha, аккумулируют уникальные массивы из пограничных случаев. Работа асессоров предотвращает дрейф данных, когда при обновлении виджета старые веса модели перестают работать. Это формирует замкнутый цикл RLHF, недоступный чистым ИИ проектам.

В долгую выигрывает не тот, кто просто подключил большую модель, а тот, кто быстрее превращает человеческие исправления в автоматические навыки ИИ.

Бизнес‑экономика: почему гибрид окупается

Гибридный подход важен и технически и экономически.

Компании в среднем получают 3,7 доллара возврата на каждый доллар инвестиций в генеративный ИИ, а бывает и $10. Суть не в силе модели, а в правильном внедрении ИИ в рабочие процессы, настройке, управлении и измеримых результатах.

Для решения капчи логика такая же.

Чистый ИИ может быть дешевле в моменте. Но если он дает много повторных попыток, неудачных решений и нестабильности, итоговая стоимость результата растет.

Связка «ИИ + работник» дороже на сложных задачах, но дешевле на уровне всего процесса, потому что снижает:

-

число бесполезных повторов;

-

количество потерянных сессий;

-

нагрузку на инфраструктуру;

-

ручную диагностику проблем;

-

риск потери аккаунтов;

-

нестабильность автоматизации;

-

ошибки из‑за неправильного сетевого контекста.

Бизнесу важна не самая дешевая попытка. Бизнесу важен самый надежный результат.

Финальный вывод

ИИ отлично подходит для массовых, повторяемых и дешевых задач. Проблема начинается там, где капча требует не только распознавания, но и контекста: поведения, истории сессии, редкого визуального паттерна, нестандартной логики, IP‑адреса, страны, прокси‑сервера или устойчивости к новым проверкам.

Чистый ИИ в такой среде плох. Связка «ИИ + работник» закрывает проблему.

Гибридная архитектура: модель для скорости, работник для качества, прокси‑серверы для сетевого контекста и данные для постоянного улучшения.

Автор: alex_webfolio