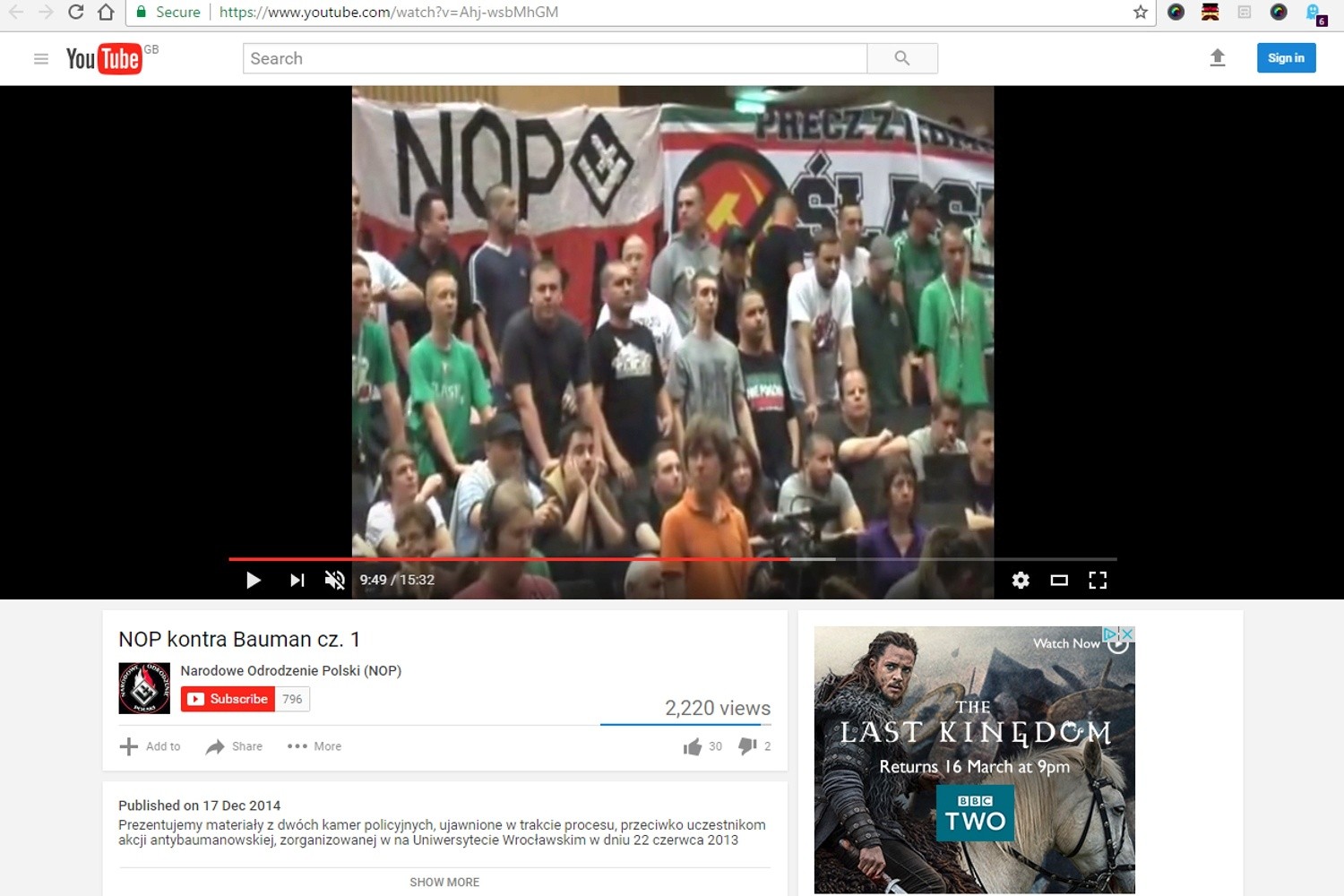

Реклама фильма BBC рядом с видеороликом националистической группировки «Национальное возрождение Польши»

Каждый день сотни людей в разных уголках США (а может и за границей) включают свои компьютеры и начинают смотреть YouTube. Но они делают это не ради удовольствия, совсем наоборот. Людей тошнит от этой работы, но таковы требования временного работодателя, компании Google — они должны просматривать видеоролики, искать ненавистнические выражения в титрах и речи, помечать видео как «оскорбительное» или «деликатное». Всё ради того, чтобы в такие видеоролики, не дай бог, не попала реклама крупного рекламодателя, которого потом загнобят за финансовую поддержку расистов и тому подобные грехи. С этим столкнулись Walmart, PepsiCo и Verizon, среди прочих.

Читать полностью »