Объяснимый ИИ — очень важный аспект в ML и DL. Он заключается в том, чтобы интерпретировать модель так, чтобы можно было около прозрачно объяснить ее решения. Потому что это довольно частая необходимость как у конечного заказчика, ведь для них это просто «черный ящик», так и у разработчиков непосредственно (например, для отладки модели). На русском языке таких статей не так много (для тех, кто знает английский проблем с этим нет, на нем таких статей много, например, Kaggle), поэтому я решил, что статья покажется актуальной, и сегодня я попробую рассказать про это и показать на конкретном примере, как его можно реализовать.

Рубрика «shap»

Фичи в парламент: еще один подход оценить важность признаков в древесных анcамблях

2024-11-23 в 10:51, admin, рубрики: ml, shap, xaiПривет, друзья!

Признаки, которыми орудует модель ИИ, в чём-то похожи на группы лиц, соединяющихся, чтобы сыграть в игру и выйграть максимально много. Этой идеей в задаче оценки важности коэффициентов в модели вдохновлен метод SHAPley values, который объективно обладает рядом хороших свойств. Теперь он не один! Про метод, основанный на идее выборов в парламент в этой статье.

Необходимость

Практическая устойчивость значений Шепли в интерпретации моделей ИИ

2024-10-27 в 10:25, admin, рубрики: explainable ai, shap, shapley valuesПривет!

В исследованиях и на практике значения Шепли (Shapley values) — один из наиболее популярных методов интерпретации. По определению, значения Шепли вычисляются по оценке вклада признака во все возможные "коалиции" (подмножества признаков). Так, если у нас естьпризнаков, нам необходимо перебрать Читать полностью »

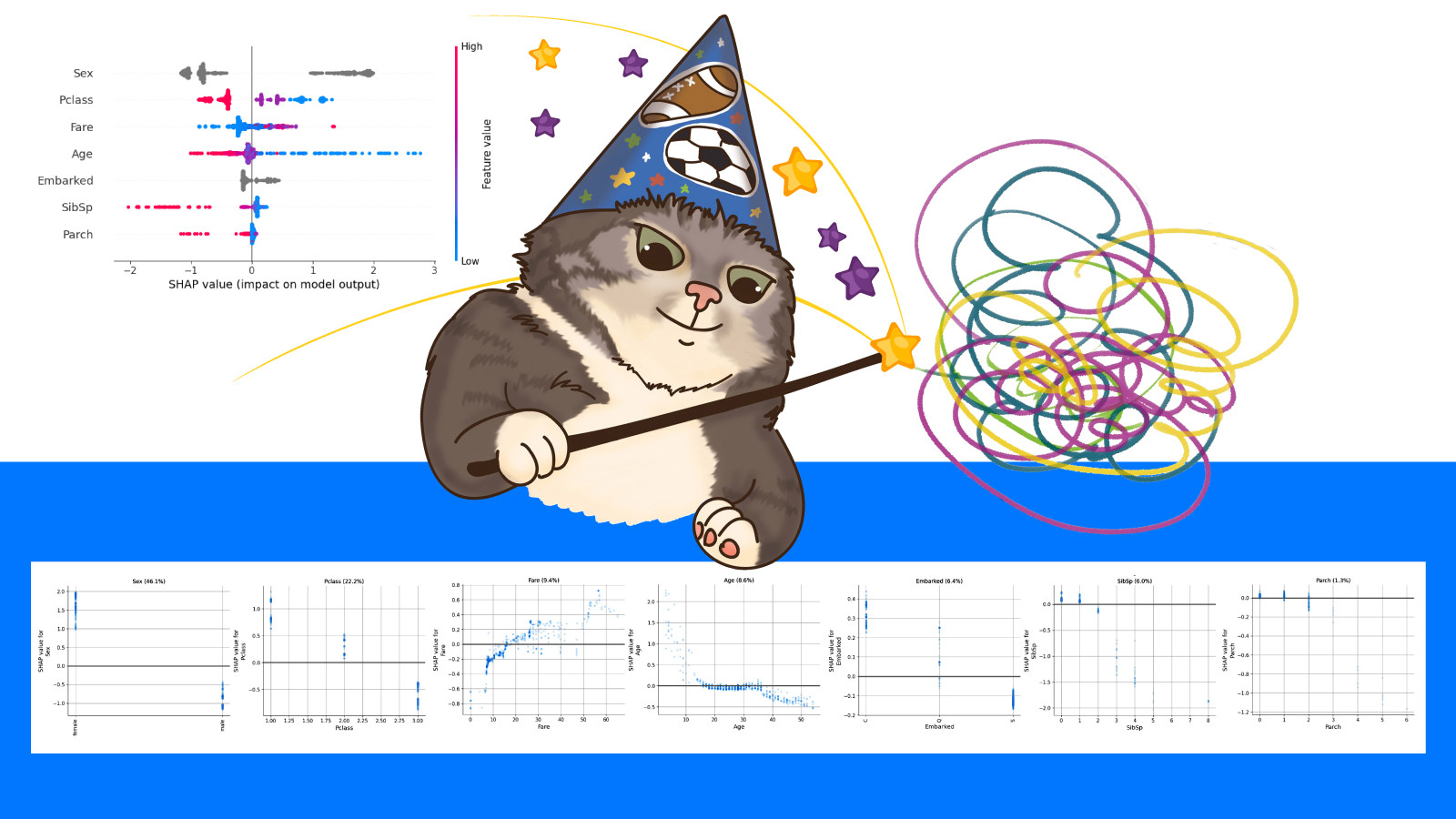

Повышаем интерпретируемость SHAP-графиков

2024-06-07 в 8:41, admin, рубрики: feature importance, ml, shap

Привет! В моей работе часто возникают задачи на исследование влияния факторов, на которые мы можем оказывать продуктовое влияние, на целевые метрики сообществ ВКонтакте. Один из возможных способов решения подобных задач — обучение ML‑моделей и последующий анализ значимости признаков в них. Базовым подходом видится использование графиков из библиотеки Читать полностью »

Как интерпретировать предсказания моделей в SHAP

2018-10-30 в 11:02, admin, рубрики: big data, data science, feature importance, machine learning, shap, машинное обучениеОдной из важнейших задач в сфере data science является не только построение модели, способной делать качественные предсказания, но и умение интерпретировать такие предсказания.

Если мы не просто знаем, что клиент склонен купить товар, но так же понимаем, что влияет на его покупку, мы сможем в будущем выстраивать стратегию компанию, направленную на повышение эффективности продаж.

Читать полностью »