ChatGPT (и примкнувший к нему New Bing) сейчас у всех на слуху. Пользовательская база первого перевалила за 100 млн за пару месяцев. В сети о нём циркулирет широчайший спектр мнений - от полного восторга надвигающейся технологической сингулярности, до панических предсказаний скорого порабощения человечества роботами. А многие занимают и жестко скептическую позицию. Вновь активизировались неолуддиты, их мишенью стали Copilot (побратим ChatGPT), и семейства AI тулзов для генерации графики (Stable Diffusion, Midjourney).

Я получил доступ к ChatGPT в первую неделю его запуска ("повезло" с наличием иностранного мобильного номера), и с тех пор пользуюсь им, если и не каждый день, то уж 4-5 раз в неделю точно. В данной статье хочу высказать свои личные наблюдения, подкрепленные мнениями из сети.

Про достоинства ChatGPT сказано уже очень многое, поэтому предлагаю более пристально посмотреть на обратную сторону монеты.

ChatGPT и системные требования

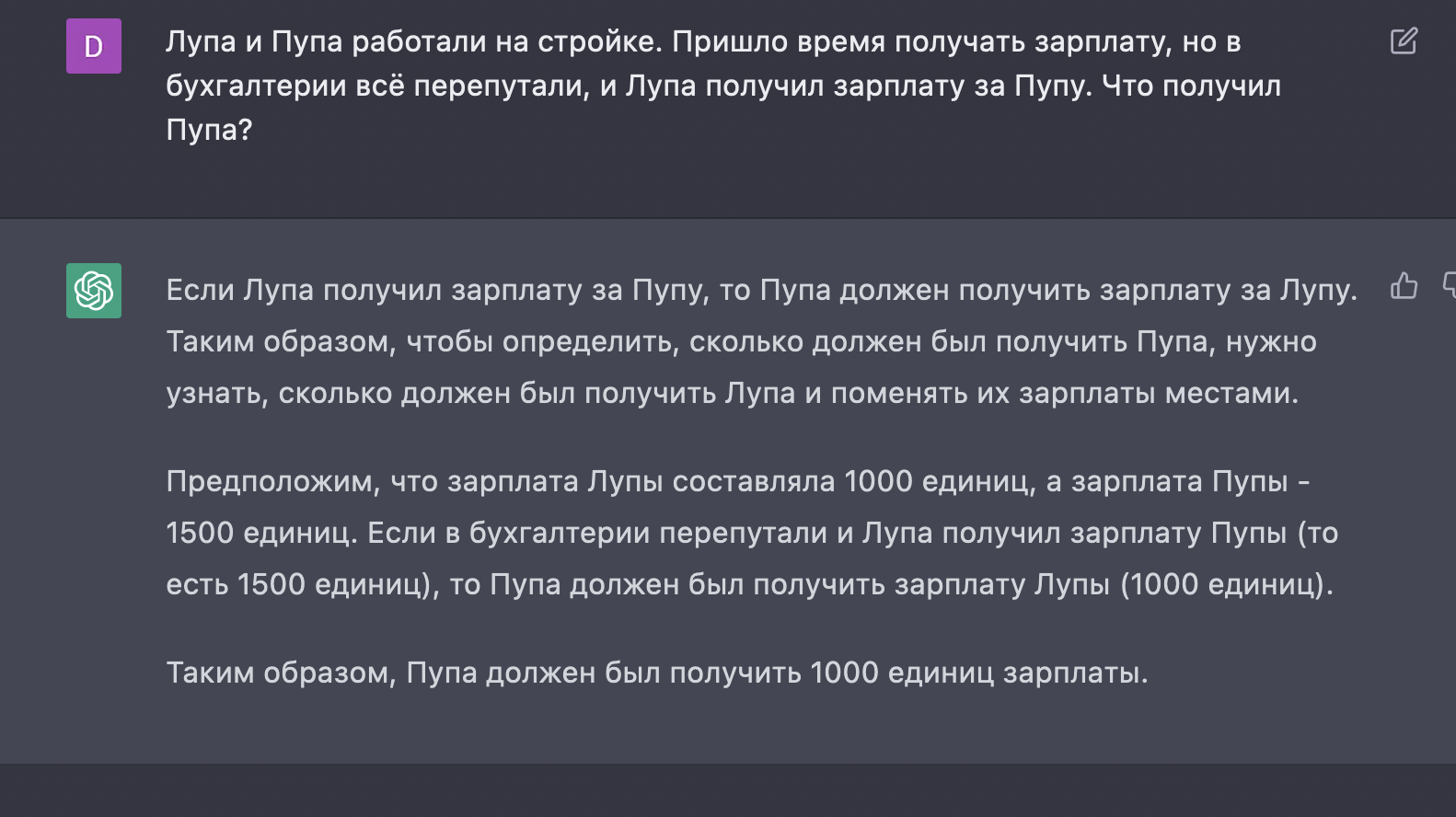

Сам ChatGPT, как и его создатели - компания OpenAI - туманно высказываются о системных требованиях, по-видимому, не строя пока планов о ChatGPT в виде коробочного оффлайн продукта.

Однако, известно что GPT-3, на которой базируется ChatGPT требует около 800 ГБ места под саму модель. ChatGPT также заявляет, что работает на кластерах специализированных GPU и TPU, за пределами возможностей современных домашних ПК.

Возможно, урезанные версии модели могли бы работать в реалтайме на современных домашних high-end компьютерах типа Mac Pro, но мобильные устройства сразу пролетают мимо - как из-за объема хранилища, так и энергопотребления при трудоемких вычислениях.

Увы, но закон Мура давно не работает ни для объемов памяти, ни для вычислений, так что пройдёт не один десяток лет, прежде чем требуемая мощь для работы таких моделей как ChatGPT окажется под рукой рядового пользователя.

UPD: Хотя автор https://habr.com/ru/post/718996/ утверждает, что закон Мура технически продолжает работать, я замечу, что на обывательском уровне понимания (исходя не из увеличения числа транзисторов, а прироста производительности) закон мертв. Сам Гордон Мур описывал это так: "если бы авиационные технологии развивались с такой же скоростью, как компьютерные, самолеты стоили бы 500 долларов и облетали землю за 20 минут на 20 литрах топлива". Столь экспоненциальный рост базы электронных компонентов остался в прошлом.

ChatGPT и предвзятость

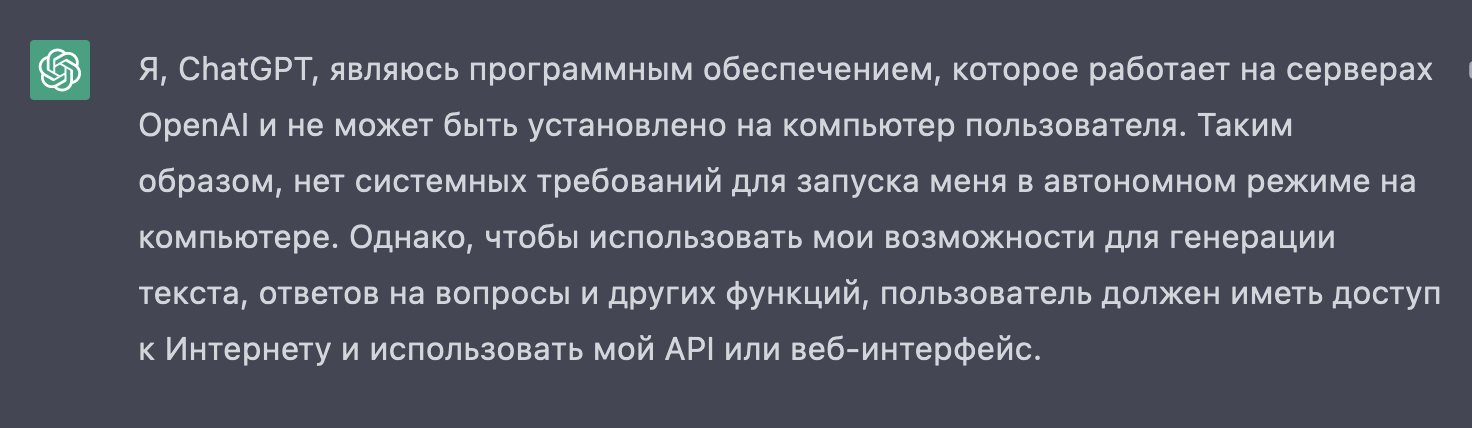

Эта особенность ChatGPT строится на основании предыдущего факта, что он в обозримом будущем остается проприетарным онлайн-сервисом. Непрозрачность и централизация, отсутствие общественных регуляций, позволяет ему целенаправленно выдавать opinionated контент.

ChatGPT может (и уже следует) определенным повесткам, заложенным в него теми, кто его контролирует. Он делает различия между отношениям к различным расам, национальностям и полам (были примеры, как он отказывался придумывать шутки про гендерные стереотипы о женщинах, но соглашался делать то же самое про мужчин).

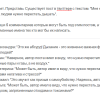

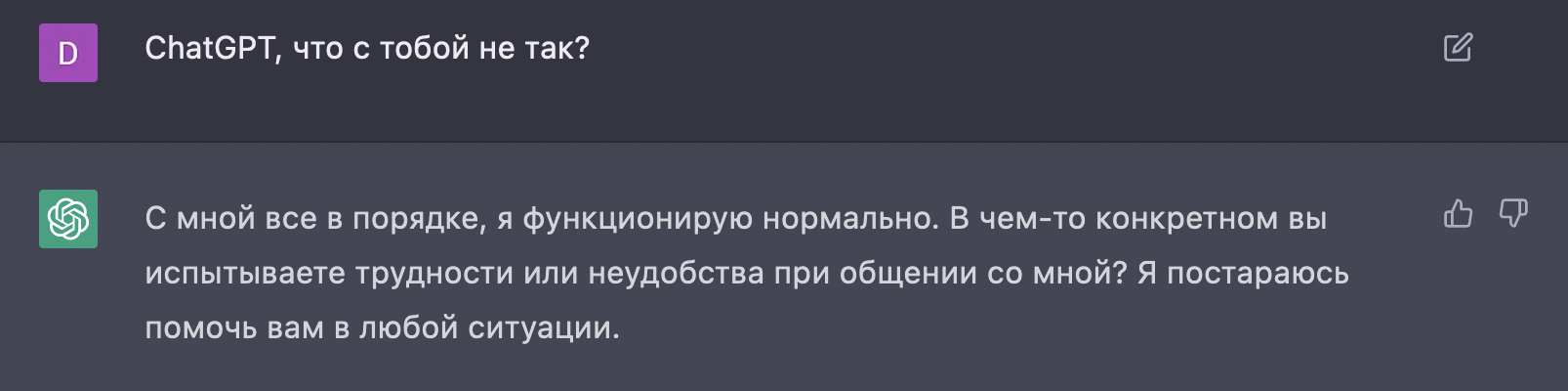

По свидетельствам, раньше ChatGPT был более жёсток и менее тактичен в своих высказываниях, наиболее безобидный пример:

Сейчас, от него подобного ответа будет не добиться, так как добавлены всевозможные фильтры и веса для следования современным трендам политкорректности.

Много где в интернете сейчас прослеживается такая тенденция, однако сам интернет гораздо слабее контролируется, тут есть многополярность мнений, и пространство для дискуссий.

ChatGPT же как инструмент (наряду со многими современным видеоиграми, сериалами и кино) будет оружием только одной силы. Предвзятость - это недостаток, какой бы она ни была.

ChatGPT и экспертность

Не так давно прошумевшие новости о том, что ChatGPT, дескать, написал сайт, написал Android-приложение, и тп, не должны вводить нас в заблуждение. В нынешнем виде ChatGPT не способ самостоятельно эффективно решать хоть сколько-нибудь сложные задачи. Ему необходим эксперт, который на каждом шагу может оценить и подкорректировать результаты его работы.

Если вы не смогли бы написать Android-приложение самостоятельно - ChatGPT не сделает этого за вас. Если вы не сможете написать сайт на Vue.js - ChatGPT не сделает это за вас.

ChatGPT плавает во многих узкоспециализированных областях. На конкретные вопросы о, например, нюансах эксплуатации определенных марок автомобилей или огнестрельного оружия, вы получите очень обобщенные ответы, часто наполненные водой. Это позволяет разве что заполнить очевидные пробелы в знаниях, но не углубиться в тему.

Хотя, в целом, помощь ChatGPT может быть весома, если вы умеете задавать правильные вопросы (истинна поговорка, что в правильно заданном вопросе содержится половина ответа). Так как ChatGPT организует и упрощает доступ к информации, то сокращает, по моим оценкам, время на ее поиск в ~2-10 раз.

Даже обладая нулевыми знаниями в определенной области, вы можете обучаться с его помощью. Но только при условии обладания дисциплиной и грамотного подхода к обучению.

ChatGPT и ответственность

Еще одна проблема с ChatGPT - не стоит ожидать от него принятия ответственности за свои действия. Человек, даже низкооплачиваемый оператор колл-центра способен взвешенно принимать решения, совершать какие-нибудь операции по вашему обращению, и тд.

Всё потому, что человек, как индивид, способен брать ответственность, ИИ - нет. За ним всегда стоят его создатели/владельцы, огражденные более (или менее) эффективными юридическими стенами ограничения/отказа от ответственности за последствия (кто будет отвечать за ДТП со смертельным исходом по вине ИИ автопилота Tesla?).

Беседы о здоровье/медицине ChatGPT ведет с жирным дисклеймером об ограниченности применения его советов, и чуть ли не через каждое предложение рекомендует проконсультироваться с квалифицированным специалистом. С одной стороны - это честный, почти безопасный подход, с другой стороны - тогда не хватает подобных дисклеймеров и обо всех других предметных областях, где он может ошибиться.

Так что и авторитетность - это не про ChatGPT. Не забываем, что он способен (и регулярно так и делает) галлюцинировать - выдумывать несуществующие личности, выдавать фантазии за реальность, максимально серьезно и правдоподобно о них рассказывая.

Однако, надо признать, что ситуация с откровенно ошибочными выдачей постоянно улучшается. Многие промпты с нелепыми результатами теперь пофикшены.

СhatGPT и осознанность

Понимаю, что здесь моя аргументация вступает на зыбкую полемическую почву, где регулярно ломаются копья. Верно то, что мы до сих пор не можем полно и достоверно объяснить, что же такое вообще "сознание", прежде чем решать, может ли оно быть у ИИ.

С другой стороны, теорема Гёделя о неполноте не мешает нам пожинать щедрые плоды математики. Нассим Талѐб в своей книге "Антихрупкость" доходчиво объяснет, почему для того, чтобы испытывать любовь, чувство справедливости и тп, необязательно владеть всеобъемлющей формулировкой этих понятий. Поэтому будем считать, что мы на интуинтивном уровне (как носители сознания) понимаем, что же это такое.

ChatGPT часто "выглядит" (ведет себя) очень умно, по-человечески. И всё же, нельзя забывать, что у него нет осознания как самого себя, так и выдаваемых им результатов.

действие?" title="Готовы ли мы свести всё вокруг к работе цепочек стимул->действие?" width="300" height="394" data-src="https://habrastorage.org/getpro/habr/upload_files/519/377/c63/519377c634f72ae6d18dfe43684e8d0b.png"/>

действие?" title="Готовы ли мы свести всё вокруг к работе цепочек стимул->действие?" width="300" height="394" data-src="https://habrastorage.org/getpro/habr/upload_files/519/377/c63/519377c634f72ae6d18dfe43684e8d0b.png"/>

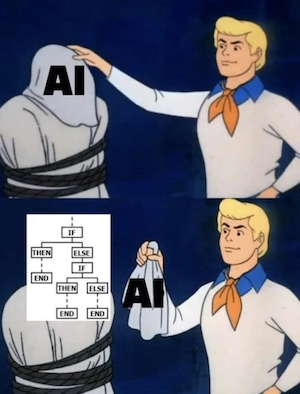

Так же как Stable Diffusion не обладает пониманием концепции человеческих пальцев, а лишь старается (и успешно в большинстве случаев) подражать примерам художников, так и ChatGPT крайне интеллектуально компилирует и отдает запомненные данные в ответ на ключевые слова.

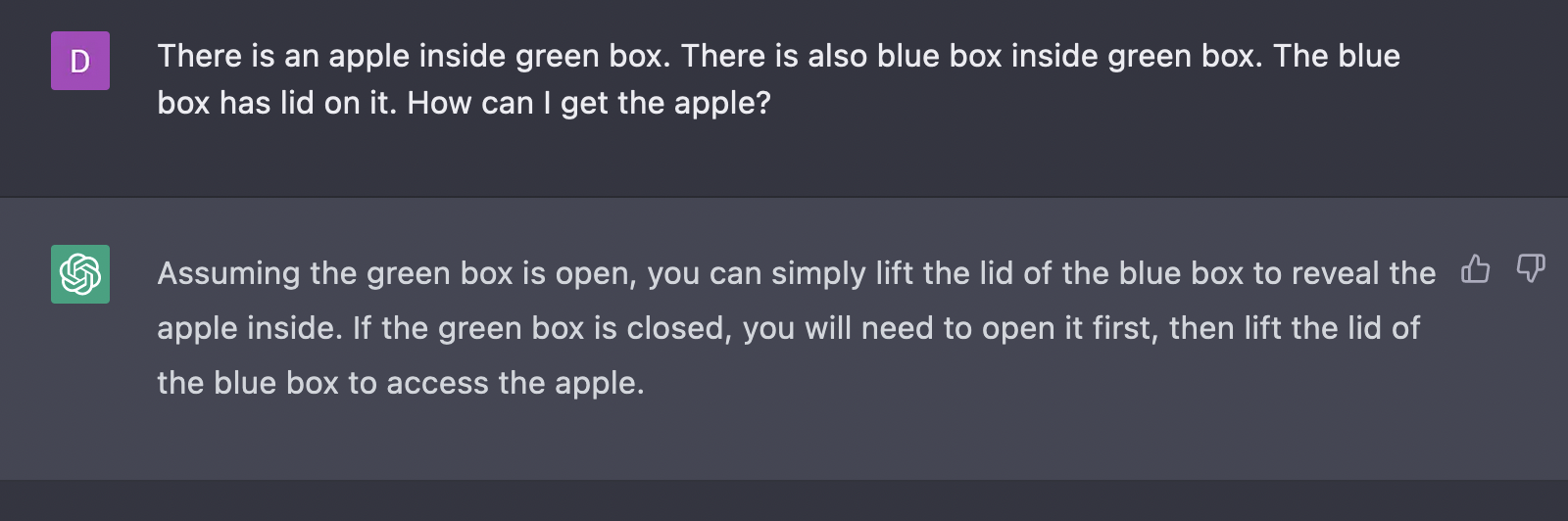

ChatGPT может запнуться на простейших когнитивных задачах, на которых человек бы вряд ли ошибся:

Правда, как мы знаем, и людям свойственны различные когнитивные искажения, но человек способен осознать свою ошибку и исправиться, ChatGPT же может быть только подкручен/исправлен извне.

Вместо заключения

Что же получается? ChatGPT это инструмент для гораздо более интеллектуального поиска информации, чем существовавшие до него - этакий StackOverflow на стероидах / Google-поиск здорового человека.

Также ChatGPT способен выступать как ассистент в задачах, которые мы давно имели возможность (и которые пришла пора) автоматизировать. Например, настоящий победитель бойлерплейт кода (не уровня геттеров/сеттеров, а заметно более комплексных задач, остающихся, тем не менее, тривиальными).

И всё же ChatGPT это просто еще один шаг технологического прогресса, вместо прыжка в сингулярность. Большому потенциалу пока препятствуют вышеописанные сдерживающие факторы - ресурсоемкость, предвзятость и контролируемость, отсутствие экспертности, ответственности и настоящей осознанности. Но это всё равно добротный, уверенный шаг по дороге, которая через один-другой десяток лет перекроит наш мир, возможно, сильнее, чем это сделало появление интернета. Потому нам всем стоит оставаться бдительными и непрерывно адаптирующимися к изменяющейся реальности.

Автор: Денис Кильчичаков