Иногда инцидент начинается не с 5xx и не с красного графика

Он начинается с одной стойки

И с одного таймаута

09:12 - alert: db-replica-02 connection timeout

HAProxy зелёный

HTTP 5xx = 0.2%

p50 = 38–42ms

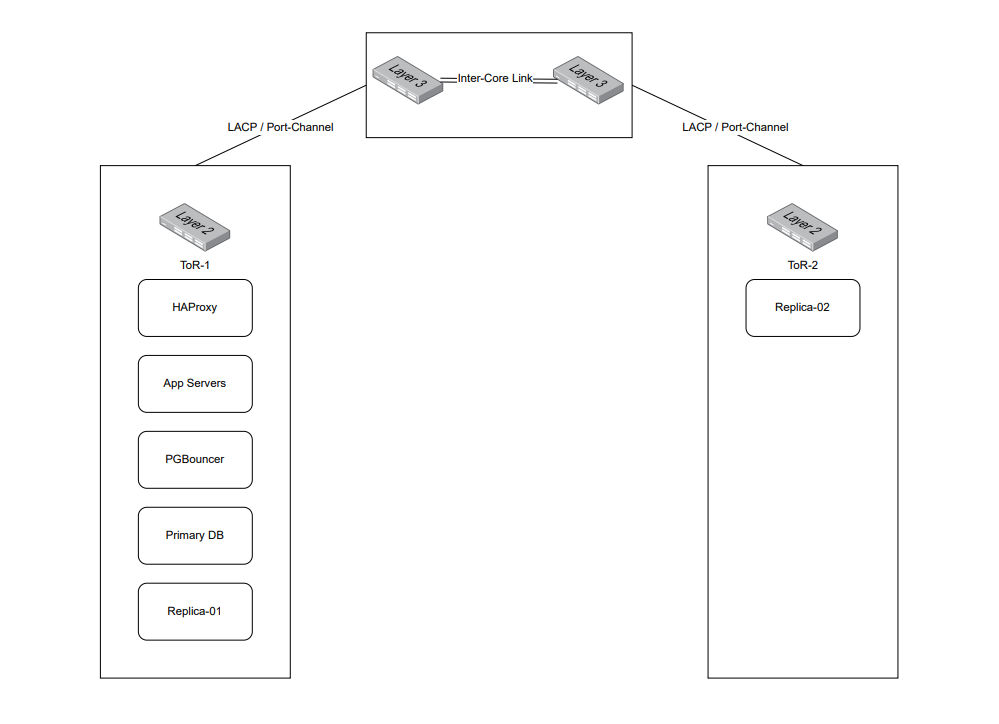

2 стойки

В каждом свой ToR

Primary и app в rack-1

Replica-01 в rack-1

Replica-02 в rack-2