Обзор и тестирование флеш хранилища от IBM FlashSystem 900. Фото, базовые принципы и немного синтетических тестов внутри.

Рубрика «IOPS» - 2

Обзор системы хранения IBM FlashSystem 900

2015-12-31 в 8:15, admin, рубрики: all-flash, IBM, IOPS, виртуализация, ит-инфраструктура, Серверное администрированиеФайловая система Linux полностью на tmpfs — скорость без компромиссов

2015-03-23 в 9:22, admin, рубрики: fio, IOPS, latency, linux, tmpfs, высокая производительность, Настройка Linux, рамдиск, скорость работы, метки: LinuxПредыстория

Так сложилось, что уже пять лет мой раздел ntfs с операционной системой Windows располагается на рамдиске. Решено это не аппаратным, а чисто программным способом, доступным на любом ПК с достаточным количеством оперативной памяти: рамдиск создается средствами загрузчика grub4dos, а Windows распознаёт его при помощи драйвера firadisk.

Однако до недавнего времени мне не был известен способ, как реализовать подобное для Linux. Нет, безусловно, существует огромное количество линуксовых LiveCD, загружающихся в память при помощи опций ядра toram, copy2ram и т. д., однако это не совсем то. Во-первых, это сжатые файловые системы, обычно squashfs, поэтому любое чтение с них сопровождается накладными расходами на распаковку, что вредит производительности. Во-вторых, это достаточно сложная каскадная система монтирования (так как squashfs — рид-онли система, а для функционирования ОС нужна запись), а мне хотелось по возможности простого способа, которым можно «вот так взять и превратить» любой установленный на жесткий диск Linux в загружаемый целиком в RAM.

Ниже я опишу такой способ, который был с успехом опробован. Для опытов был взят самый заслуженный дистрибутив Linux — Debian.

Читать полностью »

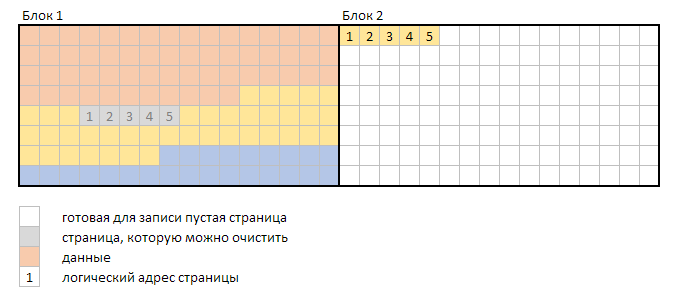

Почему по мере заполнения SSD падает скорость записи в RAID

2014-11-03 в 16:58, admin, рубрики: IOPS, raid, ssd, trim, Серверное администрирование, системное администрирование, хранение данныхЭта проблема наиболее актуальна для аппаратных RAID или firmware RAID (таких как Intel RST RAID 1/10/5/6) с непромышленными SSD.

Особенность SSD

SSD пишут и читают данные страницами, записать можно только на очищенные страницы, а очистить страницы можно только большими блоками. Например, у диска размер страницы 8 КБ, в блоке находится 128 страниц, таким образом, размер блока — 1024 КБ (здесь и далее, если не указано иного, КБ и МБ двоичные).

Например, если изменить 40 КБ в одном файле, то на физическом уровне это будет выглядеть так:

Меряем производительность накопителей или снова про IOPS

2013-02-08 в 5:02, admin, рубрики: disk performance, fio, hdd, IOPS, linux, performance tests, ssd, дисковая подсистема, Серверная оптимизация, системное администрирование, метки: disk performance, fio, hdd, IOPS, performance tests, ssd, бенчмаркинг, дисковая подсистемаНавеяно постом уважаемого amarao о том, как надо измерять производительность дисков.

Цель:

Протестировать производительность имеющихся в наличии средств хранения информации и убедиться в верности выбранной методики, а также понять разницу в производительности между разными видами накопителей, а также enterprise-level и consumer-level жёсткими дисками.

Оборудование:

- SD-карта Sandisk Class 10 UHS 1 Extreme Pro 8 GB (до 95 Мбайт/с чтение, до 90 Мбайт/с запись)

- SD-карта Team Class 10 32 GB (до 20 Мбайт/с)

- SD-карта Transcend 2GB без класса скорости

- SATA-диск consumer-level Hitachi Deskstar HDS723020BLA642 2 ТБ 7200 об/мин, 64 Мбайт

- SATA-диск enterprise-level Western Digital RE3 WD2502ABYS-23B7A0 250 GB 7200 об/мин 16 Мбайт

- SATA-диск consumer-level Seagate Barracuda 7200.11 ST3320613AS 320 GB 7200 об/мин 16 Mбайт

- CD-ROM

- RAM-диск /dev/ram в Linux

Методика тестирования:

Методика полностью описана в посте. Есть правда несколько не совсем понятных моментов:

Мы подбираем такую глубину параллельности операций, чтобы latency оставалось в разумных пределах.

Задача подобрать такой iodepth, чтобы avg.latency была меньше 10мс.

Так как в тестировании используется не СХД и не диски SAS, а различные накопители SATA, то параллельность нам измерять нету смысла.

Очищать диск перед каждым тестированием (dd if=/dev/zero of=/dev/sdz bs=2M oflag=direct) очень времязатратно, поэтому будет это делать перед тестированием один раз на каждый накопитель.

Тестировать весь диск полностью очень времязатратно, поэтому будем использовать тестирование в течении 30 секунд.

Итак, сформулируем методику тестирования для нашего случая:

Получить значение IOPS, выдаваемое накопителем при произвольном чтении и записи блоками по 4 Кбайт и задержке avg.latency не более 10 мс за время теста в 30 секунд. Также для полноты картины измерим скорость линейной записи.Читать полностью »

Измеряем производительность «облачных» дисков — спасаем MySQL

2013-01-09 в 14:10, admin, рубрики: amazon, ebs, IOPS, Блог компании 1С-Битрикс, Веб-разработка, системное администрирование, метки: amazon, ebs, IOPS, веб-кластерВ последнее время в облачных средах и хостингах все чаще стали попадаться «виртуальные» жесткие диски. Техническая служба хостера может заверять, что «виртуальный» диск — быстрый, как десяток рейдов 10 (рейд 100 ;-) ) и держит сотни, а то и тысячи IOPS – однако MySQL заметно для клиентов тормозит. А как это доказать хостеру?

Проблема в том, что измерить «скорость» виртуального жесткого диска изнутри виртуальной машины – непросто, т.к. неясно, что мерить в первую очередь, чем и зачем ;-) А сделать это нужно, чтобы убедить администраторов виртуальной конфигурации, что дело не в приложении и настройках MySQL. И нужно было, как говориться, просто «помыть руки» перед чтением мануала к хранилищу.

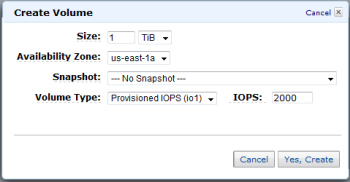

В статье я проиллюстрирую простую методику нахождения «точки опрокидывания» производительности виртуального жесткого диска, с использованием доступных в дистрибутивах инструментов – sysbench и iostat. Также мы измерим «точку опрокидывания» известных своей тормознутостью виртуальных дисков EBS от Амазона – как обычных EBS, так и Provisioned IOPS EBS (1000 и 2000 IOPS).

Читать полностью »

IOPS — что это такое, и как его считать

2012-12-29 в 4:35, admin, рубрики: IOPS, raid, ит-инфраструктура, метки: IOPS, raid  IOPS (количество операций ввода/вывода – от англ. Input/Output Operations Per Second) – один из ключевых параметров при измерении производительности систем хранения данных, жестких дисков (НЖМД), твердотельных диски (SSD) и сетевых хранилища данных (SAN).

IOPS (количество операций ввода/вывода – от англ. Input/Output Operations Per Second) – один из ключевых параметров при измерении производительности систем хранения данных, жестких дисков (НЖМД), твердотельных диски (SSD) и сетевых хранилища данных (SAN).

По сути, IOPS это количество блоков, которое успевает считаться или записаться на носитель. Чем больше размер блока, тем меньше кусков, из которых состоит файл, и тем меньше будет IOPS, так как на чтение куска большего размера будет затрачиваться больше времени.

Значит, для определения IOPS надо знать скорость и размер блока при операции чтения / записи. Параметр IOPS равен скорости, деленной на размер блока при выполнении операции.

Читать полностью »

AWS: Больше IOPS для EBS

2012-11-02 в 9:56, admin, рубрики: Amazon Web Services, AWS, ebs, IOPS, Блог компании EPAM Systems Ukraine, метки: aws, ebs, IOPS Доброго времени суток!

Сегодня стала известна ещё одна хорошая новость от Amazon Web Services: теперь каждый EBS-диск обеспечивает производительность в 2000 IOPS (это в два раза больше предыдущего лимита в 1000 IOPS).

Если производительности диска в 2000 IOPS Вам мало, то EBS-диски можно объединить в RAID-массив, получив тем самым необходимое количество операций ввода/вывода.

AWS: CloudFormation теперь поддерживает параметр-группы RDS и ускоренные носители EBS и RDS

2012-10-16 в 13:06, admin, рубрики: Amazon Web Services, AWS, cloudformation, ebs, IOPS, RDS, Блог компании EPAM Systems Ukraine, метки: aws, cloudformation, ebs, IOPS, RDS Привет читатели!

С сегодняшнего дня в описании шаблонов AWS CloudFormation появились параметры, позволяющие настраивать как последние новшества от Amazon, так и уже очень древние фичи, которые сообщество просило включить очень давно.

Параметр-группы RDS.

Все RDS серверы можно поднять со стандартными настройками. Но рут доступа к серверам нет, поэтому невозможно, например, включить возможность хранения процедур в RDS MySQL. Для этого и существуют параметр-группы, которые могут быть созданы и настроены через API или CLI.

Читать полностью »

Как правильно мерять производительность диска

2012-10-11 в 10:10, admin, рубрики: disk performance, fio, hdd, IOPS, linux, NAS, performance tests, SAN, ssd, дисковая подсистема, Серверная оптимизация, системное администрирование, СХД, метки: disk performance, fio, hdd, IOPS, NAS, performance tests, SAN, ssd, бенчмаркинг, дисковая подсистема, СХДabstract: разница между текущей производительностью и производительностью теоретической; latency и IOPS, понятие независимости дисковой нагрузки; подготовка тестирования; типовые параметры тестирования; практическое copypaste howto.

Предупреждение: много букв, долго читать.

Лирика

Очень частой проблемой, является попытка понять «насколько быстрый сервер?» Среди всех тестов наиболее жалко выглядят попытки оценить производительность дисковой подсистемы. Вот ужасы, которые я видел в своей жизни:

- научная публикация, в которой скорость кластерной FS оценивали с помощью dd (и включенным файловым кешем, то есть без опции direct)

- использование bonnie++

- использование iozone

- использование пачки cp с измерениема времени выполнения

- использование iometer с dynamo на 64-битных системах

Это всё совершенно ошибочные методы. Дальше я разберу более тонкие ошибки измерения, но в отношении этих тестов могу сказать только одно — выкиньте и не используйте.

Правильный расчет для VDI (часть 2)

2012-09-03 в 9:26, admin, рубрики: IOPS, raid, vdi, windows, Блог компании HP, виртуализация, виртуальная машина, индексация, оптимизация, сервер, Серверная оптимизация, система хранения данных, метки: IOPS, raid, vdi, windows, виртуализация, виртуальная машина, индексация, оптимизация, сервер, система хранения данныхЭто продолжение серии из двух постов, в которых я рассказываю о построении VDI-решения для крупной российской софтверной компании.

Немного математики

Опираясь на описанную в предыдущем посте теорию, проведем расчеты:

Одновременно от 6 до 9 пользователей VDI могут использовать одно физическое ядро CPU. Для упрощения возьмем среднюю цифру — 7 пользователей.

Согласно требованиям заказчика необходимо обеспечить работу 700 пользователей по VDI с расширением до 1000.

Читать полностью »