Все мы проходили через это: скармливаешь RAG‑системе сложный PDF на 50 страниц, а она в ответ либо галлюцинирует, либо вываливает на LLM простыню нерелевантного текста, съедая ваш бюджет на токены быстрее, чем вы успеваете сказать «GPT-4o». Проблема в том, что классический подход со статическим top_k — это костыль, который либо не додает контекста, либо вызывает у модели информационное «ожирение» (заполняет контекст нерелевантным мусором). Нашему RAG нужно помочь адаптироваться к безжалостной среде разрозненных документов!

Рубрика «retrieval augmented generation»

Как помочь вашему RAG адаптироваться? Принимайте DRAG with KNEE! Часть 1

2026-03-29 в 6:22, admin, рубрики: hierarchical structure, knee, optimization, rag, retrieval augmented generationRAG на PHP + Qdrant: быстрый MVP для внутренней базы знаний

2026-02-18 в 19:17, admin, рубрики: llm, neuron, php, qdrant, rag, rag pipeline, retrieval augmented generation, yandexgptВ этой статье покажу, как мы собрали RAG-систему на PHP и Qdrant: выбрали векторную базу и LLM, настроили гибридный поиск и реализовали чат-бота на Symfony с использованием PHP фреймворка Neuron AI.

К нам обратился клиент с задачей: сделать чат-бота для поиска информации по внутренней базе знаний (статьи, документация, корпоративные тексты). Главное требование - быстро собрать MVP, чтобы проверить гипотезу и принять решение о дальнейшем развитии системы. Первую версию запустили, получаем хорошие отзывы от пользователей, поэтому решил поделиться и, возможно, получить полезную обратную связь от сообщества.

Стек и компоненты

RAG и векторные БД: НЕ Сизифов LLM на Java и Spring Ai

2025-08-28 в 14:29, admin, рубрики: java, large language model, open AI, qdrant, retrieval augmented generation, ruvds_статьи, semantic search, spring ai, vector database, исскуственный интеллектПривет! Меня зовут Бромбин Андрей, и сегодня я разберу на практике, что такое RAG-системы и как они помогают улучшать поиск. Покажу, как использовать Spring AI, векторные базы данных и LLM. Ты получишь теорию и пример реализации на Java и Spring Boot — от идеи до работающего сервиса. Без сложных формул — только чёткие объяснения и код.

Свой ChatGPT на документах: делаем RAG с нуля

2025-07-13 в 10:08, admin, рубрики: ai agent, ai app, ai application, llama 3.3 70B, rag, rag ai, rag pipeline, retrieval augmented generation, ии агент, ии приложениеВсем привет! Наверняка у вас были ситуации, когда нужно быстро найти что-то в длинном документе-договоре, инструкции или отчёте. Сегодня я покажу, как сделать своего помощника, который будет отвечать на такие вопросы автоматически. Соберем RAG с нуля: загрузим документы, "нарежем" их на куски, проиндексируем в Qdrant и подключим LLaMA через Amvera Inference.

Если вы увидели незнакомые слова — не пугайтесь, далее я расскажу об этом подробно.

Самое главное, что всё это работает самостоятельно, без зависимости от OpenAI.

RAG - что это?

Часть 4. Обзор технологий RAG для LLM: аугментация извлеченных данных

2025-05-16 в 20:29, admin, рубрики: llm, llm-агент, llm-архитектура, llm-модели, llm-приложения, rag, rag pipeline, retrieval, retrieval augmented generation, языковые моделиПродолжаю адаптированный перевод статьи китайских исследователей Retrieval-Augmented Generation for Large Language Models: A Survey (ссылка на первую часть — здесь, на вторую часть — здесь, третью часть — здесь). В этой, четвертой части авторы совсем скромненько, словно тренировались заполнять налоговую декларацию, разбирают технологии аугментации извлеченных данных.

Обзор техник RAG: Retrieval Augmented Generation

2025-04-24 в 11:15, admin, рубрики: deeplearning, DL, large language model, llm, machinelearning, ml, natural language processing, nlp, rag, retrieval augmented generationРассмотрим техники построения и улучшения RAG систем: от нарезания текстов на куски, до продвинутых способов улучшения качества ответа.

Этим блогом можно пользоваться как шпаргалкой для проектирования своего RAG-а и/или для подготовки к собеседованиям.

Все полезные ссылки и материалы, на которые я опирался будут в конце.

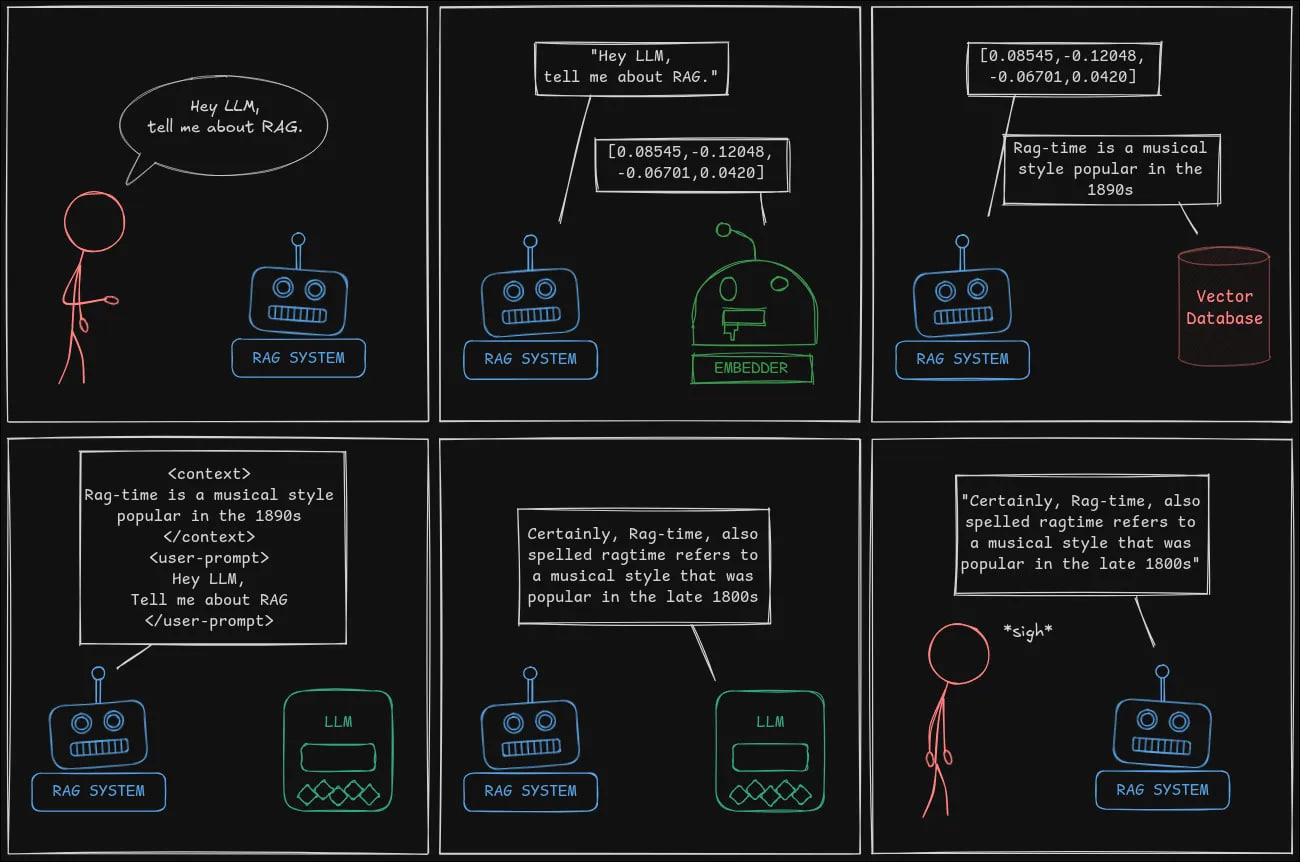

Что такое RAG и зачем нужен

RAG - это фреймворк взаимодействия предобученной LLM с базой знаний. То есть при ответе LLM на запрос пользователя модель отвечает используя актуальный контекст из базы и свои pre-trained знания.

Как я победил в RAG Challenge: от нуля до SoTA за один конкурс

2025-03-22 в 11:54, admin, рубрики: chatgpt, Docling, faiss, gpt, llm, question answering, rag, retrieval augmented generation, векторный поиск, парсинг PDF

Предисловие

В этом посте я расскажу про подход, благодаря которому я занял первое место в обеих призовых номинациях и в общем SotA рейтинге.

Памятка по RAG

RAG - это инструмент, расширяющий возможности LLM через “подключение” к ней базы знаний любого размера.

Путь разработки базовой RAG системы состоит из этапов:

«Гараж» как инкубатор инноваций и л̶о̶г̶о̶в̶о S̶k̶y̶n̶e̶t

2024-12-17 в 11:30, admin, рубрики: chatgpt, codellm, genai, localai, Ollama, OpenAI, rag, retrieval augmented generation, techradar, WhisperПривет, Хабровчане!

Меня зовут Андрей Беляев, и я занимаюсь расширением возможностей организаций, внедряя ИИ-помощников.

Сегодня я расскажу, как наша R&D-лаборатория, «лампово» называемая «Гараж», исследовала потенциал больших языковых моделей, проверяла бизнес-гипотезы и технические решения и в итоге запустила процесс создания корпоративной экосистемы GenAI, а также технологической платформы в ее основе.

Hippo-RAG: Долговременная память для LLM, вдохновленная нейробиологией

2024-11-22 в 5:00, admin, рубрики: llm, machine learning, natural language processing, rag, retrieval, retrieval augmented generation, transformer, TransformersУченые часто вдохновляется нашими или животными биологическими структурами: CNN, MLP, Backprop, и для многих других исследований можно найти сходства в реальном мире. Недавно вышла статья, которая делает то же самое, но для RAG (Retrieval-Augmented Generation). В некотором роде, это недостающая современным LLM долгосрочная память. Это понятно, а причем тут неокортекст, гиппокамп и другие сложные слова? Давайте посмотрим.