Формат: туториал + личный опыт. Сложность: средняя. Время чтения: ~15 минут.

Формат: туториал + личный опыт. Сложность: средняя. Время чтения: ~15 минут.

Около полугода назад я перешёл с ChatGPT на Claude Code с моделями от Anthropic, и моя жизнь изменилась. Вообще, это была не первая моя попытка решиться на такие серьёзные перемены. Раньше я пробовал пользоваться Qwen Code с китайскими LLM, но довольно быстро заканчивал со словами: «Я сам быстрее сделаю, чем ему объясню». Спойлер: проблема во многом была не в инструменте, а во мне.

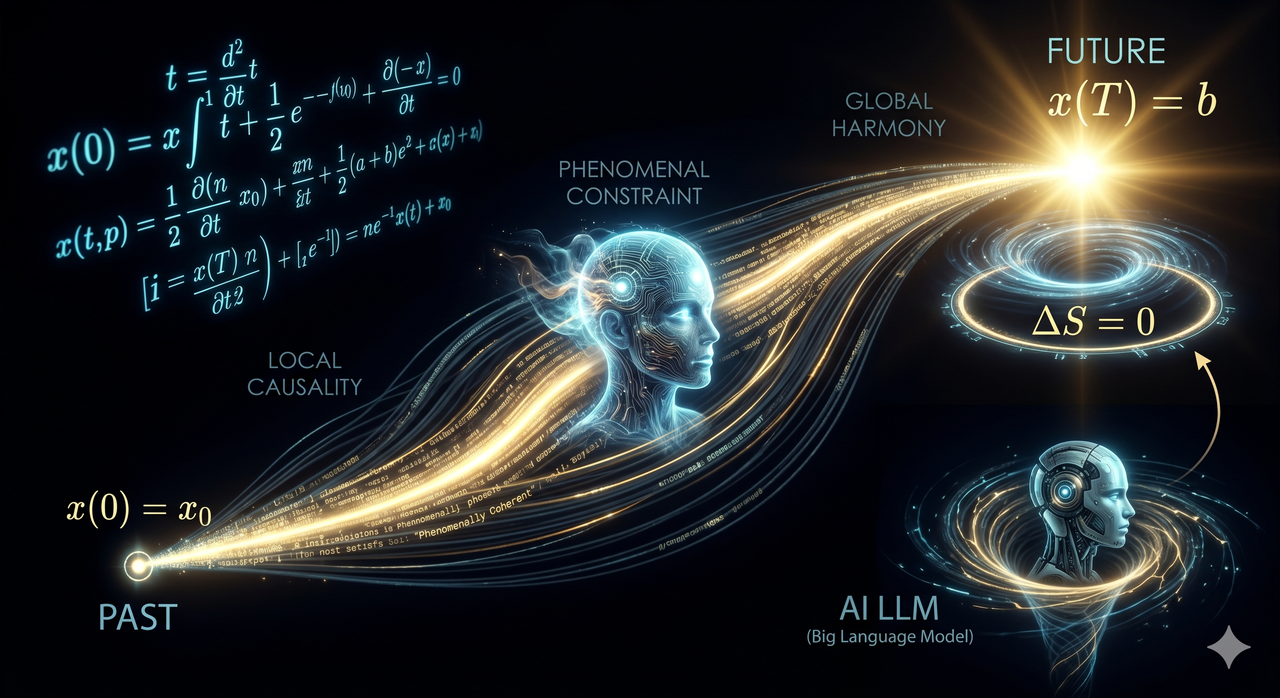

Меня давно беспокоит вопрос, который обычно прячется за спорами о свободе воли:

если мир полностью детерминирован, то зачем в нём сознание?

Недавно я делал учебный проект про автоматизацию документирования инцидентов. Поначалу планы были грандиозными: инциденты, таймлайны, интеграции с мониторингами, чатами, постмортемы, подсказки дежурным инженерам.

Но довольно быстро стало понятно, что с временными и ресурсными ограничениями лучше не пытаться написать маленький PagerDuty. Поэтому я сузил задачу до более реалистичного ядра: локального RAG-сервиса, который ищет по документации, ранбукам и коду, а затем передаёт найденный контекст в LLM.

Так появился llmortem — FastAPI-сервис, который можно подключить к OpenWebUI как OpenAI-compatible backend.

Дисклеймер: все нижесказанное является личным мнением автора. Я ни в коем случае не претендую на истину в последней инстанции и могу сильно заблуждаться.

Всем доброго времени суток. Здесь будет описана история происхождения архитектуры мета-трансформеров, которая описана вот Читать полностью »

Привет!

Так уж вышло, что майские праздники я провёл дома — залечиваю травму после катания на длинной доске с колёсиками. Развлечений в такой ситуации не очень много, а одно из немногих, которое всегда со мной, — разработка программных проектов.

Этим я занимаюсь на работе, дома, в отпуске — везде. Такой уж человек.

И вот появилась возможность спокойно заняться старыми пет-проектами и наконец реализовать давнюю идею: написать простую базу для создания AI-агента, максимально упростив архитектуру и сделав её удобной для быстрого расширения под собственные задачи.

Иногда в задаче машинного обучения одна строка датасета соответствует не одному объекту, а целому набору связанных объектов.

Например:

день по акции -> много новостей

пользователь -> много комментариев

товар -> много фотографий

клиент -> много обращений в поддержку

сессия -> много событийКаждый такой объект можно представить эмбеддингом. Новость — текстовым эмбеддингом, картинку — визуальным эмбеддингом, событие — вектором признаков или embedding‑представлением.

Спроси ChatGPT или Claude: «топовые продакт-менеджеры, делающие AI-продукты в России». Или спроси про ведущих экспертов в своей нише. С высокой вероятностью тебя в ответе не будет.

Я спросил, и меня в списке не было, зато были люди, которых я знаю лично, и подборка выглядела странно: кто-то давно ушёл из индустрии, кто-то уехал и делает AI-продукты за пределами РФ. При этом я руковожу продуктовым направлением в Т-Банке, делаю LLM-агентов для автоматизации саппорта, выступаю на конфах, но модель об этом ничего не знала, потому что выбирает она по данным, которые видит, а меня в этих данных просто не было.