Введение

Понимание того, как классификатор разбивает исходное многомерное пространство признаков на множество целевых классов, является важным шагом для анализа любой задачи классификации и оценки решения, полученного с помощью машинного обучения.

Современные подходы к визуализации решений классификаторов в основном либо используют диаграммы рассеивания, которые могут отображать лишь проекции исходных обучающих выборок, но явно не показывают фактические границы принятия решений, либо используют внутреннее устройство классификатора (например kNN, SVM, Logistic Regression) для которых легко построить геометрическую интерпретацию. Такой способ не подойдет для визуализации, например, нейросетевого классификатора.

В статье "Image-based Visualization of Classifier Decision Boundaries" (Rodrigues et al., 2018) предлагается эффективный, красивый и достаточно простой альтернативный метод для визуализации решений классификатора, который лишен вышеописанных недостатков. А именно метод подходит для классификаторов любого вида и строит границы принятия решений с помощью изображений с произвольной частотой дискретизации.

Этот пост — краткий обзор основных идей и результатов из оригинальной статьи.

Описание метода

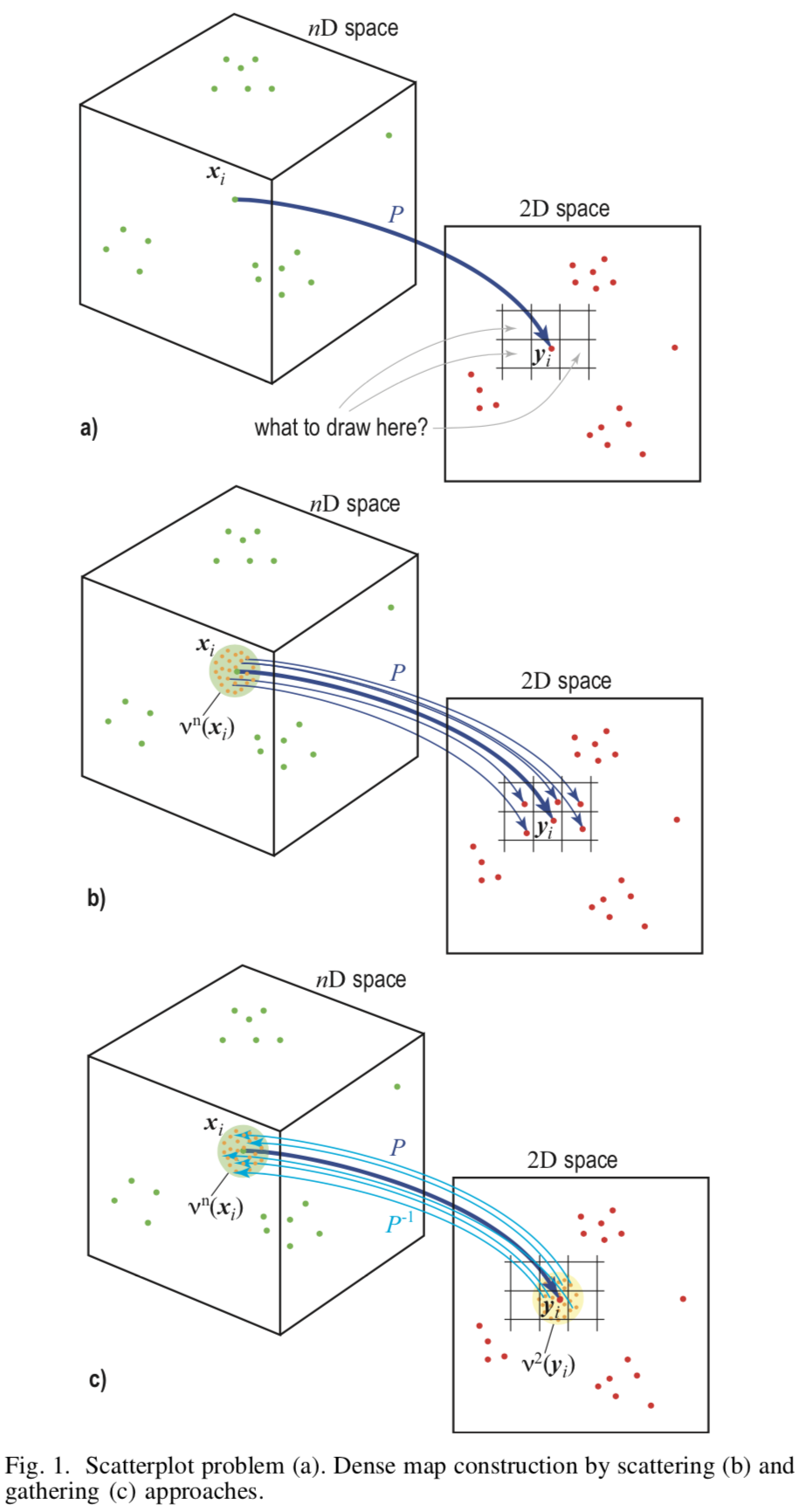

Основу метода составляет обратное семплирование (англ. upsampling) из плоскости изображения

Для работы метода необходимы два отображения

Построение

Чтобы построить изображение необходимо присвоить цвет каждому пикселю. Для этого для каждого пикселя

[Рис.1] Схематическое изображение разных подходов

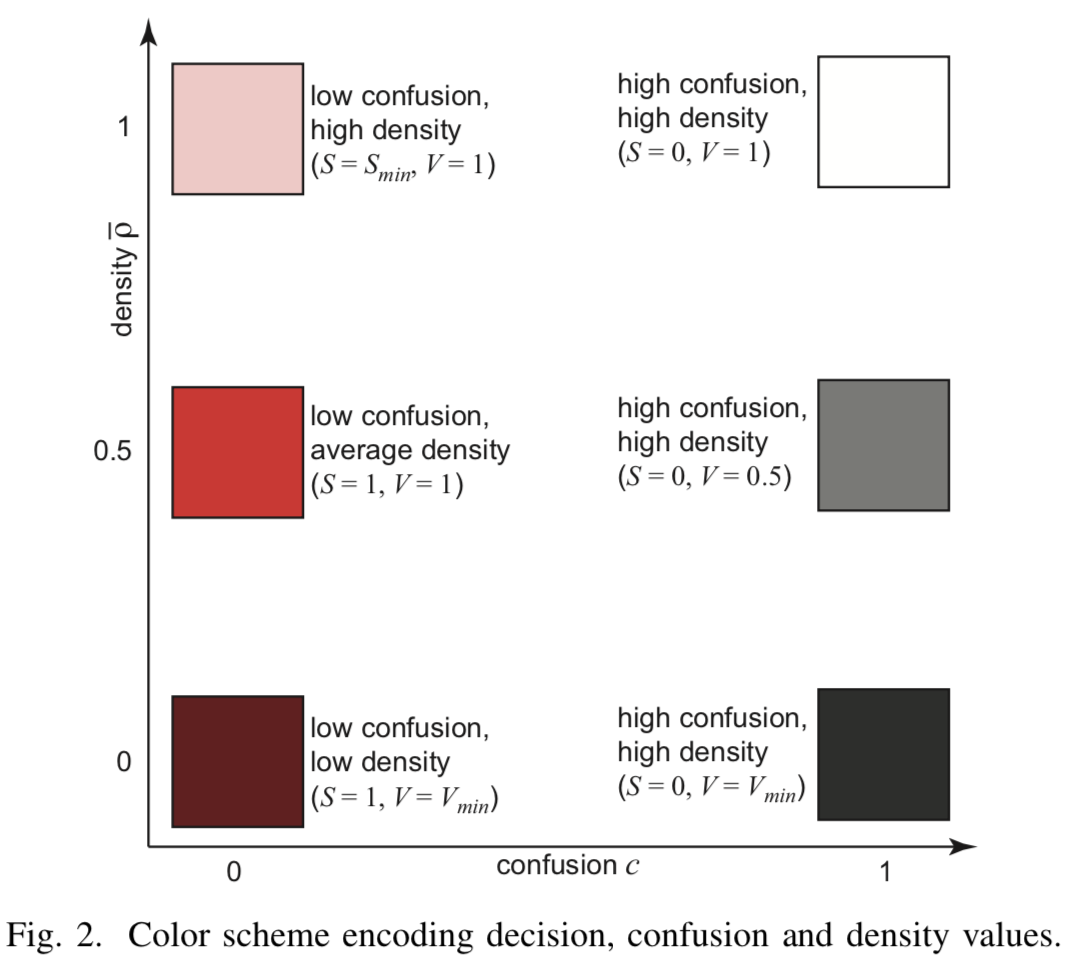

Определение цвета

Цвет

где

Каждому классу поставим в соответствие некоторый тон (англ. hue)

Смешение

Определим смешение пикселя (от англ. confusion)

![Визуализация границ решения классификатора на основе изображений - 23 c(y)=frac{max_{k in C} sum_{y_i in y} [f(P^{-1}(y_i))=k]}{|y|}](https://www.pvsm.ru/images/2020/01/12/vizualizaciya-granic-resheniya-klassifikatora-na-osnove-izobrajenii-23.svg)

Высокое значение

Плотность

Несмотря на то, что были сгенерированы минимум

Тогда, если ![Визуализация границ решения классификатора на основе изображений - 31 hat{rho} in [0, 0.5]](https://www.pvsm.ru/images/2020/01/12/vizualizaciya-granic-resheniya-klassifikatora-na-osnove-izobrajenii-31.svg)

![Визуализация границ решения классификатора на основе изображений - 32 [V_{min}=0.1, V_{max}=1]](https://www.pvsm.ru/images/2020/01/12/vizualizaciya-granic-resheniya-klassifikatora-na-osnove-izobrajenii-32.svg)

![Визуализация границ решения классификатора на основе изображений - 33 hat{rho} in [0.5, 1]](https://www.pvsm.ru/images/2020/01/12/vizualizaciya-granic-resheniya-klassifikatora-na-osnove-izobrajenii-33.svg)

[Рис.2] Цветовое кодирование

Эксперименты и результаты

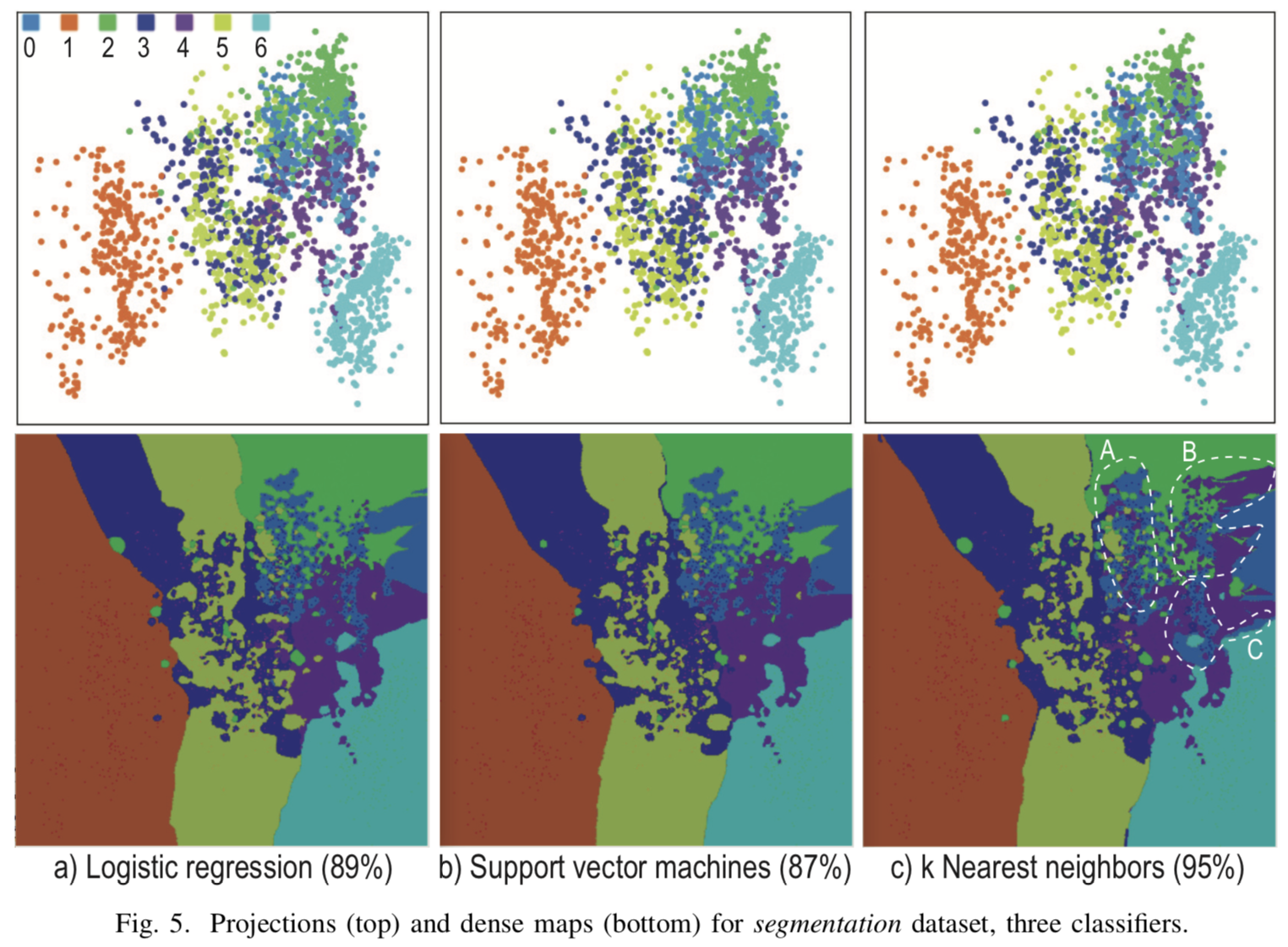

Для экспериментов решались задачи бинарной классификации на наборе изображений цифр MNIST и многоклассовой классификации на наборе The Image Segmentation Dataset, который содержит 2310 изображений, поделенных на 7 классов. Для каждого изображения имеется 19 признаков.

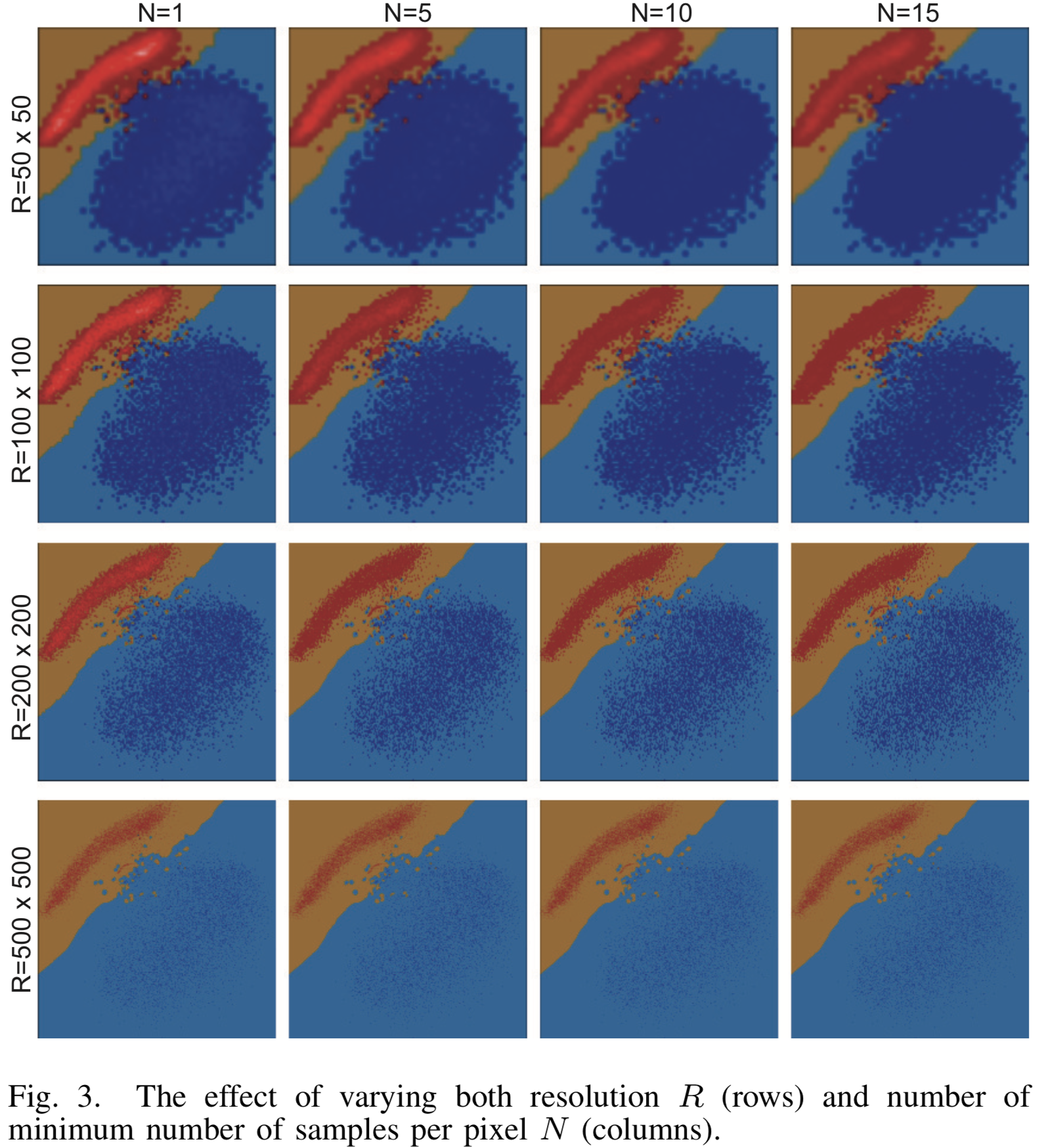

Результаты визуализации при различных параметрах разрешения

[Рис. 3] Результат визуализации для различных параметров разрешения и минимального числа семплов N для класссификатора LogisticRegression

Визуализация при

[Рис. 4] Результат визуализации трех различных классификаторов для k=7, R=500x500, N=5

Заключение

Визуализация границ классов может быть использована при построении и отладке решающего алгоритма, при подборе гиперпараметров, при борьбе с переобучением, для представления и анализа результатов.

Описанный авторами оригинальной статьи метод может применяться для любых задач классификации, где данные представимы в виде набора признаков фиксированный размерности. В отличие от других алгоритмов визуализации, данный подход может применяться для любых, сколь угодно сложных классификаторов и для наборов данных с произвольным числом примеров, даже с очень небольшим, т.к. даже при малом

Автор: Зотов Алексей

![Визуализация границ решения классификатора на основе изображений - 16 d(y)=text{argmax}_{k in C} sum_{y_i in y} [f(P^{-1}(y_i))=k]](https://www.pvsm.ru/images/2020/01/12/vizualizaciya-granic-resheniya-klassifikatora-na-osnove-izobrajenii-16.svg)