Статистика знает все. И Ильф и Е. Петров, «12 Стульев»

Представьте себе, что вы строите крупный торговый центр и желаете оценить автомобильный поток въезда на территорию парковки. Нет, давайте другой пример… они все равно этого никогда не будут делать. Вам необходимо оценить вкусовые предпочтения посетителей вашего портала, для чего необходимо провести среди них опрос. Как увязать количество данных и возможную погрешность оценки среднего значения? Ничего сложного, но есть нюансы.

Теоретический минимум

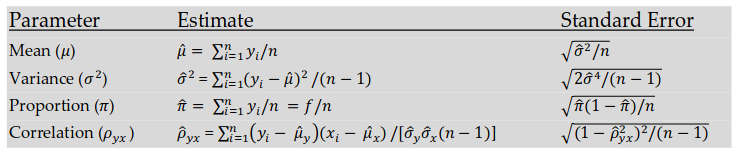

Не будет лишним освежить память, эти термины нам пригодятся далее.

- Популяция – Множество всех объектов, среди которых проводится исследования.

- Выборка – Подмножество, часть объектов из всей популяции, которая непосредственно участвует в исследовании.

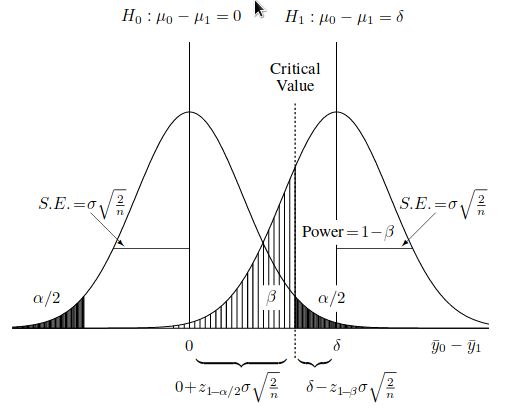

- Ошибка первого рода — (α) Вероятность отвергнуть нулевую гипотезу, в то время как она верна.

- Ошибка второго рода — (β) Вероятность не отвергнуть нулевую гипотезу, в то время как она ложна.

- 1 — β — Статистическая мощность критерия.

- μ0 и μ1 — Средние значения при нулевой и альтернативной гипотезе.

Уже в самих определениях ошибки первого и второго рода имеется простор для дебатов и толкований. Как с ними определиться и какую выбрать в качестве нулевой? Если вы исследуете уровень загрязнения почвы или вод, то как сформулируете нулевую гипотезу: загрязнение присутствует, или нет загрязнения? А ведь от этого зависит объем выборки из общей популяции объектов.

Исходная популяция, также как и выборка может иметь любое распределение, однако среднее значение имеет нормальное или гауссово распределение благодаря Центральной Предельной Теореме.

Относительно параметров распределения и среднего значения в частности возможно несколько типов умозаключений. Первое из них называется доверительным интервалом. Он указывает на интервал возможных значений параметра, с указанным коэффициентом доверия. Так например 100(1-α)% доверительный интервал для μ будет таким (Ур. 1).

- df — Степень свободы = n — 1, от английского «degrees of freedom».

— Двусторонняя критическая величина,

t-критерий Стьюдента.

Второе из умозаключений — проверка гипотезы. Оно может быть примерно таким.

- H0: μ = h

- H1: μ > h

- H2: μ < h

С доверительным интервалом 100(1-α) для μ можно сделать выбор в пользу H1 и H2 :

- Если нижний предел доверительного интервала

100(1-α) < h, то тогда отвергаем H0 в пользу H2. - Если верхний предел доверительного интервала

100(1-α)> h, то тогда отвергаем H0 в пользу H1. - Если доверительного интервала

100(1-α)включает в себя h, то тогда мы не может отвергнуть H0 и такой результат считается неопределенным.

Если нам нужно проверить значение μ для одной выборки из общей совокупности, то критерий обретет вид.

- Отбраковать H0 и принять H1: μ > h, если

.

- Отбраковать H0 и принять H2: μ < h, если

.

- Невозможно отвергнуть H0, если

.

Где

Доверительный интервал, погрешность и размер выборки

Возьмем самое первое уравнение и выразим оттуда ширину доверительного интервала (Ур. 2).

В некоторых случаях мы можем заменить t-статистику Стьюдента на z стандартного нормального распределения. Еще одним упрощением заменим половину от w на погрешность измерения E. Тогда наше уравнения примет вид (Ур. 3).

Откуда легко вывести искомое (Ур. 4).

Практика — считаем с R

Проверим гипотезу о том, что среднее значение данной выборки количества насекомых в ловушке равно 1.

- H0: μ = 1

- H1: μ > 1

| 0 | 1 | 2 | 3 | 4 | 5 | 6 |

|---|---|---|---|---|---|---|

| 10 | 9 | 5 | 5 | 1 | 2 | 1 |

> x <- read.table("/tmp/tcounts.txt")

> y = unlist(x, use.names="false")

>

> z <- c(b)

> mean(z)

[1] 1.636364

> mean(z);sd(z)

[1] 1.636364

[1] 1.654883Обратите внимание, что среднее и стандартное отклонение практически равны, что естественно для распределения Пуассона. Доверительный интервал 95% для t-статистики Стьюдента и df=32.

> qt(.975, 32)

[1] 2.036933и наконец получаем критический интервал для среднего значения: 1.05 — 2.22.

> μ=mean(z)

> st = qt(.975, 32)

> μ + st * sd(z)/sqrt(33)

[1] 2.223159

> μ - st * sd(z)/sqrt(33)

[1] 1.049568В итоге, следует отбраковать H0 и принять H1 так как с вероятностью 95%, μ > 1.

В том же самом примере, если принять, что нам известно действительное стандартное отклонение — σ, а не ее оценка полученная с помощью случайной выборки, можно рассчитать необходимое n для данной погрешности. Посчитаем для E=0.5.

> za2 = qnorm(.975)

> (za2*sd(z)/.5)^2

[1] 42.08144Поправка на ветер

На самом деле нет никаких причин, полагать, что нам будет известна σ (дисперсия), в то время как μ (среднее) нам еще только предстоит оценить. Из-за этого уравнение 4 имеет мало практической пользы, кроме особо рафинированных примеров из области комбинаторики, а реалистичное уравнение для n несколько сложнее при неизвестной σ (Ур. 5).

Обратите внимание, что σ в последнем уравнении не с шапкой (^), а тильдой (~). Это следствие того, что в самом начале у нас нет даже оценочного стандартного отклонения случайной выборки —

А что на счет второго слагаемого правой стороны 5-го уравнения, откуда оно взялось? Так как

Помимо уравнений 4 и 5 есть еще несколько приблизительно-оценочных формул, но это уже заслуживает отдельного поста.

Использованные материалы

Автор: Микаел Григорян

![Как определить размер выборки? - 12 $n=left[frac{z_{alpha/2}*sigma}{E}right]^2$](https://www.pvsm.ru/images/2017/10/11/kak-opredelit-razmer-vyborki-12.svg)