На протяжении десятилетий нейробиологи пытались объяснить, как один нейромедиатор, дофамин, может одновременно выполнять две совершенно разные задачи. С одной стороны, он подкрепляет обучение, основанное на вознаграждении. С другой – запускает физическую активность. Новое исследование проливает свет на переключатель функций дофамина.

Рубрика «обучение с подкреплением»

Ацетилхолин определяет роль дофамина

2026-03-26 в 17:09, admin, рубрики: ацетилхолин, биоритмы, дисциплина, дофамин, мозг, обучение, обучение с подкреплением, работа дофамина, работа мозга, собранностьОбучение ИИ в 2026 году: Как обучаются современные модели?

2026-01-24 в 14:21, admin, рубрики: AI, ИИ, машинное обучение, нейросеть, обучение без учителя, обучение с подкреплением, обучение с учителем, самообучениеДоброго времени суток, «Хабр»!

Вы когда-нибудь задумывались, что такое машинное обучение и как оно вообще учится? Чем это может отличаться от обычного программирования с его главным правилом: не трогай, пока работает? Где заканчивается простой код и где он переходит во что-то более мощное - в ИИ-модели, которые мы используем сегодня.

Сегодня мы разберем основы ИИ - обучение моделей. Посмотрим какие способы обучения бывают, зачем их применяют и как они показывают, на что модель способна.

Принимайте стратегически удобное положение, ну а я перехожу к своему повествованию.

Intro Reinforcement Learning

2025-10-15 в 14:51, admin, рубрики: Bellman equation, ml, NeuralNetworks, Policy Iteration, reinforcement learning, обучение с подкреплениемДля меня разобраться в базовых концепциях Reinforcement Learning оказалось не так просто, особенно сложными оказались функции Беллмана. Эта статья — моя попытка систематизировать материал и объяснить себе (и, возможно, другим), что, откуда и почему берется. Будет здорово, если она поможет кому-то разложить все по полочкам.

¯_(ツ)_/¯

Полезные ссылки:

Practical RL (ШАД) (самые полезные материалы были тут)

Лекция №15 "Обучение с подкреплением"

Тренировки. Лекция 3: Введение в обучение с подкреплением

Читать полностью »

Почему молчит умный счетчик? Побеждаем коллизии в сетях NB-IoT

2025-09-25 в 11:10, admin, рубрики: IoT security, IoT-устройства, NB-IoT, reinforcement learning, беспроводные сети, Беспроводные технологии, Интернет вещей, машинное обучение, обучение с подкреплениемIoT-сети проектировали для миллионов устройств, но они захлебываются уже от тысяч. Когда в нашем районе на секунду моргнул свет, 10 000 умных счетчиков одновременно потеряли связь и начали переподключаться. Три четверти так и не смогли выйти в эфир. Проблема в RACH — канале случайного доступа. При массовых подключениях он превращается в узкое горлышко, куда каждый пытается прорваться первым.

«Скайнет» наоборот: как вырастить и обучить ИИ с помощью Дарвин-Гёдель машины для улучшения человеческой демографии

2025-06-25 в 13:12, admin, рубрики: AGI, MADDPG, глубокое обучение, Дарвин-Гёдель машина, демография, искуственный интеллект, миграция, мультиагентные системы, обучение с подкреплениемРазрабатываем и растим «цифрового губера» - консультанта по вопросам государственного политического управления, демографии и миграции. Решаем задачу оптимизации экономики и миграционной политики для устойчивого демографического роста в 89 регионах с помощью взаимодействующих друг с другом и обменивающихся опытом ИИ-агентов. Мультиагентное обучение на основе мутаций, скрещивания и эволюции, Multi-Agent Deep Deterministic Policy Gradient и Darwin Gödel Machine.

Добро пожаловать в эру опыта: почему обучение с подкреплением изменит мир

2025-05-07 в 10:40, admin, рубрики: RL, данные, ИИ, обучение с подкреплением

Исследователи из Google DeepMind опубликовали интересную статью "Welcome to the Era of Experience"Читать полностью »

Глубокое Q-обучение (DQN)

2025-05-03 в 16:11, admin, рубрики: DQN, TSP, задача коммивояжёра, искусственный интеллект, обучение с подкреплением

Немного контекста

Подходит к завершению серия моих заметок про использование идей искусственного интеллекта для решения задачи коммивояжера (TSP). Я последовательно разобрал некоторые классические решения TSP и далее рассказалЧитать полностью »

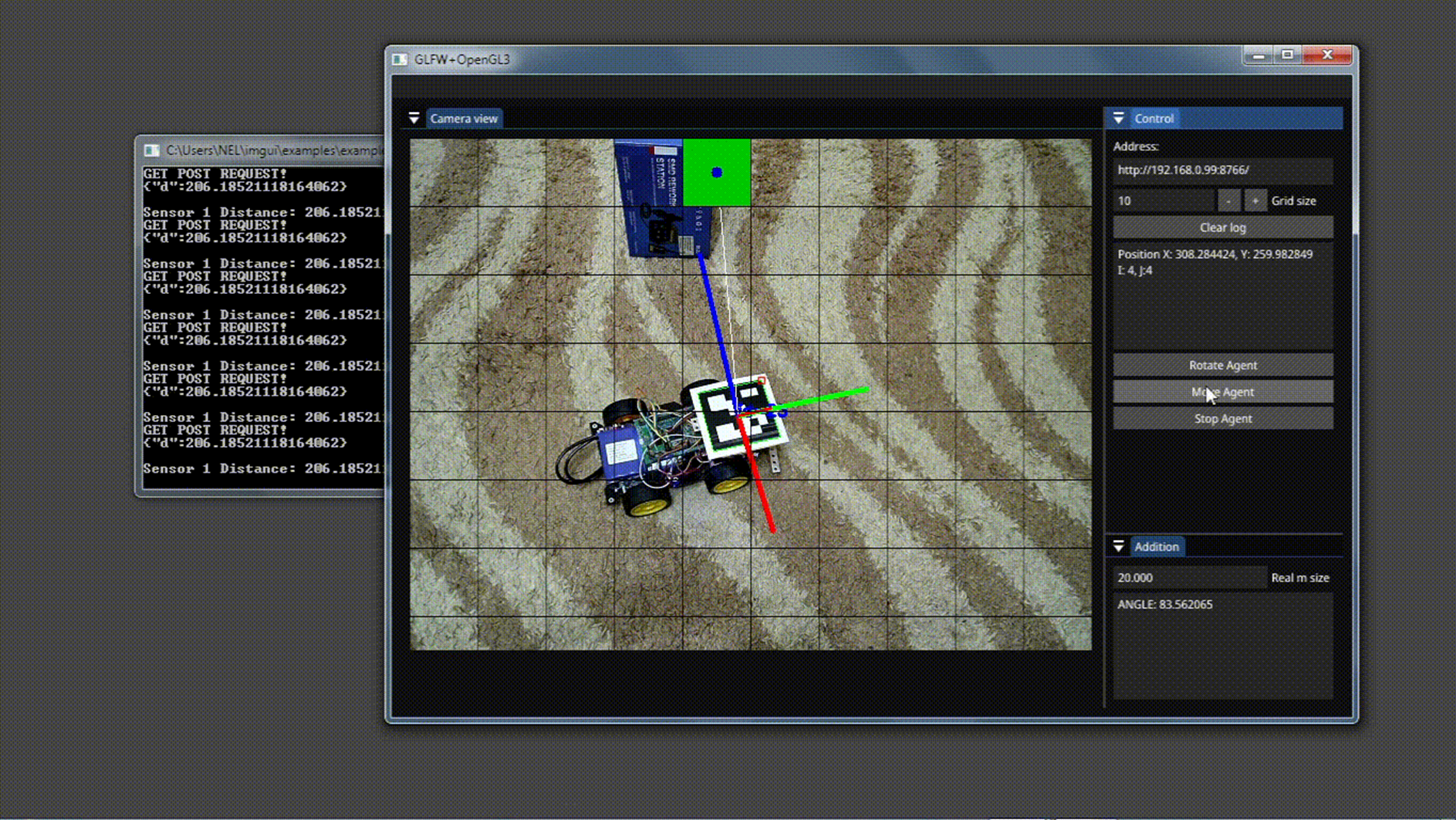

Разработка библиотеки для навигации групп мобильных роботов на транспортной платформе в заранее неизвестной среде

2025-02-18 в 13:15, admin, рубрики: нейронные сети, обучение с подкреплением, сверточные нейронные сети

ИИ на путях: как решить задачу перепланирования расписания движения поездов

2025-01-23 в 15:30, admin, рубрики: artificial intelligence, machine learning, reinforcement learning, жд, ИИ, искусственный интеллект, машинное обучение, обучение с подкреплениемПривет. Я Артур Саакян, главный специалист по анализу данных и машинному обучению в ПГК Диджитал. Мы разрабатываем уникальные цифровые продукты для железнодорожных перевозок, такие как оптимизация ЖД перевозок, навигатор, ЖД карты, цифровой вагон и так далее.

В этой статье опишу подход к оптимизации расписания поездов в реальном времени при помощи обучения с подкреплением (RL), который применим и к российским грузовым ж/д перевозкам, но пока не используется. Тезисы статьи:

-

Перепланирование расписания движения поездов (Train Timetable Rescheduling)

-

Коротко об RL и Q-learning

-

Моделирование железнодорожной средыЧитать полностью »