Рубрика «данные»

Какой была бы Всемирная паутина, если бы вместо WWW был Gopher

2025-10-14 в 13:01, admin, рубрики: gopher, ruvds_статьи, web, www, гипертекст, данные, история интернета, протоколы, сеть, системное администрированиеСтруктуры данных. Часть 1

2025-10-13 в 9:33, admin, рубрики: данные, кортеж, кортежи, словари, словарь, списки, список, структура, структуры, структуры данныхСтруктура данных — это способ организации данных в компьютере, позволяющий прогерам эффективно и удобно их использовать. Структур данных существует достаточно много, и мы с Вами познакомимся с большинством из них — но пока будем двигаться с по порядку.

Список — это абстрактный тип данных, хранящий в себе упорядоченный набор значений. Обозначается через квадратные скобки [].

Способы инициализации

Список можно создавать разными способами — от прямого задания в исходном коде до использования функции list() или ввода данных с клавиатуры.

1. Пустой список

arr = []

Читать полностью »

ЦОД как сервис, сисадмин как разработчик: как менялись модели

2025-09-10 в 9:01, admin, рубрики: ruvds_статьи, данные, дата-центр, облака, провайдер, сисадмин, системное администрирование, хранение данных, цодПочему в 2025-м мы всё ещё слышим «бип» HDD

2025-09-07 в 13:02, admin, рубрики: hdd, ruvds_статьи, ssd, данные, Компьютерное железо, Накопители, хранение, хранение данныхAWS удалил мой 10‑летний аккаунт и все данные без предупреждения

2025-08-15 в 8:35, admin, рубрики: AWS, MENA, данные, защита данных, история разработчика, Общение с поддержкой AWS, ошибка, профиль aws, удаление профиля, хранение данныхЯ 10 лет был клиентом AWS и контрибьютором проектов с открытым исходным кодом, а они удалили мой аккаунт и все данные без какого‑либо предупреждения. Ниже — история о том, как «верификация» у AWS превратилась в цифровую казнь и почему нельзя доверять облачным провайдерам, если у вас нет копий данных вне облака.

На 23 июля 2025 года AWS удалил мой аккаунт, которому было 10 лет, и каждый байт данных, который я там хранил. Без предупреждения. Без льготного периода. Без возможности восстановления. Произошла полная цифровая аннигиляция.

Chief Data Officer: роскошь или необходимость для компаний?

2025-08-03 в 12:16, admin, рубрики: CDO, DG, архитектура данных, данные, данные в компании, данные как продукт, Культура управления данными, управление даннымиА у нас линейдж - джаз! А у вас?

А у нас нет CDO. Вот.

Фразу «данные - новая нефть» слышали, наверное, все. Но нефть сама себя не перерабатывает - нужен специалист, отвечающий за «перегонку» данных в пользу бизнеса. В больших корпорациях эту роль все чаще отдают Chief Data Officer (CDO) - директору по данным. Действительно ли каждой компании жизненно необходим такой человек, или это дань моде? Сейчас попробую разобраться на человеческом языке, без бюрократии и с капелькой иронии.

Когда компании действительно нужен CDO?

Если нужно сгенерировать синтетические данные — подборка открытых решений

2025-07-30 в 13:22, admin, рубрики: llm, ml, MWS, данные, датасеты обучения, обучение моделей, синтетические данные

Про снижение расходов на работу с данными расскажемЧитать полностью »

Плотнее, быстрее, дешевле: керамические накопители Cerabyte бросают вызов LTO

2025-07-06 в 8:12, admin, рубрики: selectel, данные, информация, Накопители

Объемы данных растут стремительно: к 2030 году, по прогнозам, мир накопит 175 зеттабайт информации. Компании ищут способы хранить эти массивы надежно, компактно и без лишних затрат. Ленточные хранилища LTO десятилетиями были стандартом для архивов, но их ограничения — короткий срок службы, медленный доступ и высокие расходы на обслуживание — становятся всё заметнее. Немецкая компания Cerabyte предлагает альтернативу: керамические накопители, записывающие данные фемтосекундными лазерами. Их технология обещает большую емкость, высокую скорость и стоимость ниже, чем у LTO. Сейчас цель — стать конкурентом лент к 2030 году. В статье разберем, что за технология, какие у нее возможности и проблемы.

Читать полностью »

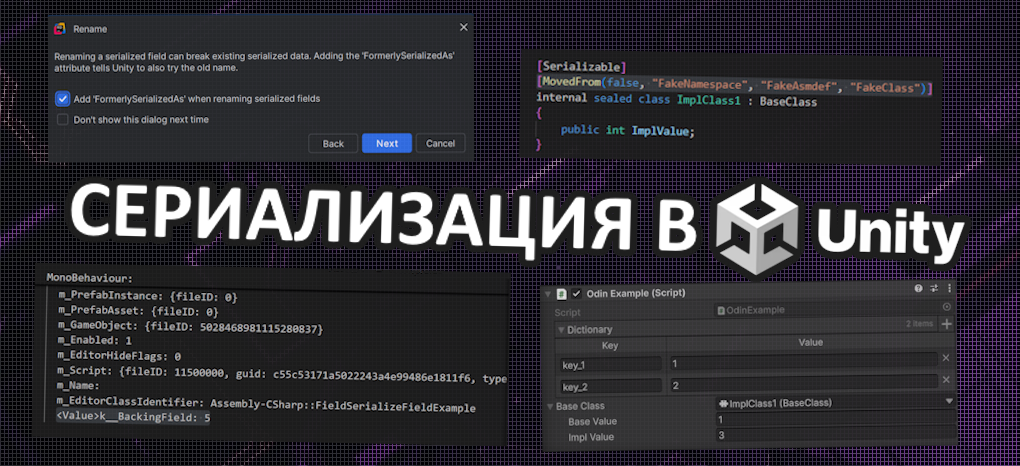

Сериализация в Unity: известные атрибуты и их проблемы

2025-06-21 в 5:56, admin, рубрики: Gamedev, serialization, SerializeField, serializereference, unity, ассеты, геймдев, данные, игровая разработка, сериализация

Любой Unity-разработчик знаком с атрибутом [SerializeField]Читать полностью »

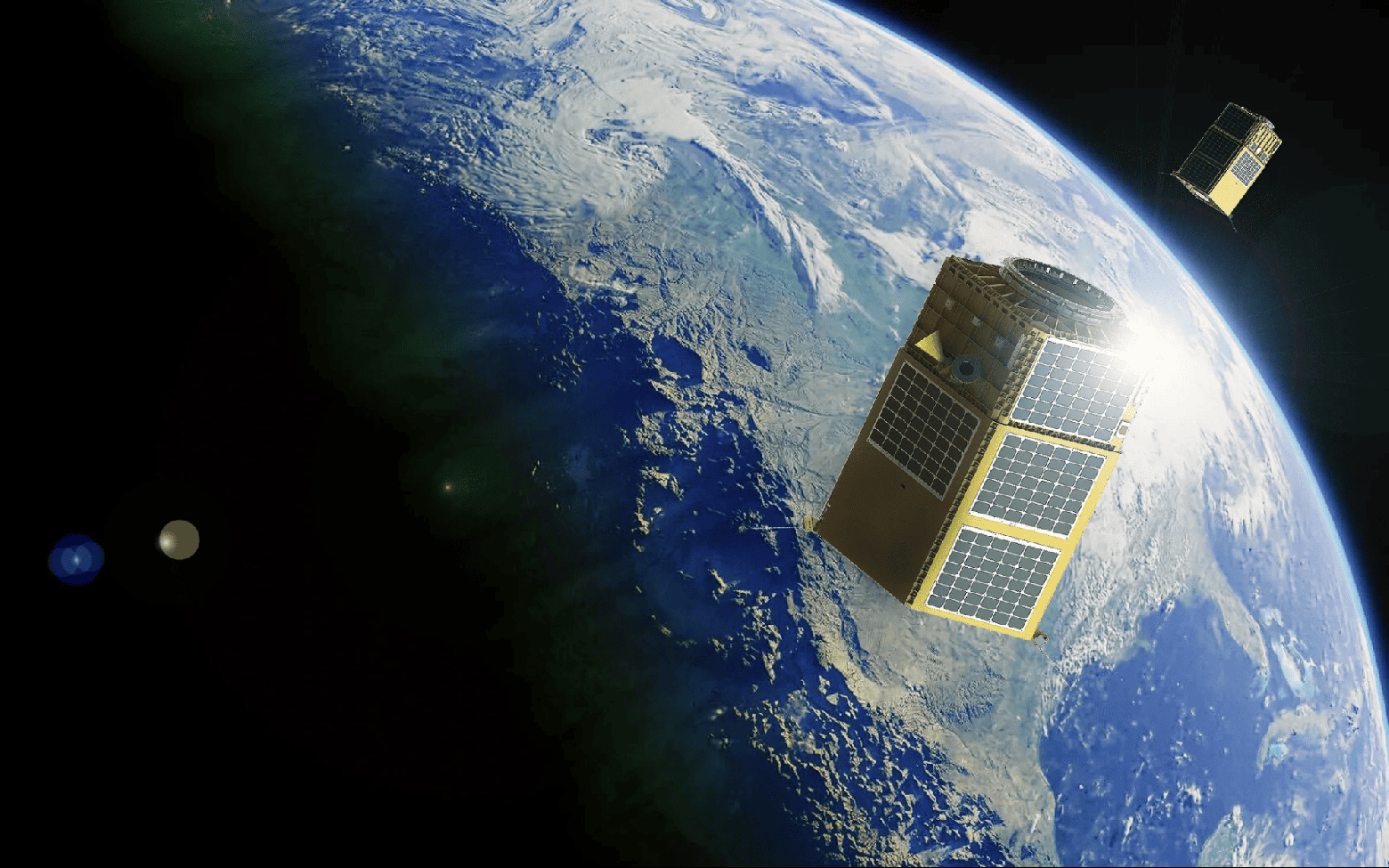

Дата-центр на орбите: технические особенности футуристической концепции

2025-05-20 в 13:01, admin, рубрики: gpu, ruvds_статьи, будущее, данные, дата-центры, инфраструктура, облака, серверы, тренды, хостинг, цод

Недавние проекты — от китайской «Трёхтелесной вычислительной констелляции» с ИИ-спутниками до коммерческих инициатив вроде Lumen Orbit и Lonestar Data — наглядно демонстрируют, что идея «ЦОД в космосе» вышла за рамки научной фантастики.

Предыдущая статья вызвала множество комментариев и споров по этой теме, поэтому я решил изучить этот вопрос подробнее — опираясь не на громкие ИТ-тренды, а на реальные научные исследования и практику (ссылки на первоисточник проставлены по тексту).

Эта статья не источник для споров и не личный опыт автора, а база для обмена мнениями. Кто знает, может именно в комментариях «Хабра» родится истина о том, как настроить работу ЦОДов в космосе.