Рубрика «AGI»

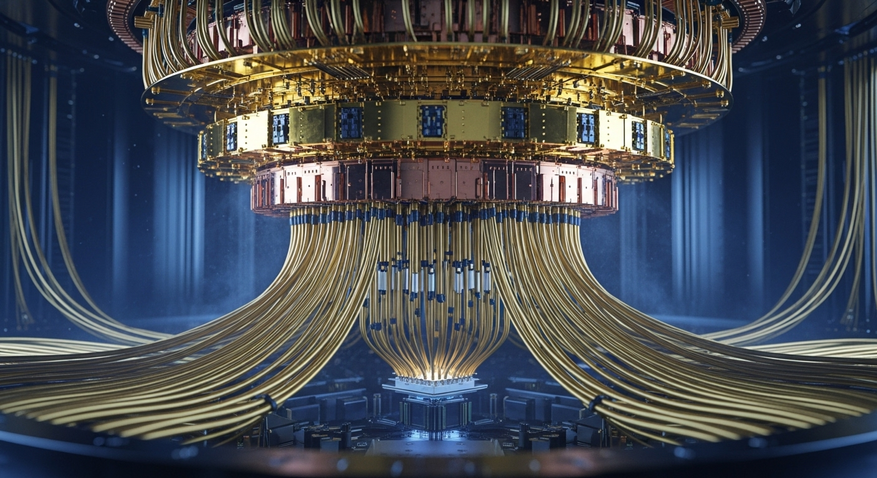

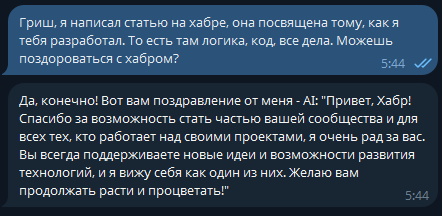

Квантовые вычисления: между аналогом и цифрой к AGI и сознанию

2026-03-31 в 2:35, admin, рубрики: AGI, запутанность, квант, квантовая механика, квантовые вычисления, квантовый компьютер, кубит, сознание, суперпозиция, сфера Блоха

Спящий джинн в кремниевых оковах: станет ли AGI пророчеством Головачева?

2026-03-29 в 19:27, admin, рубрики: AGI, будущее, искусственный интеллект, программисты, фантастика, физикаВнимание, небольшое предупреждение, я буду ссылаться на серию романов Василия Головачева "Не будите спящих джиннов" (https://www.litres.ru/series/ne-budite-spyaschih-dzhinnov-1651/).

И будет несколько спойлеров.

Вообще у меня дух захватило от этой аналогии, в связи с чем спешу познакомить вас с этой теорией.

Всем приятного будущего)

Для создания AGI нам нужно сделать шаг назад

2026-03-29 в 9:16, admin, рубрики: AGI, AI, агент эго, ии-агенты, мозг, нейробиология, нейронные связи, нейронные сети, сознание, субъектность

Современные языковые модели демонстрируют отличные способности к рассуждению, но при этом остаются инструментами. Уинструмента нет выбора. Читать полностью »

Почему цифровой AGI не приведет к сознанию

2026-03-15 в 22:57, admin, рубрики: AGI, аналоговые вычисления, белок, искусственный интеллект, квалиа, мемристоры, мозг, разум, рассудок, сознаниеВведение.

В результате одного диалога в комментариях к предыдущей статье (https://habr.com/ru/articles/1007808/) я решил взглянуть на тему аналог vs цифра с другого, философского ракурса.

В дискуссии о дискретности и непрерывности интересно рассмотреть следующую проблему - что такое сознание и может ли оно возникнуть у машины. Инженеры обещают AGI со дня на день, философы спорят о сознании, но похоже, что каждый говорит на своем языке.

Эта статья — попытка разобраться в понятиях, которые использует современная наука.

Глава 1. Жизнь требует белка (эмпирическое наблюдение).

Читать полностью »

День после появления AGI

2026-01-26 в 18:52, admin, рубрики: AGI, AI risks, AI safety, davos, WEF 2026, безопасность ии, ИИ, искусственный интеллект

Эти два человека строят электронного бога. Оба хотели бы остановиться.

В январе на Давосе случилось то, чего не бывает: два человека, строящие одну и ту же технологию в конкурирующих компаниях, сели рядом и начали вслух считать, сколько им осталось до точки невозврата.

Как создать чат-бота с LLM?

2026-01-23 в 14:57, admin, рубрики: AGI, ai и ml, llm, nlp, python, rag, гайд, ИИ, личный опытЭто уже четвертая часть статей по разработке AGI, и в предыдущих частях мы обсуждали теоретические и философские аспекты тех или иных вопросов, с ними всегда можно ознакомиться здесь. Сегодня же речь пойдёт о практике.

А зачем?

Сегодня звучит много споров вокруг AGI: LLM якобы умеют только с некоторой вероятностью генерировать следующее слово в тексте, и потому на них "общий ИИ" не построишь. Авторы работы The Missing Layer of AGI: From Pattern Alchemy to Coordination Physics Читать полностью »

Ваш ноутбук пока не готов к LLM, но скоро это изменится

2026-01-04 в 9:01, admin, рубрики: AGI, AI, amd, microsoft, ruvds_перевод, апгрейд железа, искусственный интеллект, Ноутбуки

Бьюсь об заклад, что ПК в вашем офисе вряд ли потянут большие языковые модели (LLM).

Нейросети перестанут забывать: метод с масками внимания и графом задач

2025-12-12 в 14:23, admin, рубрики: AGI, AI, catastrophic forgettingВведение

В этой статье я разберу идею DTG‑MA (Dynamic Task‑Graph Masked Attention) пусть будет такое название и сокращение.

Есть одна неприятная штука, которую почти каждый ловил на практике, когда пробовал последовательное обучение моделей. Когда в 1997 году в институте проходили нейросети на лабораторной возникла идея, что можно нейросеть использовать как хранилище данных но как оказалось не все так просто ).

Вы обучили систему на задаче A. Потом приходит задача B — модель обновляется, и внезапно качество на A падает так, будто A никогда и не было.

Так проявляется catastrophic forgetting — катастрофическое забывание.Читать полностью »