Рубрика «storage»

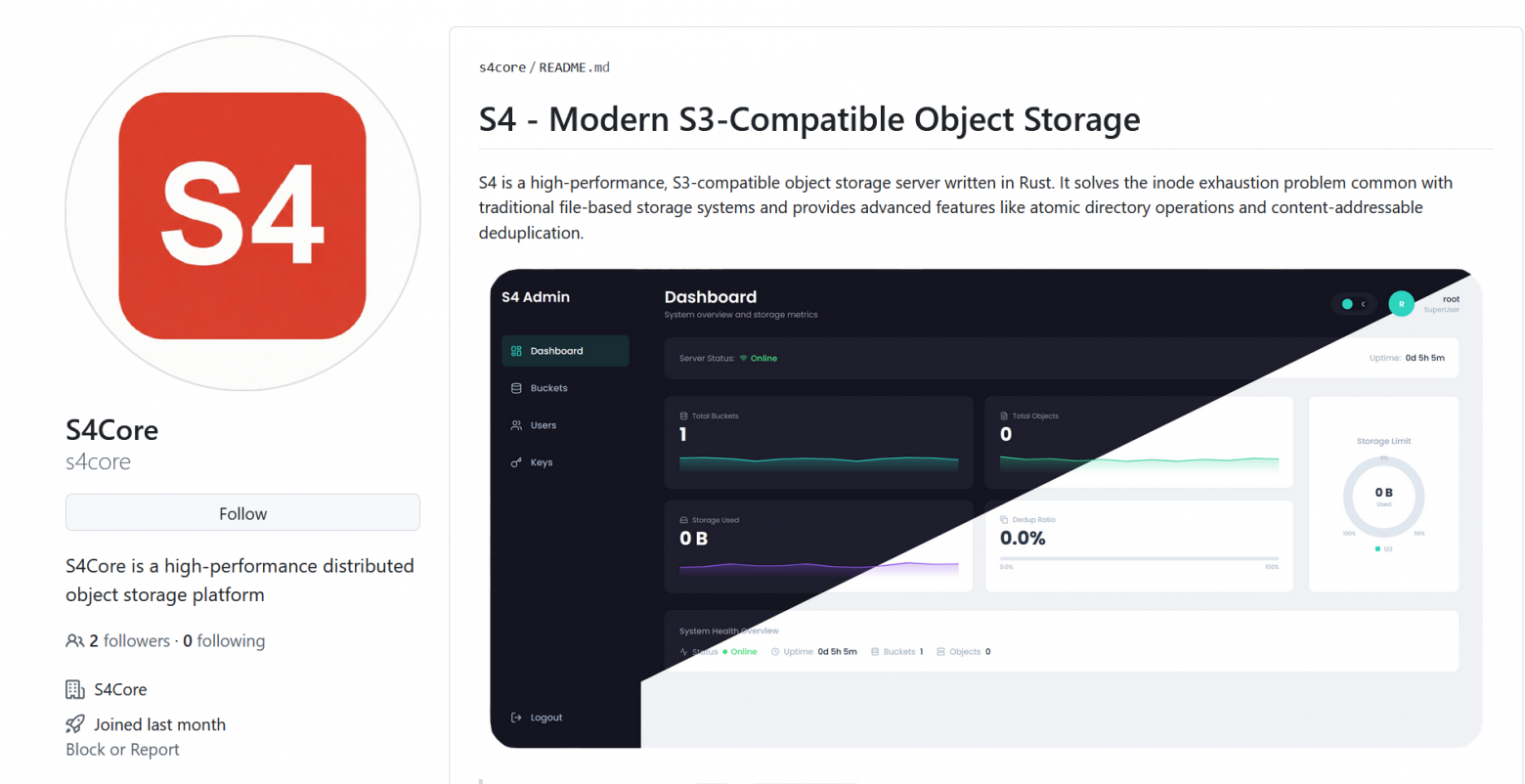

Как я искал замену MinIO S3 и написал свой S4 на Rust

2026-03-05 в 16:16, admin, рубрики: ceph, garage, minio, Rust, rustfs, s3, seaweedfs, storageОт наскальных рисунков до S3: эволюция хранения данных

2025-09-22 в 7:00, admin, рубрики: private s3, public s3, s3, selectel, storage, безопасность данных, облако, облачные сервисы, сервера, хранение данных

Как вы храните данные? Используете файловое хранилище, S3Читать полностью »

Как мы храним 20000+ метрик и миллиарды комбинаций разрезов в одной таблице

2025-05-29 в 9:12, admin, рубрики: BigData, clickhouse, data analysis, data engineering, data structures, M42, python, storageПривет! Меня зовут Влад Божьев, я старший разработчик юнита АБ-тестирования Авито. В нашей команде мы ежедневно работаем с по-настоящему большими объёмами данных – это не просто фигура речи, это наша реальность. Мы помогаем создавать метрики, которые помогают бизнесу не «гадать на кофейной гуще», а принимать взвешенные решения, основанные на данных.

Максимизация производительности ScyllaDB

2025-05-19 в 10:15, admin, рубрики: BigData, cassandra, data warehouse, dwh, IoT, no sql, nosql, scylladb, sql, storageЗдравствуйте!

Меня зовут Александр Андреев, я старший инженер данных. В своей первой статье на "Хабре" я хочу рассказать об оптимизации производительности NoSQL базы данных ScyllaDB.

Введение в ScyllaDB

ScyllaDB — это высокопроизводительная распределённая NoSQL база данных, совместимая с Apache Cassandra на уровне протокола, но предлагающая значительно более высокую пропускную способность и меньшую задержку. В отличие от Cassandra, которая написана на Java, ScyllaDB реализована на C++ с использованием фреймворка SeastarЧитать полностью »

Мультипарт-загрузка в объектное хранилище Selectel: пишем тривиальный пример на Python

2025-03-04 в 11:12, admin, рубрики: multipart upload, object storage, python, s3, selectel, storage, объектное хранилище

Объектные хранилища с доступом на базе S3 API — это, возможно, лучшее решение для хранения больших объемов данных. Однако при загрузке крупных файлов могут возникнуть проблемы. Например, долгая передача данных из-за сетевых ограничений или таймауты и обрывы соединения. Как ни крути, а интернет даже здесь диктует свои условия. Попробуем их обойти с помощью мультипарт-загрузки.

Привет! Меня зовут Гришин Александр, я продакт-менеджер в Selectel и отвечаю за развитие объектного хранилища и облачных баз данных. В этой статье я расскажу, как загружать большие файлы в S3 с помощью мультипарт-загрузки, используя Python и boto3. Под катом вы узнаете, как работает этот механизм и как его настроить для эффективной работы.Читать полностью »

Дедупликация в OpenZFS теперь хороша, но использовать её не стоит

2024-12-12 в 11:46, admin, рубрики: dedup, deduplication, filesystem, OpenZFS, reflink, storage, zfs

Вот-вот выйдет релиз OpenZFS 2.3.0 с новой функцией Fast Dedup. Это огромный шаг вперёд по сравнению со старой дедупликацией и отличный фундамент для будущих доработок.

Контрибьютор OpenZFS @gmelikov и команда Читать полностью »

Как мы законтрибьютили целую строчку в HashiCorp Vault

2024-10-04 в 10:08, admin, рубрики: Go, grpc, ozon tech, security, storage, VaultПривет! Меня зовут Пётр Жучков, я руководитель группы хранения секретов и конфигураций в отделе Message Bus в Ozon. Мы отвечаем за поддержку и развитие системы хранения и использование секретов, активно сотрудничаем с ребятами из департамента информационной безопасности, чтобы все сервисы могли безопасно работать с секретами.

Свой S3-server: что делать, если ваши десятки петабайт уже не лезут в коробочные объектные хранилища

2024-06-03 в 8:24, admin, рубрики: ceph, lusca, ozon tech, rgw, s3, s3server, Scylla, scylladb, storageВ 2024 году уже незачем рассказывать об S3-интерфейсе и сравнивать его с другими вариантами организации объектного хранилища. Вот и мы в Ozon, конечно, предоставляем такое платформенное решение широкому спектру внутренних потребителей. От сервисов, которые хранят картинки товаров для каталога, до бэкапов баз данных. От собственных внутренних разработок, до open-source-решений, таких как Gitlab и Thanos.

Переизобретаем файловую систему: (Open)ZFS

2023-10-30 в 10:40, admin, рубрики: file system, OpenZFS, storage, zfs, zfsonlinux

Хранение данных — это всегда боль, у которой может быть больше 50 оттенков: железо, кэш, гарантии, производительность, скорость восстановления при проблемах, удобство и прочее. Как решить большинство из них, при этом получив что-то легко обслуживаемое, да ещё бесплатно? Сегодня поговорим про файловые системы на примере не совсем дефолтной OpenZFS.

Читать полностью »

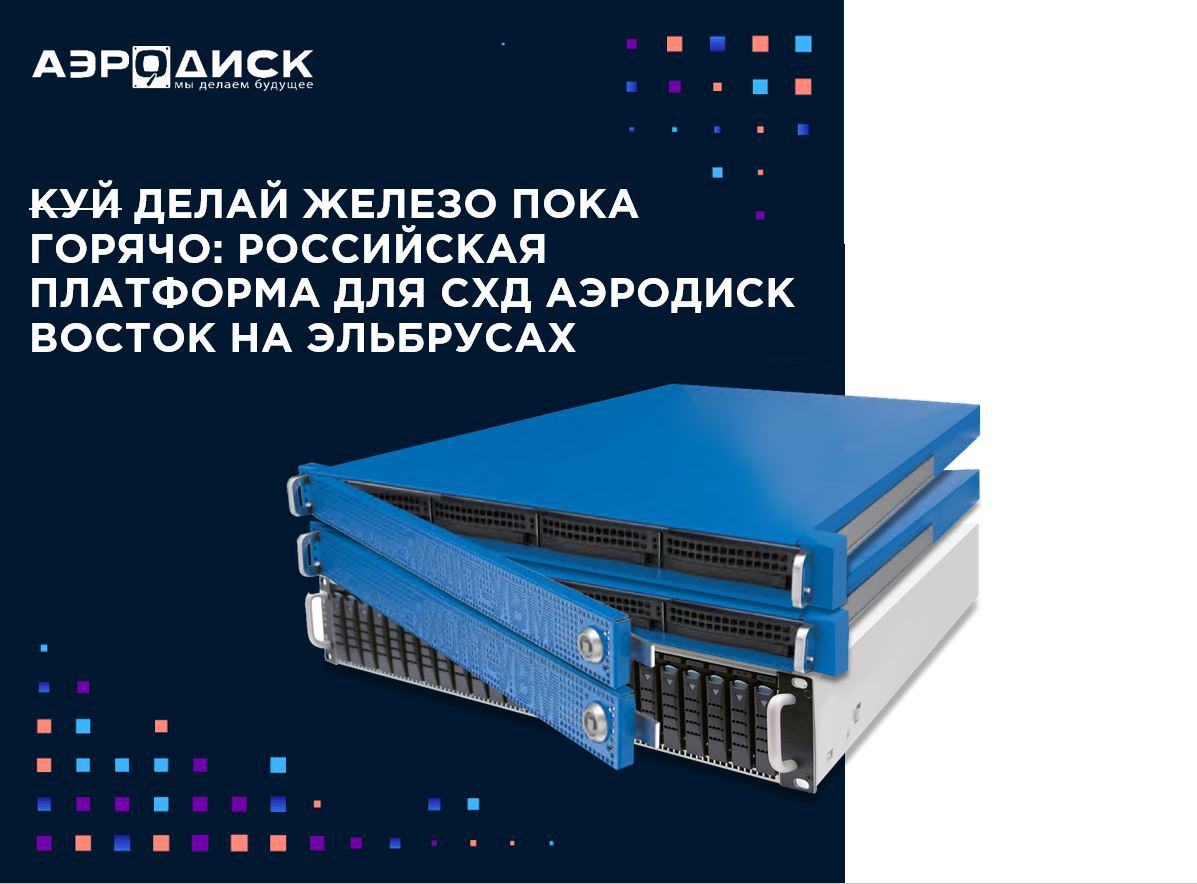

Как делается российское железо для СХД Аэродиск Восток на Эльбрусах

2020-05-28 в 14:24, admin, рубрики: Aerodisk, E2K, linux, SAN, storage, Блог компании AERODISK, импортозамещение, МЦСТ, Норси-транс, российское оборудование, система хранения данных, системное администрирование, СХД, хранение данных, хранилища данных, Эльбрус

Всем привет. Как мы и обещали, погружаем читателей Хабра в детали производства российских аппаратных платформ для СХД Аэродиск Восток на процессорах Эльбрус. В этой статье мы пошагово опишем производство платформы Яхонт-УВМ Э124, которая в 5 юнитах эффективно вмещает 124 диска, может работать при температуре +30 градусов по Цельсию и при этом не просто работает, а хорошо работает.

Также 05.06.2020 мы организовываем вебинар, где подробно расскажем о технических нюансах производства СХД Восток и ответим на любые вопросы. Зарегистрироваться на вебинар можно по ссылке: https://aerodisk.promo/webinarnorsi/