Рубрика «резервное копирование»

Dumper: единый инструмент для резервного копирования баз данных

2025-10-23 в 14:13, admin, рубрики: backup, cron, devops, mongodb, mysql, open source, postgresql, автоматизация бэкапов, бэкап баз данных, резервное копированиеВведение

Когда в инфраструктуре десятки сервисов и баз данных разных типов, ручное резервное копирование превращается в кошмар.

Один сервер использует PostgreSQL, другой — MySQL, третий — MongoDB, и для каждого нужны свои команды (pg_dump, mysqldump, mongodump) и свои скрип��ы.

Проект Dumper решает эту проблему он объединяет все типы баз в один универсальный инструмент.

Dumper написан на Go и работает через CLI, конфигурация задаётся в YAML — поэтому его легко встроить в cron, CI/CD pipelines, GitHub Actions или Docker-окружение.

Преимущества Dumper

Резинка, постепенно ломающая старые жёсткие диски

2025-03-05 в 13:01, admin, рубрики: conner, Quantum, ruvds_перевод, Восстановление данных, жесткие диски, резервное копирование, ремонт жестких дисков

В рамках моей работы над будущим постом об утерянном и наконец-то найденном фрагменте истории Mac я экспериментировал со старыми жёсткими дисками SCSI под брендом Apple, выпускавшимися Quantum и Conner в 1990-х. В этой статье я расскажу о хорошо известном в мире винтажных компьютеров факте, который, думаю, будет интересен читателям.

Дело в том, что многие из этих жёстких дисков уже отказываются работать. Это очень распространённая проблема у старых моделей Quantum ProDrive, например, LPS и ELS. Шпиндель раскручивается, но мы не слышим ожидаемого паттерна щёлкающих звуков запуска, а спустя несколько секунд он снова останавливается.Читать полностью »

Смотреть или выгружать: тонкости работы с сырыми логами в CDN

2024-09-17 в 8:57, admin, рубрики: CDN, s3, selectel, логи, объектное хранилище, резервное копирование, сырые логи

Логи в CDN — мощный инструмент для администраторов и разработчиков, который дает доступ к детальной информации о запросах пользователей. Он помогает оптимизировать производительность, улучшить качество обслуживания, обеспечить безопасность онлайн-сервисов и доступность контента для конечных пользователей. Чтобы сделать эту работу эффективнее, мы добавили в панель управления возможность выгружать сырые логи. В этой статье разберемся, что это такое, в каких случаях такая опция может пригодиться и почему обычного просмотра логов иногда недостаточно.Читать полностью »

Производительность Windows 11 «комически низкая», в интерфейс внедряют рекламу. Люди возвращаются на Windows 10

2024-06-17 в 9:00, admin, рубрики: adblock, Amperage, Bloatynosy, Copilot Plus, npu, OFGB, POPCNT, Recall, ruvds_статьи, SSE 4.2, Windows 10, windows 11, Windows 12, Windrecorder, Winpilot, блокировка рекламы, меню Пуск, производительность, резервное копирование, Чёрное зеркало

На рынке операционных систем происходит странное. Доля Windows 11 не растёт, как положено для новинки, а снижается. Согласно апрельской статистике Statcounter, после достижения рекордного показателя 28,16% в феврале 2024 года доля Windows 11 упала до 26,19% в апреле.

Тем временем доля Windows 10 за тот же период приблизилась к 70%. И это после того, как Microsoft объявила о завершении поддержки Windows 10 в октябре 2025 года.

Что вообще происходит?Читать полностью »

Disney уволила сотрудницу, спасшую «Историю игрушек»? Не совсем

2023-07-05 в 8:36, admin, рубрики: disney, pixar, sparc, SPARCstation, sun, Toy Story, Toy Story 2, бэкапы, графика, история игрушек, История игрушек 2, Компьютерная анимация, компьютерная графика, Работа с 3D-графикой, резервное копирование, старое железо

Кадр из «Истории игрушек 4»

В конце мая студия Pixar впервые за десятилетие сократила штат. После неудач в прокате «Базза Лайтера» компания уволила 75 сотрудников, включая двух старших менеджеров. В ленты новостных агентств новость просочилась только в начале июня, но чуткий глаз тематических СМИ выцепил среди уволенных одну наиболее интересную персоналию. В числе прочих расстались с сотрудницей, которая когда-то спасла случайно удалённую «Историю игрушек 2».

Двадцать пять лет назад, когда Pixar готовила к выходу очередной полнометражный фильм, технический директор Гэлин Сасмен выполняла свои обязанности из дома. Когда в офисе случайно удалили всю работу над «Историей игрушек 2», на компьютере Сасмен нашлась резервная копия. Такой сюжет попытались рассказать некоторые тематические сайты (1, 2, 3, 4, 5). Другие не стесняясь заявили (1, 2), что Сасмен спасла всю $3,2-миллиардную франшизу.

Случившееся в реальности сложнее и интереснее, чем простая история о несправедливости.

Читать полностью »

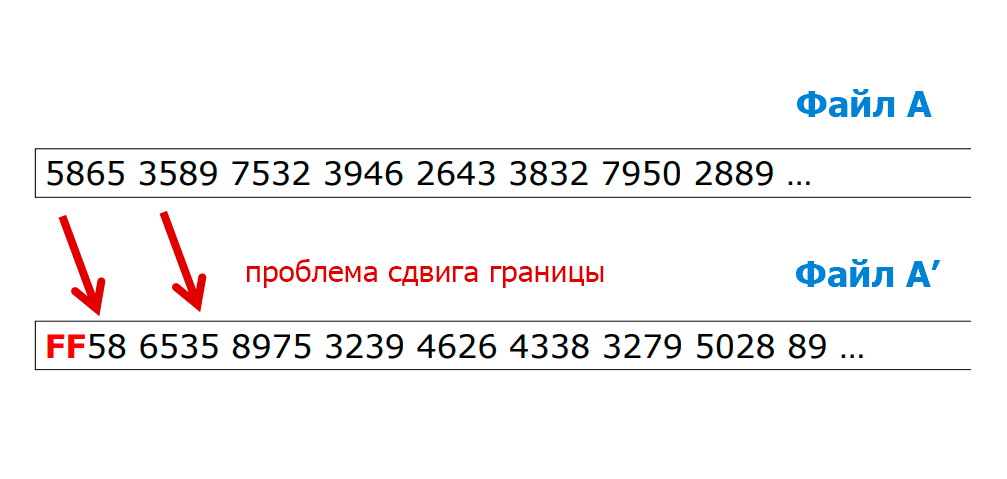

RSync на стероидах с поддержкой Windows

2023-05-10 в 9:00, admin, рубрики: casync, CDC, CDC RSync, cdc_rsync, cdc_stream, Content-Defined Chunking, rcp, rolling hash, Rsync, ruvds_статьи, scp, sftp, ssh, stadia, адресация по контенту, Алгоритмы, Блог компании RUVDS.com, дедупликация, резервное копирование, сжатие данных, синхронизация данных, системное администрирование, скользящий хеш

На Хабре периодически рассказывают о новых инструментах для синхронизации данных. Это интересная тема. Такие программы используются:

- для синхронизации файлов на разных устройствах,

- дедупликации,

- резервного копирования,

- сжатия.

Малейшая оптимизация даёт экономию трафика, места, ускоряет синхронизацию и общую производительность любых систем. Всё, везде и сразу. В эпоху веб-приложений и клиент-серверной архитектуры со множеством девайсов, которые работают в единой инфраструктуре, синхронизация — Святой Грааль, одна из базовых технологий в компьютерной области.

Кроме того, инструменты синхронизации интересны с алгоритмической точки зрения. Любопытно, как люди умудряются оптимизировать базовые алгоритмы типа rsync, которые вроде бы работают идеально. Но нет, всегда можно придумать что-то получше.

Читать полностью »

Цифровое хомячество и цифровой минимализм — противоположные концепции и стили жизни

2022-12-05 в 9:00, admin, рубрики: digital hoarding, ruvds_статьи, архивирование данных, Блог компании RUVDS.com, здоровье, лайфлоггинг, Накопители, Научно-популярное, резервное копирование, хранение информации, цифровое накопительство

Имея в своём распоряжении петабайтные диски, появляется соблазн сохранять абсолютно всё. Все интересные фильмы и музыку, которые мы видели и слышали, семейные видео и фото. Прочитанные книги, написанный код. Письма, полученные и отправленные. Документы, мысли, заметки в Obsidian или Evernote (система типа «второй мозг»). Действительно, зачем удалять хоть один файл, если места хватает?

Противоположный подход — изначально ограничивать себя в потреблении информации, игр, фильмов, любого контента, чтобы не захламлять диск (и сознание) ненужной информацией. И хранить только самое лучшее, в минимальном количестве.

Читать полностью »

Пожары в дата-центрах. Как выстроить надёжное резервирование?

2022-09-28 в 9:00, admin, рубрики: 3-2-2-1-0, 4-3-2, China Telecom, ruvds_статьи, Tier 2, Блог компании RUVDS.com, гибридное облако, дата-центры, мультиоблачное решение, мультицодовость, пожары, правило 3-2-1, резервное копирование, Серверное администрирование, хостинг, хранилища данных, цод, электрический взрыв

Когда 16 сентября 2022 года загорелся небоскрёб China Telecom со столбом пламени в десятки метров и взрывами, то первым делом возник вопрос — что так сильно горит в 42-этажном офисном здании? Вскоре выяснилось, что здание не совсем офисное. Оказалось, на нескольких этажах размещался ЦОД. А все мы знаем, что по правилам резервирования Tier 2 дата-центр обязан хранить запасные энергоносители на случай отключения основного питания.

Что такое «запасные энергоносители»? Это могут быть заряженные аккумуляторы, ну, или дизельное топливо…

Читать полностью »