Практическое пособие для разработчиков по AI-ассистированной разработке с интеграцией MCP и автоматизированными хуками

Практическое пособие для разработчиков по AI-ассистированной разработке с интеграцией MCP и автоматизированными хуками

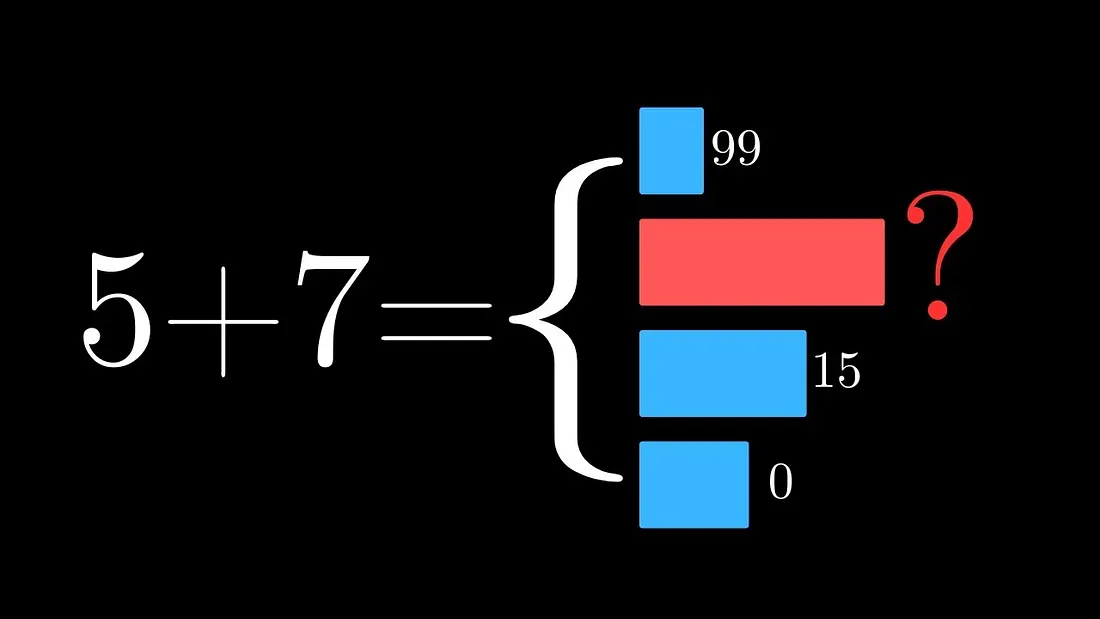

Самый частый вопрос к тезису о том, что языковые модели не думают - чисто практический.

Всем салют! Новый год начался, и мы продолжаем рассказывать про кибертренды и делать киберпрогнозы. Поговорим про технологические тренды, меняющие правила игры в сфере ИБ.

Сейчас каждый делает решения для безопасности AI.

Последний год я анализировал разные решения и вот к какому выводу я пришёл:

Они все поразительно похожи:

Написаны на Python

ML-классификаторы для детекции

REST API обёртка

50-200мс задержка

Десятки зависимостей

Облачный деплой

И вот неудобная правда:

Они сами становятся векторами атак.

Когда ваш слой безопасности:

Имеет 50+ зависимостей (каждая — потенциальная CVE)

Добавляет 50-200мс к каждому запросу (приглашение для DDoS)

Каждый раз, когда вы говорите нейросети «Спасибо», вы запускаете конвейер, в котором перемножаются сотни матриц с миллиардами элементов, и сжигаете электричества столько же, сколько светодиодная лампа за несколько секунд.

Это первая статья из небольшого цикла, посвящённого сетям для AI/ML-кластеров и HPC.

В этой серии мы коснёмся принципов работы и обучения моделей, параллелизации, технологий DMA и RDMA, сетевых топологий, InfiniBand и RoCE, а ещё пофилософствуем на тему общих и специальных решений.

Бьюсь об заклад, что ПК в вашем офисе вряд ли потянут большие языковые модели (LLM).

Оценка американского фондового рынка сегодня выше, чем перед крахом 1929 года. Что это значит для всех нас?

Современные большие языковые модели достигли впечатляющих результатов в генерации текста, однако они до сих пор остаются жуткой стохастикой. На мой взгляд проблема текущего ИИ заключается не в синтетических обучающих данных или архитектурных ограничениях, а в отсутствии внутренней верификации.

Ещё в 2022 году разработчики, использующие искусственный интеллект, казались своего рода чудаками. Однако в 2025 году совместный отчёт DORA и Google Cloud показал, что сейчас 90% специалистов используют AI-помощников в повседневной работе.

Рынок предлагает множество платформ для разработчиков: ChatGPT, GitHub Copilot, Claude и многие другие. Однако в российских реалиях их использование усложняется необходимостью подключения к VPN, трудностями с оплатой сервисов и другими проволочками. Поэтому стоит обратить внимание на отечественные аналоги, в частности, GigaCode.