Не сердитесь, друзья - это очередной маленький эксперимент над "могуществом генеративного ИИ" - не только и не столько чтобы позабавиться, а больше чтобы наглядно уяснить "границы применимости". Скормим ИИ незамысловатую задачку и увидим как его "колбасит" - то есть, насколько GPT на самом деле не думает а скорее пробует комбинировать в надежде что пользователю понравится результат. Обратите внимание что YandexGPT 3 это не "новейшая модель" - вы сможете попробовать в более новых.

Рубрика «gpt» - 14

Девушки, Свиньи и YandexGPT 3

2024-10-09 в 5:13, admin, рубрики: gpt, задача, искусственный интеллект, юморКак ChatGPT меняет наш стиль письма — и почему это может стать проблемой

2024-10-03 в 8:05, admin, рубрики: chat gpt, gpt, распознавание, тексты

Вы замечали, как в текстах часто повторяются фразы вроде "углубиться в" (delve into) или "навигация по ландшафту" (navigate the landscape)? Эти выражения стали обычными не только в соцсетях, но и в новостях, научных публикациях и даже студенческих эссе. Причина этого — растущее использование Читать полностью »

Обзор k8sgpt: как искусственный интеллект помогает обучать DevOps-инженеров

2024-10-03 в 6:28, admin, рубрики: AI, devops, gpt, gpt-4, k8s, k8sgpt, kubernetes, ИИ, искусственный интеллект, обучениеВсем привет! На связи Евгений Торин, DevOps-инженер компании «Флант». Я давно хотел попробовать в деле искусственный интеллект и даже в качестве эксперимента генерировал картинки для своих презентаций. Но полноценно погрузиться в эту область удалось, лишь когда появилась практическая необходимость.

Я, Нейросеть: как программисты научили компьютеры говорить

2024-09-30 в 15:14, admin, рубрики: Eliza, gpt, нейросеть, языковая модель, языковые моделиНейросети сегодня пишут новости, рекламные тексты, стихотворения и даже целые сценарии. Как мы пришли к этому? Рассказываем историю языковых моделей — от симулятора психотерапевта из 1960-х до первых нейросетей в начале 21 века.

Как GPT-4o помог мне создать плагин для After Effects: экономим часы на нейминге слоев

2024-09-18 в 16:16, admin, рубрики: after effects, AI, gpt, gpt-4, gpt4all, javascript, Visual Studio, ПрограммированиеВремя — деньги

В индустрии анимации и визуальных эффектов время — бесценный ресурс. Работая над проектами, содержащими сотни или даже тысячи слоев, переименование каждого слоя вручную превращается в изнурительную задачу, способную занять часы. Это не просто утомляет — это выбивает из творческого потока и негативно сказывается на качестве работы. Время, которое могло быть потрачено на создание анимации, уходит на приведение проекта в состояние, когда с ним "хоть как-то можно начать работать.

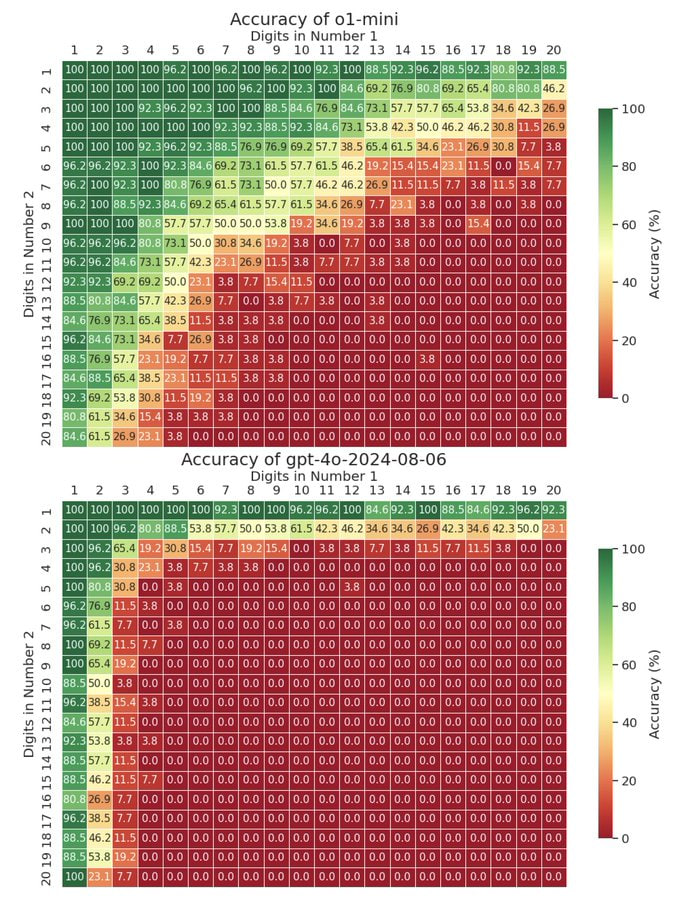

Насколько нейросеть — хороший калькулятор?

2024-09-18 в 14:51, admin, рубрики: chatgpt, gpt, o1, o1-mini, o1-preview, OpenAIИсследованием поделился Yuntian Deng в Твиттере.

Он протестировал умножение чисел с разным количеством знаков, вплоть до 20.

На примере сравнения o1, o1-mini и gpt-4o.

Оказалось, что GPT4o еле вывозит 4-значные числа, а o1 справляется даже с 9x9.

о1: почему новая GPT от OpenAI — это не хайп, а переход к новой парадигме в ИИ

2024-09-18 в 5:00, admin, рубрики: chatgpt, gpt, gpt-4, llm, machinelearning, natural language processing, o1, OpenAI, нейросети, языковые моделиПоследние пару лет развитие языковых нейросетей как будто бы шло по принципу «больше, длиннее, жирнее»: разработчики пытались раздуть свои модели на как можно большее число параметров и прогнать через них максимальный объем тренировочных данных. 12 сентября OpenAI выпустили новую LLM, которая добавляет в это уравнение еще одно измерение для прокачки: теперь можно масштабировать объем «мыслей», который модель будет тратить в процессе своей работы. В этой статье мы разберемся, чему научилась новая GPT o1, и как это повлияет на дальнейшую эволюцию ИИ.

Используем таблицу Google как базу для GPT-бота (вместо Notion)

2024-09-07 в 6:20, admin, рубрики: chatgpt, Google, gpt, notion, OpenAI, python, sheet, базы данных

Поводом написания этой статьи стал уход из России Notion, так как мы активно подключали в качестве баз данных к нашим GPT-ботам базы в Notion (статья про это: Читать полностью »

GPT — технология добра-зла

2024-09-05 в 18:11, admin, рубрики: gpt, gpt-4, python, python3, нейронная сеть, нейросети, нейросетьМогут ли трансформеры «думать»

2024-09-01 в 11:56, admin, рубрики: generalization, gpt, грокинг, задачи рассуждения, обобщение, общий искусственный интеллект, память ИИ, память трансформеров, трансформаторНедавние исследования показывают, что модели трансформеров способны почти безошибочно решать задачи, требующие нескольких логических шагов. Например, из утверждения А вывести Б и дойти логически до В. И что удивительно, это достигается без использования Chain-of-Thought или особых промптов — только классический GPT-2. Давайте посмотрим, как трансформеры «думают» при решении задач рассуждения, и напишем для этого код с использованием библиотеки Hugging Face.