Рубрика «базы данных»

Сбор сведений из открытых источников: почему это рискованно, если выкачивается информация из чужих баз данных?

2026-05-13 в 10:31, admin, рубрики: база дынных, базы данных, законодательство, защита данных, защита данных пользователей, парсинг, парсинг данных, парсинг контента, парсинг сайта, парсинг сайтовПарсинг данных: когда это законно, а когда нет — разбираю судебную практику

2026-05-07 в 11:06, admin, рубрики: авторское право, антимонопольное право, базы данных, веб-скрапинг, интеллектуальная собственность, парсинг, персональные данные, скрапинг, судебная практикаКомпании используют парсинг каждый день: мониторинг цен, сбор контактов, агрегация объявлений. При этом большинство не задумывается о правовых рисках, ссылаясь на то, что «интернет открытый». В статье разбираю, что говорит закон и чем закончились реальные споры.

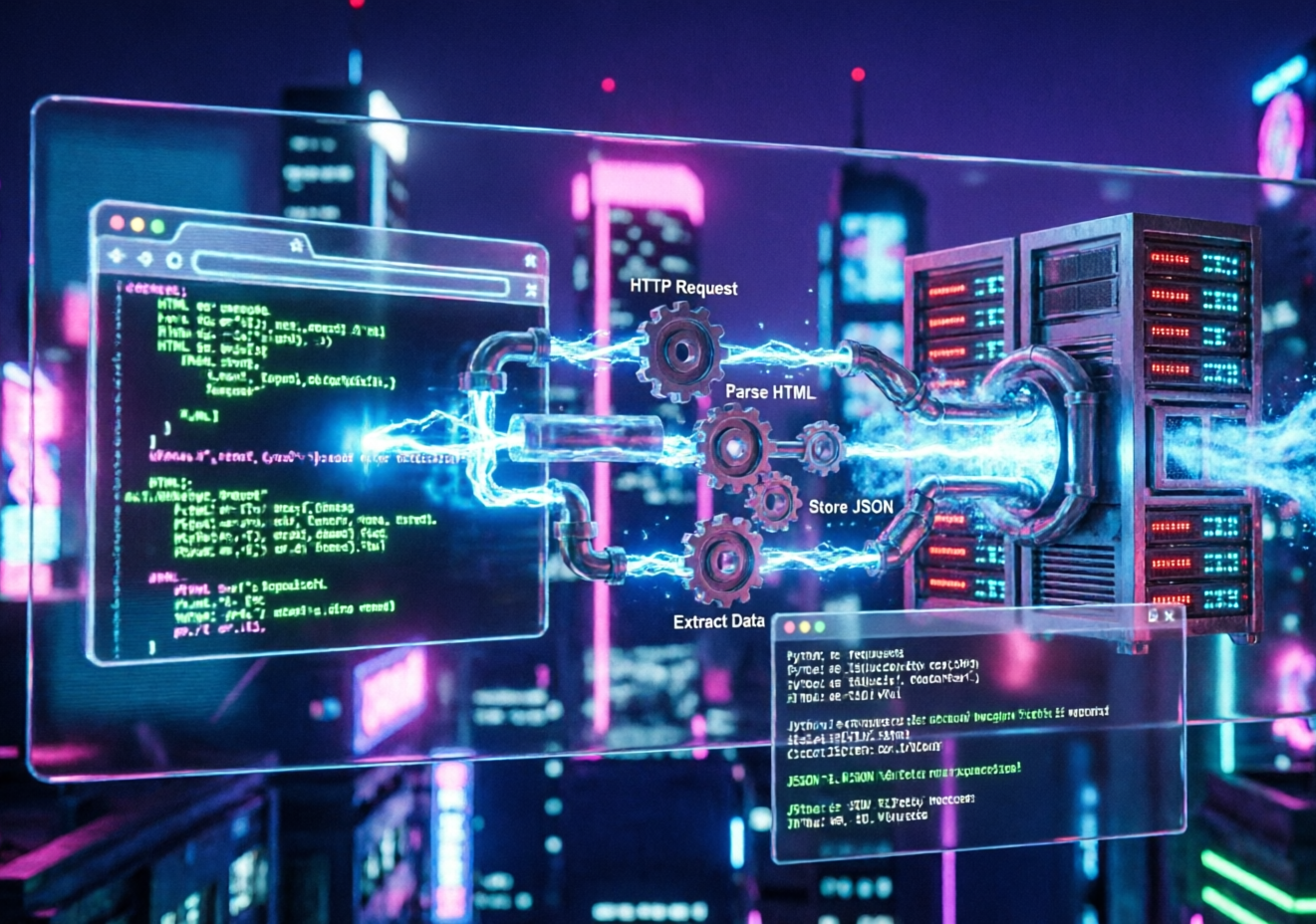

Парсинг (скрапинг) — автоматизированный сбор данных с сайтов. Технически всё выглядит просто: задаёшь условия, программа проходится по сайту, сортирует данные, выдаёт отчёт. Однако юридически могут возникать определенные риски.

Когда парсер проходится по сайту, он потенциально затрагивает сразу несколько правовых режимов:

Долгие миграции на старте сервиса — это не startup-проблема. Это ошибка в архитектуре релиза

2026-04-29 в 15:31, admin, рубрики: database, deployment, devops, kubernetes, migrations, postgresql, probes, администрирование, базы данных, миграцияКогда сервис поднимается по 8-15 минут, команда почти всегда начинает крутить одни и те же ручки: увеличивает initialDelaySeconds, добавляет startupProbe, поднимает progressDeadlineSeconds, иногда переносит миграцию в initContainer и считает, что стало «по-кубернетесному». Обычно это не лечение. Это способ аккуратнее завернуть проблему в YAML. Если тяжёлая миграция живёт внутри старта приложения, вы связали жизненный цикл Pod, rollout Deployment и поведение базы в один общий узел. А такие узлы в проде рвутся не там, где их ждут.

Есть очень узнаваемая картина. Новый релиз выкатывается нормально на staging, а в production внезапно «висит». kubectl get podsЧитать полностью »

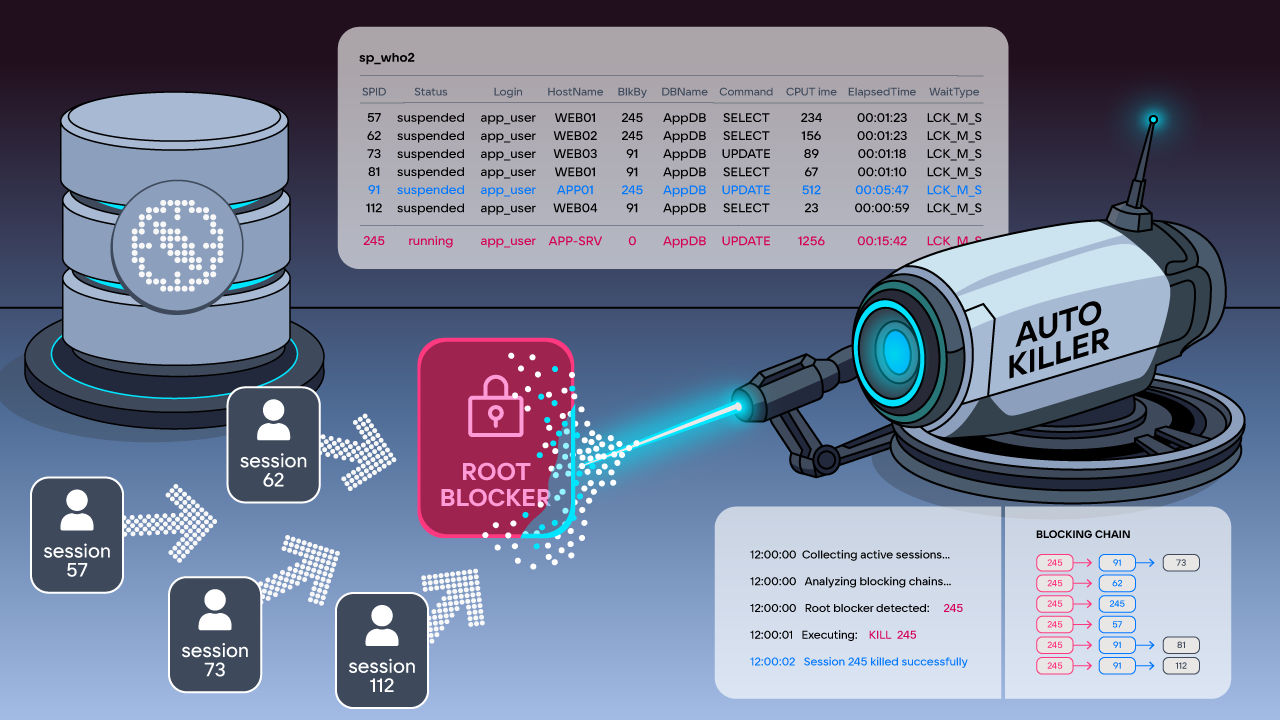

Реализация автоудаления блокирующих сессий в MS SQL

2026-04-24 в 11:40, admin, рубрики: database, MS SQL, MS Sql Server, sql, базы данных, Программирование

Привет! Меня зовут Евгений Грибков, я ведущий разработчик в центре технологий VK. В этой статье я покажу решение, к которому мы с коллегами пришли при работе над одной из наших внутренних систем.

Room или SQLite? Как не писать SQL запросы вручную на Android

2026-04-10 в 12:16, admin, рубрики: android, kotlin, orm, room, sqlite, базы данных, мобильная разработкаЕсли ты разрабатываешь под Android и нужно сохранять информацию на телефоне, без базы данных не обойтись. В системе есть встроенная SQLite — бесплатно и надёжно, но есть минус: чтобы с ней работать, приходится писать SQL-запросы вручную, в коде разбирать объект Cursor и не забывать закрывать соединения. Я сам сталкивался с тем, что из-за такой возни появляются баги и тратится много времени.

Health Score для PostgreSQL: один показатель вместо 150 метрик

2026-03-28 в 13:15, admin, рубрики: devops, health score, postgresql, self-hosted, базы данныхПредставьте: вы открываете Grafana в три часа ночи по алерту. На экране — 30 дашбордов, сотни графиков, и везде мигает жёлтым. CPU 60%, connections 50%, replication lag 500ms, bloat растёт, dead tuples накапливаются. Ни один показатель не пробил красную черту — но что-то явно идёт не так. База тормозит. Пользователи жалуются. А вы стоите перед этим океаном данных и пытаетесь понять: это уже пожар или ещё можно ждать до утра?

Это не гипотетическая история. Именно в такие моменты становится ясно: мониторинг PostgreSQL сломан на уровне концепции. Не потому что метрик мало — их избыток. Проблема в том, что нет единого ответа на вопрос «база здорова?».

Миллиард записей и 8 Марта: как YDB спас праздник

2026-03-26 в 7:01, admin, рубрики: ydb, базы данных, высокая нагрузка, микросервисы, работа с данными, яндексКак отчисление одного студента может закрыть всю кафедру. Нормализуем БД и избавляемся от аномалий

2026-03-23 в 8:00, admin, рубрики: sql, база дынных, базы данных, нормализация отношений, нормальные формы, реляционные базы данных, реляционные бд, реляционные субд, функциональная зависимость

Привет! В прошлой статьеЧитать полностью »

Тест для «сеньора»: в каком типе данных хранить номер паспорта?

2026-03-21 в 8:27, admin, рубрики: базы данных, ошибки разработчиков, проектирование бд, собеседование it, типы данныхПростой вопрос, который разделяет инженеров и «операторов фреймворков»

Я провёл больше ста технических собеседований. Разных: на джуна, мидла, сеньора, системных аналитиков, бэкендеров, фуллстеков.

Почему я перестал держать БД в голове и сделал Structly

2026-03-18 в 4:48, admin, рубрики: web, базы данных, визуализация, кейс, програмиирование, разработкаВсем привет! Меня зовут Константин, я backend разработчик на python. В последний год я разработал несколько больших проектов. В этой статье я хочу рассказать как я начинал работать с базой данных и как я решил свою проблему все время терять контекст.