Привет! Меня зовут Александр Овсов, я RnD-разработчик в компании Just AI. Занимаюсь прототипированием новых фич продукта Jay Knowledge Hub и исследованиями новых возможностей LLM. Jay Knowledge Hub — это умная платформа для поиска по неразмеченным корпоративным данным, созданная на базе RAG и AI-агентов.

Рубрика «llm-модели» - 8

Анализируем сложные данные в CSV-таблицах: как мы усовершенствовали RAG с помощью агентского подхода

2025-04-04 в 14:49, admin, рубрики: llm-модели, rag, sql, база знаний, генеративный ии, ии-агенты, мультиагентные системы, нейросетиРеализация AI агента на базе LLM с нуля – что включает цикл разработки

2025-03-27 в 13:16, admin, рубрики: AI, llm, llm-модели, ИИ, ии-модель, облачные сервисы, языковая модель, языковые моделиРазработка AI агента, использующего большие языковые модели (LLM) – это малоизвестный пока еще и потому интересный инженерный процесс, охватывающий весь цикл создания от идеи до финального развертывания. Технические стандарты разработки агентских систем пока еще формируются. В данной статье я поделюсь своим опытом и рассмотрю ключевые этапы, технологии и практические нюансы, которые встречаются при разработке такой системы с нуля.

Комплексное руководство по конфигурации сервера для LLM

2025-03-17 в 15:15, admin, рубрики: llama, llm, llm-модели, сервер

Привет! Развертывание языковой модели на собственном сервере требует тщательного планирования аппаратной составляющей. В этой статье мы разберем, какие компоненты критически важны для эффективной работы LLM, как они взаимодействуют, и какую конфигурацию выбрать под разные сценарии использования.

Модели T-lite и T-pro: training report

2025-03-12 в 14:30, admin, рубрики: llm-модели, распознавание текста, языковые модели

Привет! Я Дима Стоянов, MLE в команде разработки фундаментальных моделей. Мы продолжаем рассказывать о наших моделях T-lite и T-pro. Общие характеристики и результаты бенчмарков описывали в предыдущей публикации. В этой статье раскроем детали предобучения: от подготовки данных до финальных экспериментов, а совсем скоро поделимся особенностями этапа post-training.

Русскоязычные LLM: отечественные разработки в сравнении с глобальными адаптациями

2025-03-06 в 13:11, admin, рубрики: api, chatgpt, cotype, GigaChat, llm-модели, нейросети, сравнение моделей, языковые моделиСовременные языковые модели (они же LLM, они же Large Language Models) становятся все более востребованными практически во всех сферах. LLM уже не просто инструмент, а важнейшая часть технологического прогресса, позволяющая автоматизировать работу с текстами, проводить анализ данных, генерировать контент и даже серьезно помогать в обучении.

Мама, у меня RAG: пути к улучшению, когда он «наивный»

2025-02-25 в 18:45, admin, рубрики: genai, graph rag, graphrag, knowledge graph, llm-модели, rag, retrival augumented generation, semantic search, ИИ и машинное обучениеВ последние пару лет RAG (retrieval-augmented generation) стал одной из самых обсуждаемых технологий в области обработки текстов и поисковых систем. Его идея проста: объединить поиск (retrieval) и генерацию (generation), чтобы быстрее находить нужную информацию и создавать более точные тексты.

Как известно, интернет был придуман чтобы было куда скидывать фотки ню, и действительно adult media индустрия это хороший индикатор развития какой либо технологии. А что же с ИИ? Использование ИИ в колл-центрах и пользовательской поддержке уже стало обычным делом. Но что, если вы хотите применить его в более специализированной отрасли, например, для создания NSFW-чатботов или автоматизации на платформах вроде OnlyFans или для симуляторов дейтинга?

Так ли хороша DeepSeek-R1, как о ней говорят

2025-02-17 в 10:52, admin, рубрики: deepseek, DeepSeek R1, gpt-4, llm-модели, o1-mini, OpenAI, qwen2.5-max, сравнениеВо всем AI-мире сейчас говорят о новой китайской языковой модели DeepSeek и, конечно, наша команда развития AI не могла пройти мимо этой темы. Мы сравнили ответы новой модели на реальные запросы к нашей технической поддержке с ответами других популярных моделей. Что из этого получилось и какие выводы мы сделали расскажу я — Максим Михайлов, продуктовый менеджер Cloud.ru.

Как научить модель рассуждать, не переобучая её, меньше чем за 10$

2025-02-13 в 19:33, admin, рубрики: llm, llm-архитектура, llm-моделиВведение

Это статья обобщение моего исследования передачи знаний от большой модели с замороженными весами в малую модель, которую мы будем обучать через расширенный механизм кросс внимания или проще говоря через LLM модули. Оригинальное исследование доступно по ссылке: arxiv.org/abs/2502.08213 . Репозиторий с кодом и весами доступен на Hugging Face: LLM модули.

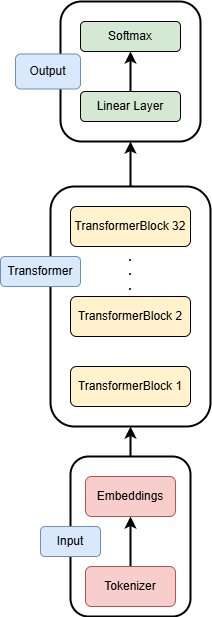

LLM Llama 3 — небольшое погружение в детали

2025-02-04 в 15:29, admin, рубрики: llama 3, llama3, llm, llm-модели, искусственный интеллект, нейросетиПривет! В этой статье я попробую немного разобрать код LLM Llama 3. Полностью проанализировать каждую строку кода не получится, но самые важные и базовые концепции мы все-таки разберем насколько это возможно.

Падаем в кроличью нору

Изучать мы будем класс Llama (файл generation.py) и его метод text_completionЧитать полностью »