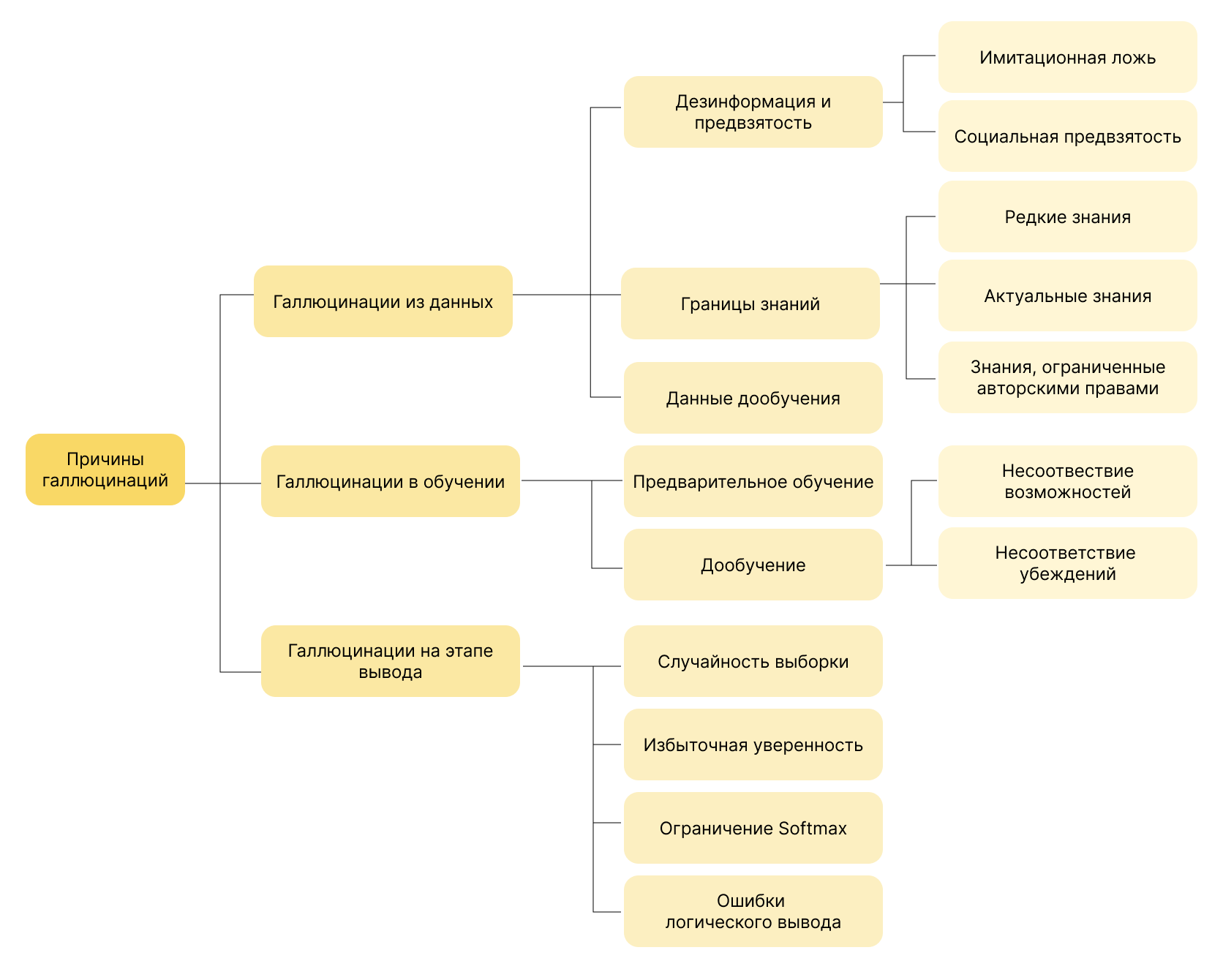

В последние несколько месяцев ведущие модели обновились с функцией «рассуждений» (reasoning). Предполагалось, что качество ответов улучшится. Но последующие тесты показали, что уровень галлюцинаций сильно вырос. И это не какая-то случайная недоработка разработчиков, а фундаментальное свойство. Сейчас становится очевидным, что от галлюцинаций мы не избавимся никогда. Читать полностью »

![Почему галлюцинируют нейросети [и что с этим делают] - 1 Почему галлюцинируют нейросети [и что с этим делают] - 1](https://www.pvsm.ru/images/2024/11/04/pochemu-gallyuciniruyut-neiroseti-i-chto-s-etim-delayut.png)