Рубрика «vlm»

Современные OCR для сложных документов: сравниваем 6 open-source моделей на реальном кошмаре инженера

2025-11-16 в 6:31, admin, рубрики: gemma-3, llm, ocr, paddleocr, qwen3, vlm, мультимодальные модели, распознавание текстаПривет! Каждый, кто хоть раз пытался вытащить данные из скана акта или старого отчета, знает эту боль. Классические OCR-инструменты, вроде старого доброго Apache Tika, отлично справляются с простым печатным текстом, но пасуют перед реальными вызовами: таблицами со сложной вёрсткой, рукописными пометками, мелким курсивом и разными шрифтами в одном документе.

Чтобы не быть голословными, давайте посмотрим на типичный «сложный» документ и что с ним делает Tika.

Тело AI-агентов: технический обзор робота 1X Neo

2025-11-04 в 11:39, admin, рубрики: 1x neo, AI, ai-агенты, llm, ml, NEO, robotics, vlm, гуманоидные роботы, роботыНа днях по AI пабликам завирусился робот 1X Neo, который заявляется разработчиками как человекоподобный робот для помощи по дому. Мне стало жутко интересно покопаться в устройстве и начинке этого робота, потому что скрещивание VLM и механизмов может привести к огромному прорыву в индустрии и новым большим изменениям.

Поговорим про устройство робота, железо и софт на борту, прикладные задачи и ближайшее будущее.

Когда фантастика 1939 года становится реальностью 2025-го

2025-11-01 в 8:29, admin, рубрики: bipedal locomotion, llm, rag, vla, vlm, искусственный интеллект, научная фантастика, онтология, робототехника, роботыВчера вечером я впервые после детства взяла в руки рассказ «Я, робот» Эндо Биндера, опубликованный в январе 1939 года в журнале Amazing Stories.Именно Эндо Биндера (псевдоним братьев Эрла и Отто Биндеров) — а не Айзека Азимова. Это тот самый рассказ, чьё название Азимов «позаимствовал» одиннадцать лет спустя для своего знаменитого сборника 1950 года, причём сам Азимов протестовал против этого решения издателя, понимая, что название уже занято. А фильм 2004 года с Уиллом Смитом сняли по мотивам азимовского цикла о Трёх законах роботехники, так что связь с оригинальным рассказом Биндера только в названии.

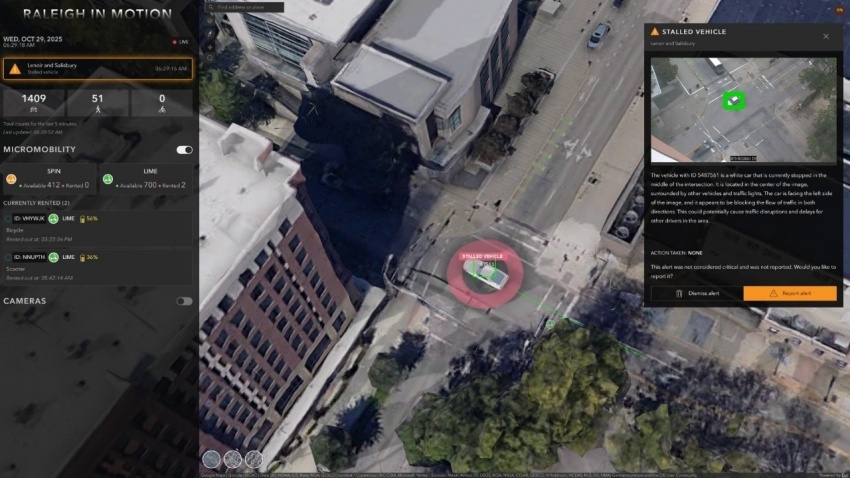

VLM vs IDP (хайп vs конвейер): кто выигрывает в гонке за точностью и эффективностью

2025-10-22 в 12:42, admin, рубрики: AI, idp, llm, ocr, vlm, обработка данных, обработка изображенийVision Language World Model: язык как картина мира

2025-09-05 в 15:35, admin, рубрики: llm, vlm, агенты, ИИПишем отчет о пентесте за 1 час на локальной LLM. Часть 1

2025-08-20 в 12:16, admin, рубрики: llm, redteam, vlm, отчеты, тестирование на проникновениеВ этой статье мы рассмотрим как на оборудовании стоимостью от 1000$, с полностью локальными LLM и VLM на основе скриншотов и коротких пояснений генерировать грамотно написанные отчеты об уязвимостях самого широкого спектра, начиная от Web/мобилок, заканчивая инфрастурктурными уязвимостями Active Directory, k8s и так далее. Заглянем под капот VLM (Vision Language Model) и рассмотрим различные подходы к описанию уязвимостей.

Как мы строили KidFolio — цифровую платформу для родителей и детских садов

2025-07-09 в 11:00, admin, рубрики: CV, ML-продукт, vlm, автоматизация, генерация описаний, Компьютерное зрение, мультимодальные модели, распознавание лицМы — Даврон Ихматуллаев и Михаил Назаров — выпускники онлайн-магистратуры «Науки о данных» Центра «Пуск» МФТИ. В рамках дипломной работы и студенческого стартап-проекта мы разработали KidFolio — цифровую платформу, которая автоматически отправляет родителям персонализированные фото- и видеоотчеты из детского сада, используя технологии компьютерного зрения (CV) и мультимодальных языковых моделей (VLM).

В этой статье расскажем, как мы делали из идеи продукт:

-

от гипотезы и интервью с воспитателями до запуска MVP в виде телеграм-бота;

-

как дообучали модели распознавания лиц под детский домен;

Какая GPT-модель лучше распознаёт аннотации книг?

2025-06-10 в 6:16, admin, рубрики: Anthropic, chatgpt, gemini, llama, mistral, OpenAI, qwen, vibecoding, vlm, сравнениеКакая из современных мультимодальных GPT-моделей лучше и дешевле распознаёт текст с фотографий книжных аннотаций и правильнее выделяет оттуда структурированную информацию? Проведём сравнительное тестирование 28 моделей от Anthropic, Google, Meta, Mistral AI, OpenAI, Qwen и попытаемся ответить на эти вопросы не написав ни одной строчки кода самостоятельно.