Как я собрал семантический поиск по 17 миллионам картинок, не разорившись на AWS

Зачем это всё

Я занимаюсь визуальными искусствами и фронтендом более 10 лет. Для креативной работы мне постоянно нужны референсы, причём основанные на ощущении, визуальном стиле, том, что на английском (да и у нас зачастую) называют vibe.

Был замечательный проект same.energy, который решал именно эту задачу. Когда он перестал работать, я почувствовал себя без рук. И, как инженер, решил не ждать, а собрать свой инструмент.

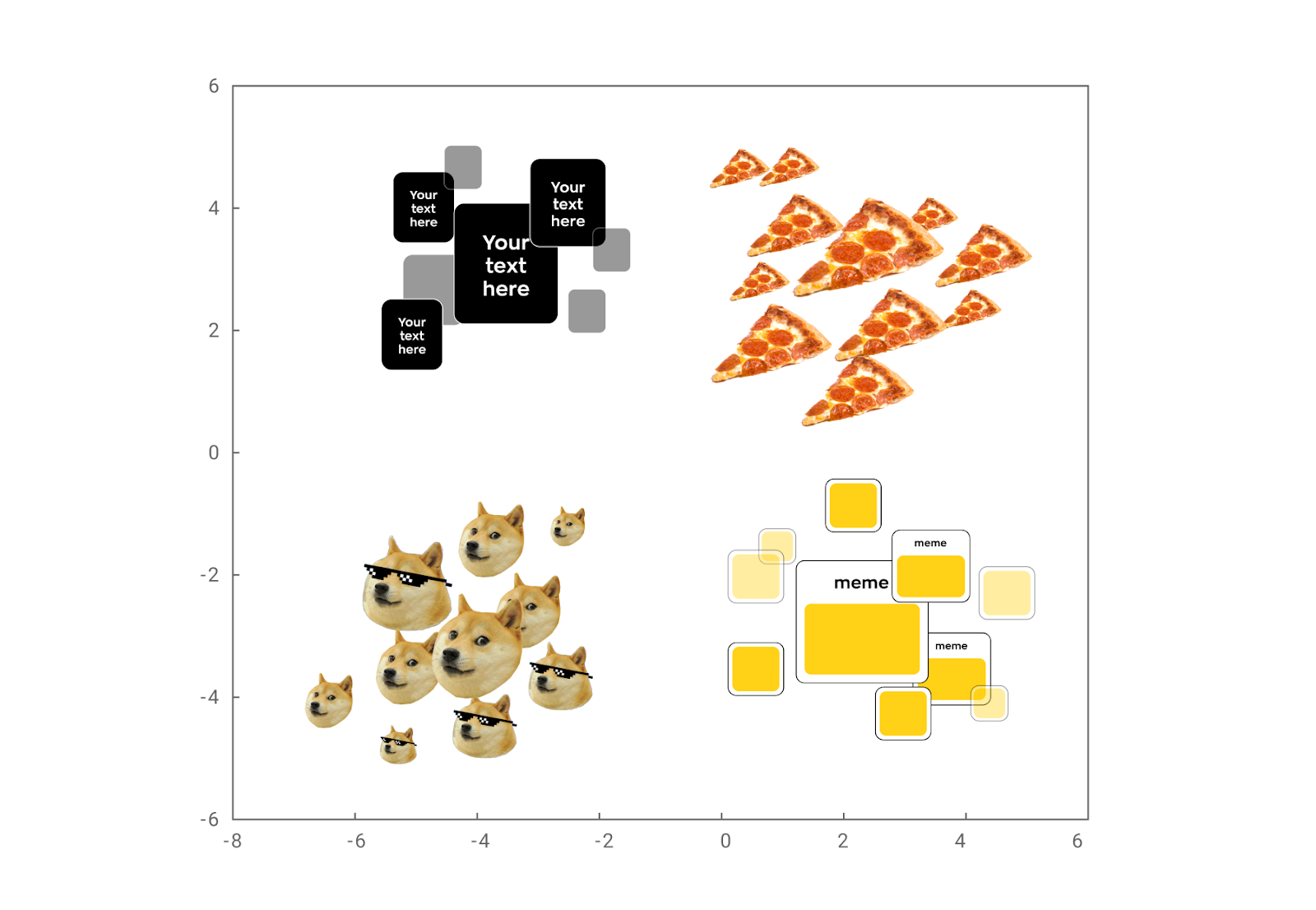

Задача звучала амбициозно: проиндексировать датасет на Читать полностью »