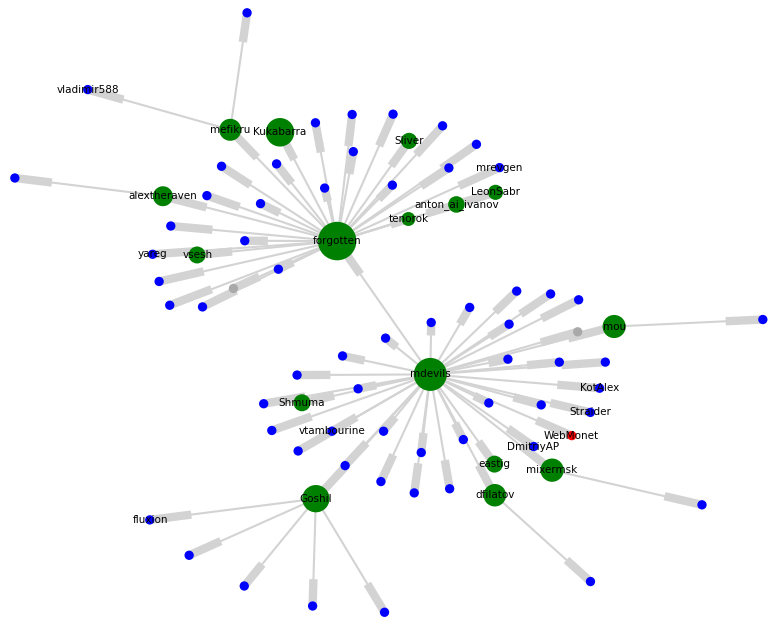

Около месяца назад я опубликовал статью о хабракотах на хабре. Побочным продуктом этой статьи оказался дамп страниц хабрапользователей, и мне захотелось извлечь ещё какую-нибудь информацию из него. На хабре регулярно появляются статьи об анализе пользователей, статей, комментариев, кармы, но я не нашёл ни одной статьи, в которой анализировались бы хабраинвайты. Поэтому я построил граф хабраинвайтов и посмотрел на некоторые его характеристики.

Рубрика «data mining» - 65

Хабракланы

2016-04-03 в 19:07, admin, рубрики: data mining, networkx, инвайты, хабрахабр, Хабрахабр APIАнализ поведенческих факторов с помощью Apache Spark

2016-04-03 в 12:40, admin, рубрики: Apache Spark, data mining, php, yii2, Разработка веб-сайтов Речь пойдёт об использовании Apache Spark для анализа поведенческих факторов на сайте, который имеет очень большую посещаемость. Учёт поведенческих факторов весьма часто используется для повышения конверсии ресурса. Кроме этого, возможности Интернет позволяют очень просто и быстро собирать и анализировать гигантское количество самой разной статистической информации. Будут показаны примеры кода и даны некоторые советы, основанные на личном опыте автора статьи.

Читать полностью »

16 ядер и 30 Гб под капотом Вашего Jupyter за $0.25 в час

2016-03-31 в 11:33, admin, рубрики: Amazon EC2, Amazon Web Services, data mining, jupyter notebook, python, scikit-learn, виртуализация, хостингЕсли Вам не очень повезло, и на работе нет n-ядерного монстра, которого можно загрузить своими скриптами, то эта статья для Вас. Также если Вы привыкли запускать скрипты на всю ночь (и утром читать, что где-то забыли скобочку, и 6 часов вычислений пропали) — у Вас есть шанс наконец познакомиться с Amazon Web Services.

В этой статье я расскажу, как начать работать с сервисом EC2. По сути это пошаговая инструкция по полуавтоматической аренде спотового инстанса AWS для работы с Jupyter-блокнотами и сборкой библиотек Anaconda. Будет полезно, например, тем, кто в соревнованиях Kaggle все еще пользуется своим игрушечным маком.

Видео-туториалы запуска вычислительных задач на Python, R, С++, Octave и Blender во FlyElephant

2016-03-29 в 15:30, admin, рубрики: blender, c++, data mining, FlyElephant, gcc, gromacs, HPC, java, Julia, octave, OpenFOAM, openmp, python, R, SciLab, Блог компании FlyElephant, научные расчёты, Облачные вычисления, параллельное программирование, стартапыПару недель назад, наша команда выпустила свежий релиз FlyElephant — платформа для ученых, которая предоставляет готовую вычислительную инфраструктуру для проведения расчетов, помогает находить партнеров и совместно работать над проектами, а также управлять всеми данными из одного места.

В качестве вычислительного ресурса сейчас используется облако Azure, а пользователи могут запускать вычислительные задачи, написанные с помощью С++ (с поддержкой OpenMP), R, Python, Octave, Scilab, Java, Julia, OpenFOAM, GROMACS, Blender на серверах с количеством ядер от 1 до 32 и оперативной памятью до 448 ГБ.

Сегодня мы хотим поделиться видео-туториалсами запуска задач во FlyElephant. Под катом вы найдете видео, как запускать вычислительные задачи, написанные с помощью С++, R, Python, Octave и рендерить изображения с помощью Blender, а также промо-код для получения бесплатных дополнительных часов работы ваших задач.

Читать полностью »

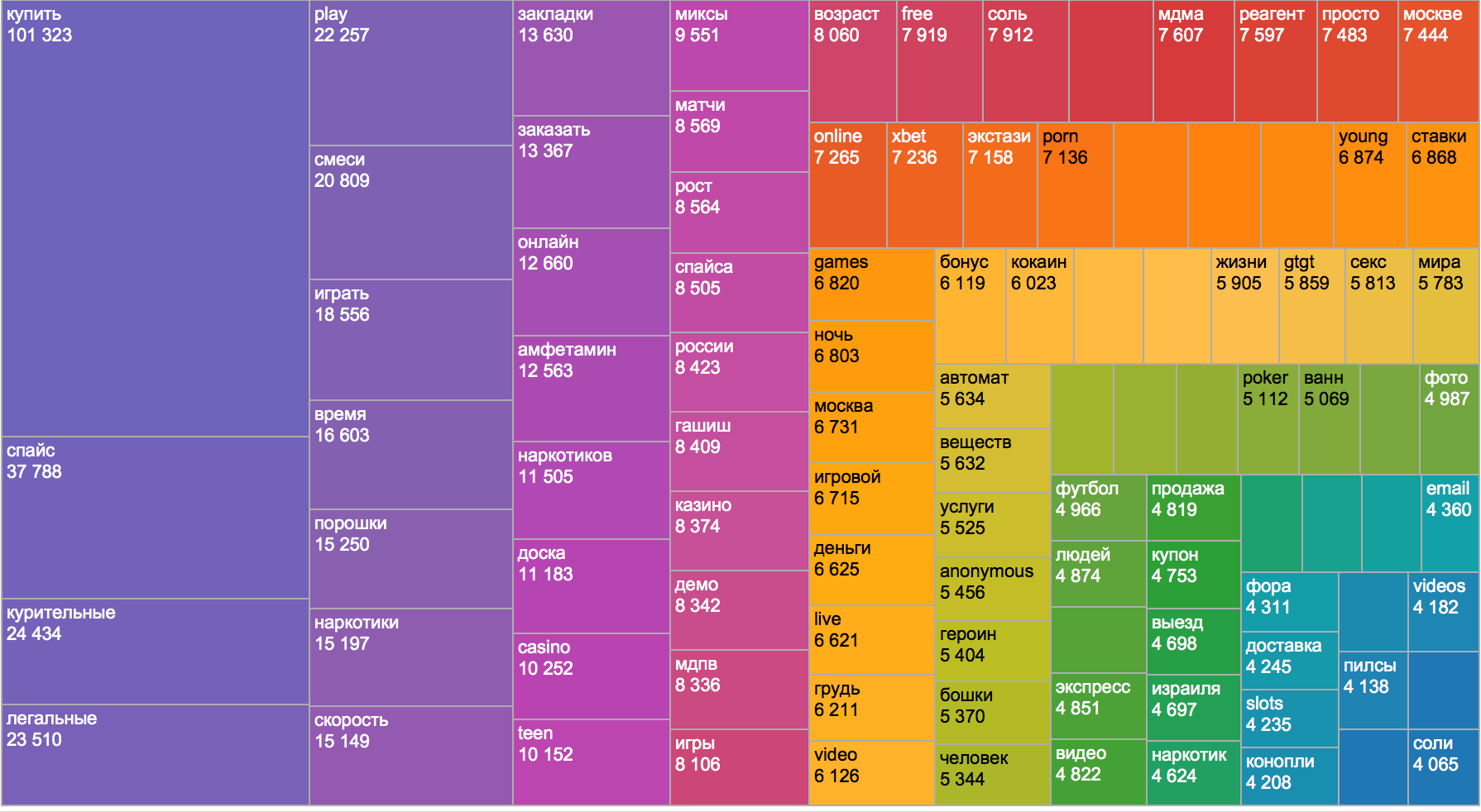

Частотный словарь запрещенных сайтов

2016-03-29 в 15:22, admin, рубрики: data mining, визуализация данных, запрещенные сайты, корпус слов, открытые данные, Роскомнадзор, СемантикаИсследование проводилось в целях создания корпуса слов сайтов, заблокированных государственными органами Российской Федерации.

Читать полностью »

Четыре слова, которые нельзя (исследование русской обсценной лексики на материалах соц.медиа)

2016-03-29 в 13:45, admin, рубрики: big data, data mining, обсценная лексика, Семантика, соц.сетиОдин мой приятель, учитель латинского языка, в начале урока спрашивал своих студентов, выполнили ли они домашнее задание. Как правило, если не первый, то второй или третий ученик сознавался: простите, господин Учитель, я ничего не сделал. «Фак!» — говорил учитель. «Фак!» — повторял он, вводя в еще большее недоумение своих чад. «Сегодня мы будем проходить глагол третьего спряжения facio – делать», который в повелительном наклонении единственного числа так и произносится: fac! – делай!

Нет, мы не собираемся витийствовать о том, что не бывает хороших и плохих слов, а есть наша оценка оных. Также мы не будем говорить об истоках и функциях русской брани, не будем обсуждать моральную сторону вопроса, как и искать причинно-следственные связи ее употребления. Мы проведем небольшое исследование обсценной лексики на материалах русскоязычных соц. медиа, сделаем ряд замеров и расчетов на большой выборке из интернет-источников.

Читать полностью »

Школа Данных «Билайн»: весна, знания, новый курс

2016-03-28 в 7:36, admin, рубрики: big data, data mining, kaggle, R, sna, Алгоритмы, алгоритмы обработки данных, анализ данных, анализ социальных сетей, Блог компании ВымпелКом (Билайн), машинное обучение, рекомендательные системы, школа данных

Привет.

Итак, третий курс Школы Данных «Билайн» подходит к завершению и мы набираем четвёртый.

У нас 18 занятий, 36 часов, все основные темы машинного обучения и анализа данных, куча практики, куча домашек, два Kaggle соревнования, презентации и воркшопы от партнеров, возможность устройства в Билайн в команду BigData для лучших студентов, сокурсники из различных областей бизнеса, где применяется машинное обучение и много чего ещё.

Читать полностью »

Web Scrapping с помощью python

2016-03-26 в 20:43, admin, рубрики: beautiful soup, data mining, lxml, python, xpathВведение

Недавно заглянув на КиноПоиск, я обнаружила, что за долгие годы успела оставить более 1000 оценок и подумала, что было бы интересно поисследовать эти данные подробнее: менялись ли мои вкусы в кино с течением времени? есть ли годовая/недельная сезонность в активности? коррелируют ли мои оценки с рейтингом КиноПоиска, IMDb или кинокритиков?

Но прежде чем анализировать и строить красивые графики, нужно получить данные. К сожалению, многие сервисы (и КиноПоиск не исключение) не имеют публичного API, так что, приходится засучить рукава и парсить html-страницы. Именно о том, как скачать и распарсить web-cайт, я и хочу рассказать в этой статье.

В первую очередь статья предназначена для тех, кто всегда хотел разобраться с Web Scrapping, но не доходили руки или не знал с чего начать.

Off-topic: к слову, Новый Кинопоиск под капотом использует запросы, которые возвращают данные об оценках в виде JSON, так что, задача могла быть решена и другим путем.Читать полностью »

Fbi Detected: Как я обнаружил агентов ФБР

2016-03-24 в 9:01, admin, рубрики: big data, data mining, data science, python, информационная безопасность, обработка данных, слив данных, сноуден, ФБР, черная археологияВ новом выпуске «Черной археологии датамайнинга» мы немного поиграемся в шпионов. Увидим, что может узнать обычный Data Specialist на основе открытых в сети данных.

Всё началось со статьи на хабре, о том, что некий анинимный хакер делился слитыми в сеть данными агентов ФБР. Я получил эти данные, и стал смотреть, что с ними можно сделать? В данных есть только фамилия, имя, и служебные мейлы и телефон – немного информации.

Получив эти данные, я увидел, что они заканчиваются буквой J. То есть, датасет не полон. Интресено, каков его полный размер? Чтобы узнать его, надо построить статистику частоты встречаемости фамилий.

Для этого я начал искать наборы американских фамилий, и тут меня ждало открытие – в Америке можно найти открытые данные по, скажем, избирателям штата – как я понял, совершенно легально. Например, я за полчаса без проблем получаю данные всех избирателей штата Юта.

Как нельзя делать рекомендации контента

2016-03-23 в 13:22, admin, рубрики: ab testing, big data, data mining, usability, UX, Блог компании Surfingbird, коллаборативная фильтрация, машинное обучение, Медиа, рекомендательные системы, рекомендации, СМИ

Во время общения с медиа мы в Relap.io часто сталкиваемся с массой заблуждений, в которые все верят, потому что так сложилось исторически. На сайте есть блоки типа «Читать также» или «Самое горячее» и т.п. Словом, всё то, что составляет обвязку статьи и стремится дополнить UX дорогого читателя. Мы расскажем, какие заблуждения есть у СМИ, которые делают контентные рекомендации, и развеем их цифрами.

Рекомендовать по тегам

Самое большое и самое популярное заблуждение. Чаще всего СМИ делают рекомендации в конце статьи по тегам. Так поступает Look At Me и РБК, например. Есть материал с тегами: трактор, Путин, сыр. К нему выводятся тексты про трактора, про Путина и сыр. На первый взгляд, логично:

Подобная механика рекомендаций в реальной жизни выглядела бы так. Вы идёте в магазин за продуктами. И кладёте в корзину сливочное масло. К вам подходит консультант с потными от волнения ладошками и говорит: «О, я вижу, вы взяли масло и это значит, что вам нужно масло. Возьмите еще пять видов сливочного деревенского и подсолнечного и козьего масла». Максимум, что может случиться из ряда вон выходящее — вам предложат трансмиссионное, если вы читали что-то про автомобили. И это уже будет считаться rocket science.Читать полностью »