Поводом для написания этой заметки стало обсуждение на недавнем отраслевом мероприятии задач Читать полностью »

Поводом для написания этой заметки стало обсуждение на недавнем отраслевом мероприятии задач Читать полностью »

Среди друзей я пользуюсь репутацией «ты ж программист», поэтому у меня нередко интересуются, как именно работают «под капотом» такие известные инструменты как ChatGPT, Claude, Grok или DeepSeek. Со временем я отточил ответ на этот вопрос — и потому, что нашёл способы лучше на него отвечать, и потому, что научился сам создавать большую языковую модель с нуля. Поэтому и сам понимать большие языковые модели я стал гораздо лучше.

Или: Claude, пойдёшь со мной на выпускной?

Слушайте, я не знаю, уничтожит ли нас когда-нибудь искусственный интеллект, сделает ли он нас всех богатыми или что-то ещё, но одно я знаю точно: мы всё ещё используем неправильную метафору.

Мы пытаемся понимать эти модели как людей. Когда вы задаете вопрос ChatGPT, а он отвечает полноценными предложениями, кажется, будто внутри сидит крошечный человечек и печатает ответы. Возникает яркое ощущение «он живой!!», и мы включаем весь арсенал ментальных механизмов, который эволюционировал для взаимодействия с другими людьми: Читать полностью »

Используем обработку естественного языка и теорию графов для сравнения и рекомендации различных типов документов.

Почти все проекты начинаются с одного важного этапа — активных исследований. Инвестировать в то, что уже было сделано другими, в развитие их работы — это один из путей к повышению ценности вашего проекта. Важно не только извлечь уроки из опыта других, но и понять, чего не стоит делать в своем проекте, чтобы повысить его шансы на успех.

В предыдущих статьях мы рассмотрели теоретические основы NLP, включая базовые понятия, такие как токенизация, стемминг, лемматизация и другие. Мы также поработали с библиотеками NLTK и spaCy и выполнили простые задания по обработке текста.

В этой статье мы продолжим изучение NLP и перейдем к более продвинутым темам, которые являются главными для построения современных приложений и моделей в области обработки естественного языка. А также создадим и обучим модели самостоятельно, используя TensorFlow/Keras и PyTorch.

В прошлой статье мы с вами изучили теоретические основы обработки естественного языка (NLP) и теперь готовы перейти к практике. В мире NLP выбор подходящего языка программирования и инструментов играет ключевую роль в успешной реализации проектов. Одним из наиболее популярных языков для решения задач в этой области является Python. Его простота, читаемость и поддержка мощных библиотек делают его идеальным выбором для разработчиков.

Введение в NLP

Представьте, что вы можете разговаривать с компьютером так же естественно, как с обычным человеком. Вы задаёте вопросы, получаете ответы, даёте команды - и это всё на вашем родном языке. Именно этим и занимается обработка естественного языка (Natural Language Proccessing, или NLP) - область искусственного интеллекта, которая фокусируется на взаимодействии между компьютерами и людьми с помощью естественного языка.

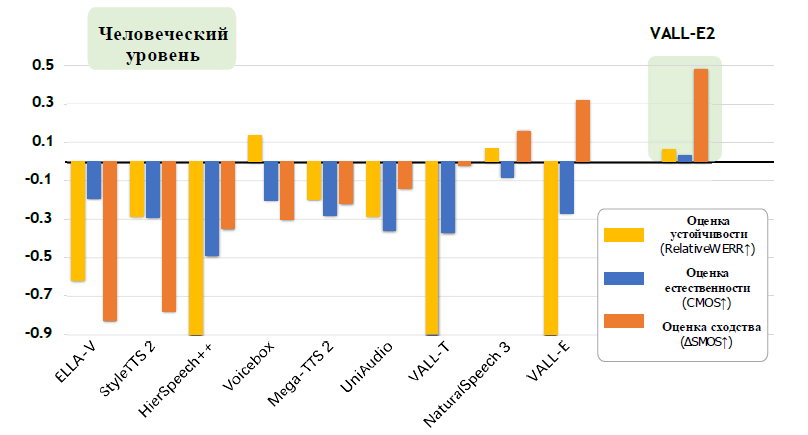

VALL-E 2, последнее достижение в области нейронных кодировочных языковых моделей, которое стало вехой в синтезе речи в zero-shot, достигнув человеческого уровня впервые. Zero-shotЧитать полностью »