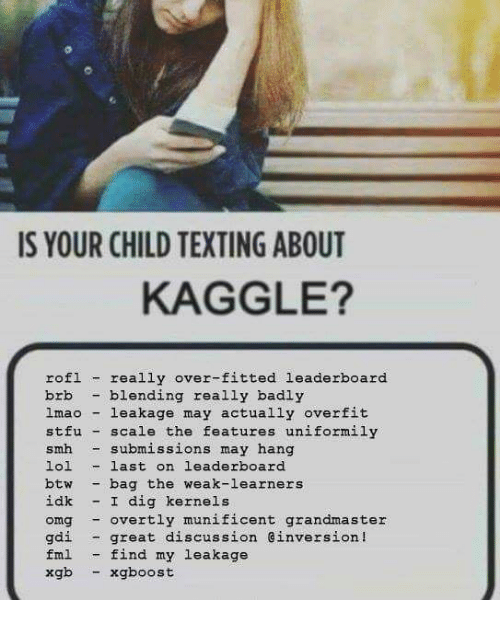

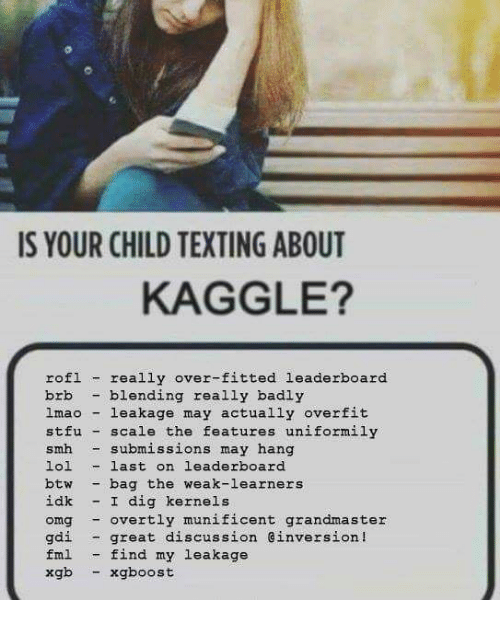

Kaggle — известная платформа для проведения соревнований по машинному обучению на которой количество зарегистрированных пользователей перевалило за 2.5 миллиона. В соревнованиях участвуют тысячи data scientist из разных стран, и Kaggle стал интересоваться тем, что из себя представляет аудитория. В октябре 2018 года был организован уже второй опрос и на него ответило 23859 людей из 147 стран.

В опросе было несколько десятков вопросов на самые разные темы: пол и возраст, образование и сфера работы, опыт и навыки, используемые языки программирования и софт и многое другое.

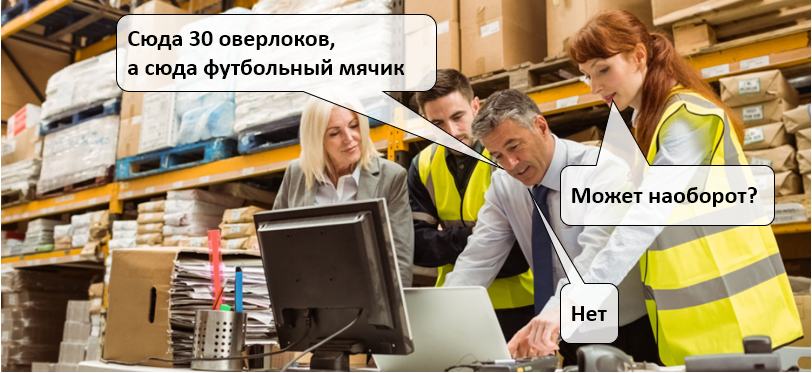

Но Kaggle — не просто площадка для соревнований, там также можно публиковать исследования данных или решения соревнований (они называются кернелы и похожи на Jupyter Notebook), поэтому датасет с результатами опроса был выложен в открытый доступ, и было организовано соревнование на лучшее исследование этих данных. Я тоже принимал участие и пусть денежный приз не получил, но мой кернел занял шестое место по количеству голосов. Я хотел бы поделиться результатами моего анализа.

Данных довольно много и их можно рассматривать с разных сторон. Меня заинтересовали различия между людьми из разных стран, поэтому большая часть исследования будет сравнивать людей из России (поскольку мы тут живём), Америки (как самая продвинутая страна в плане DS), Индии (как бедная страна с большим количеством DS) и других стран.

Большая часть графиков и анализа взята из моего кернела (желающие могут там увидеть код на Python) но есть и новые идеи.

Читать полностью »